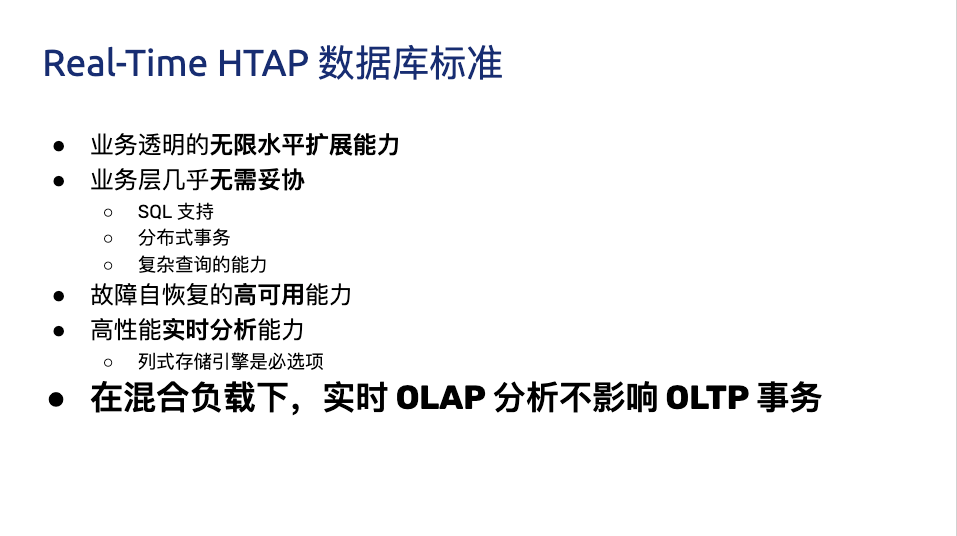

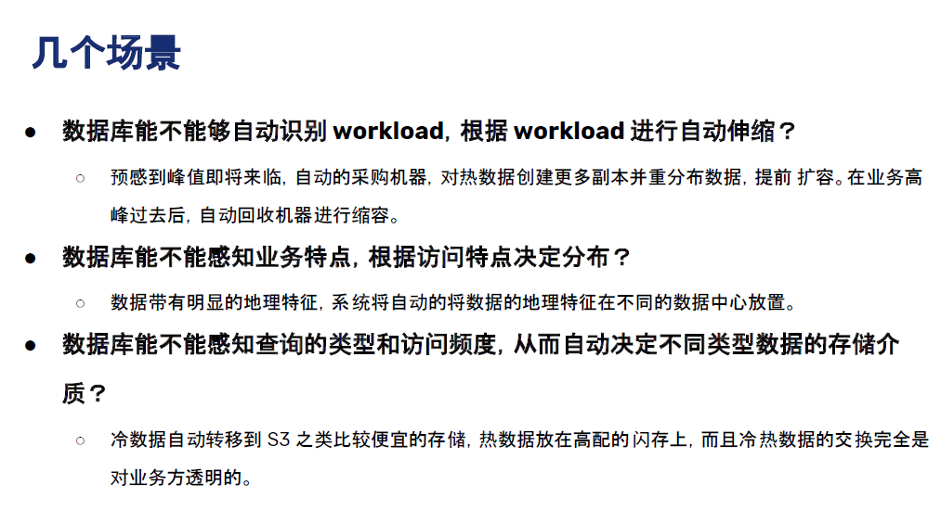

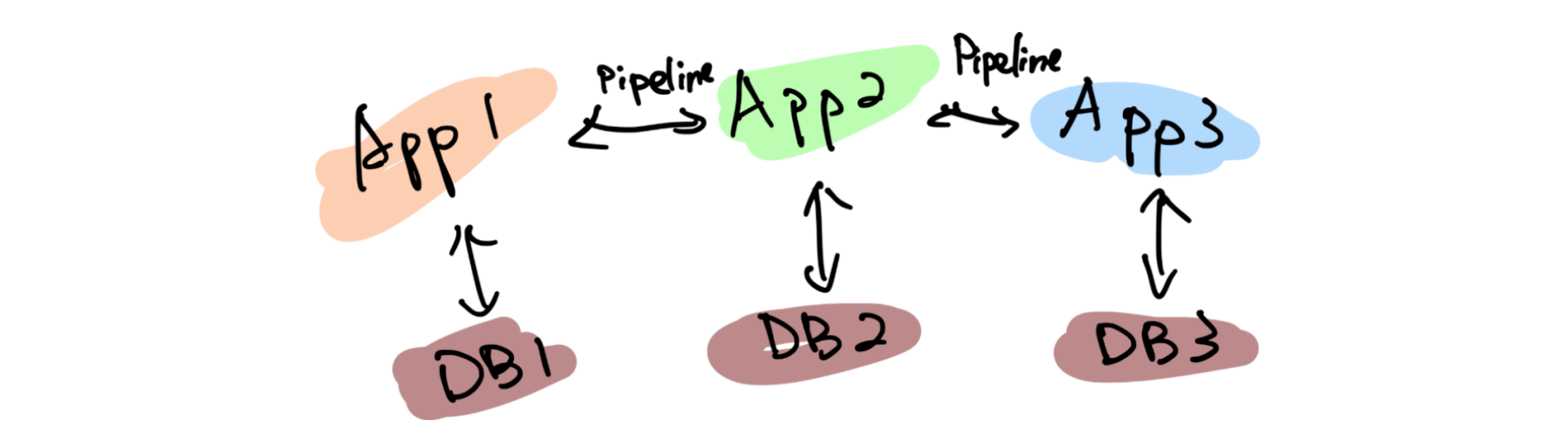

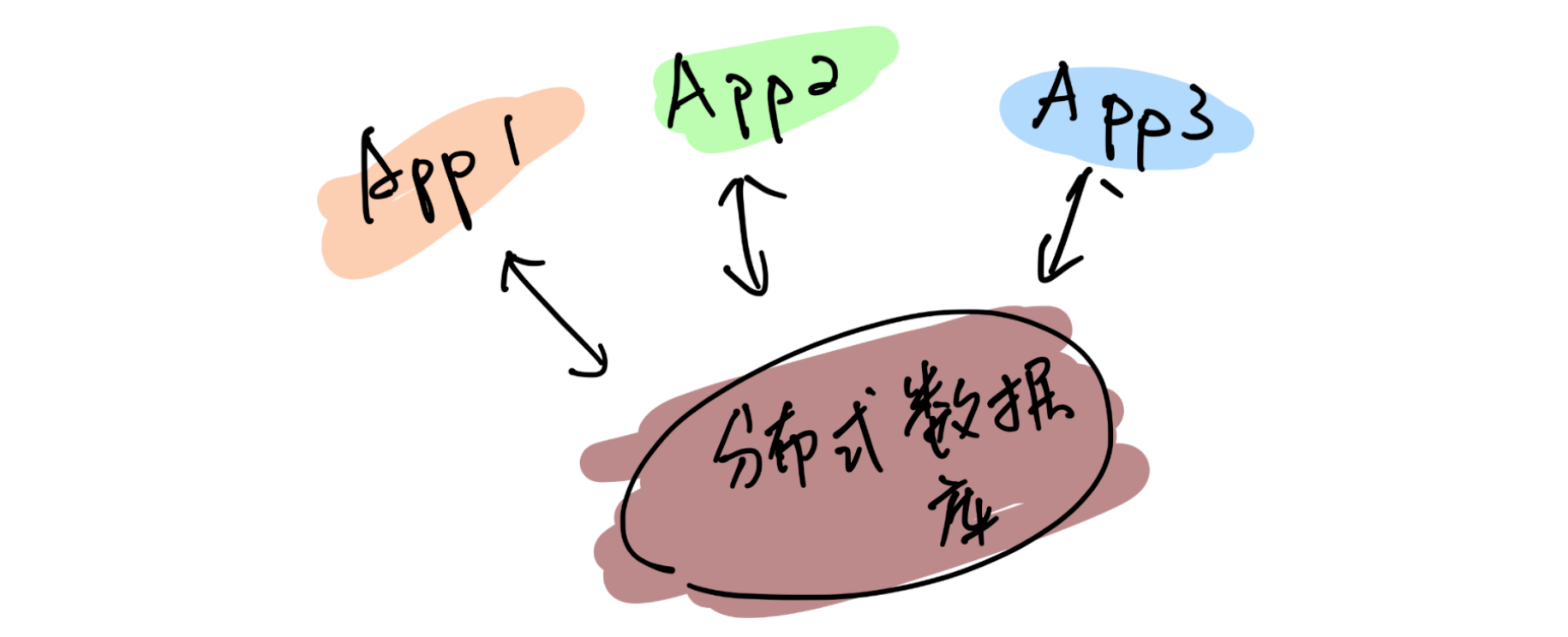

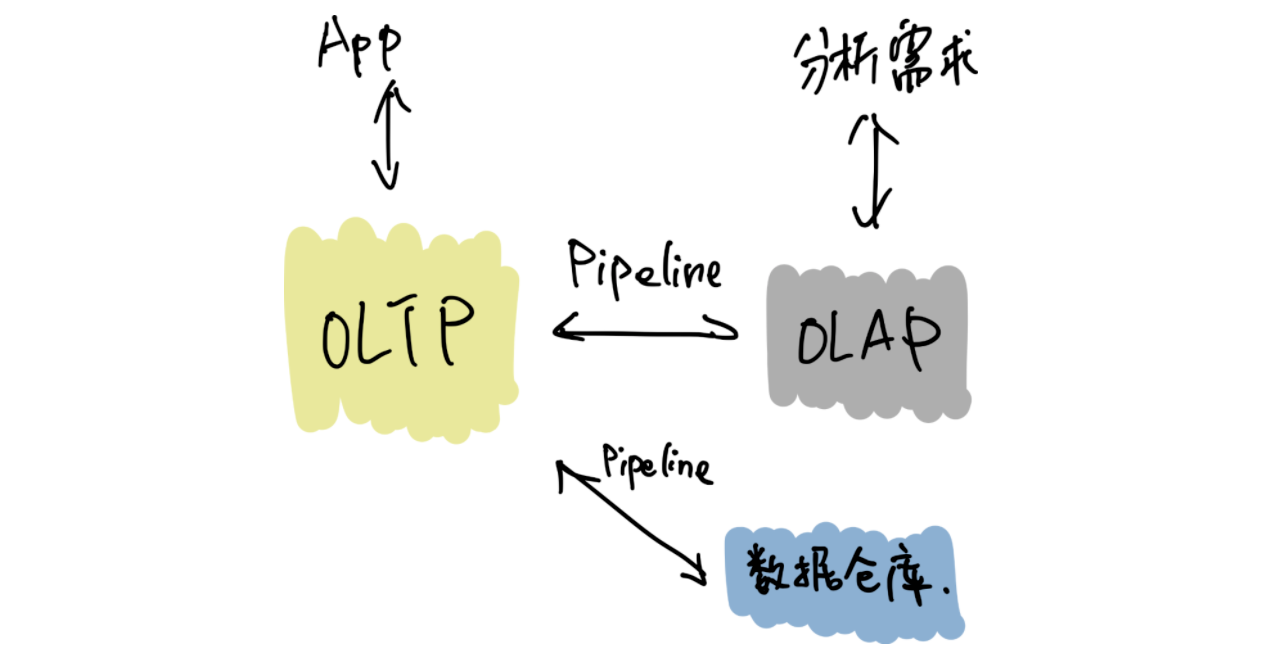

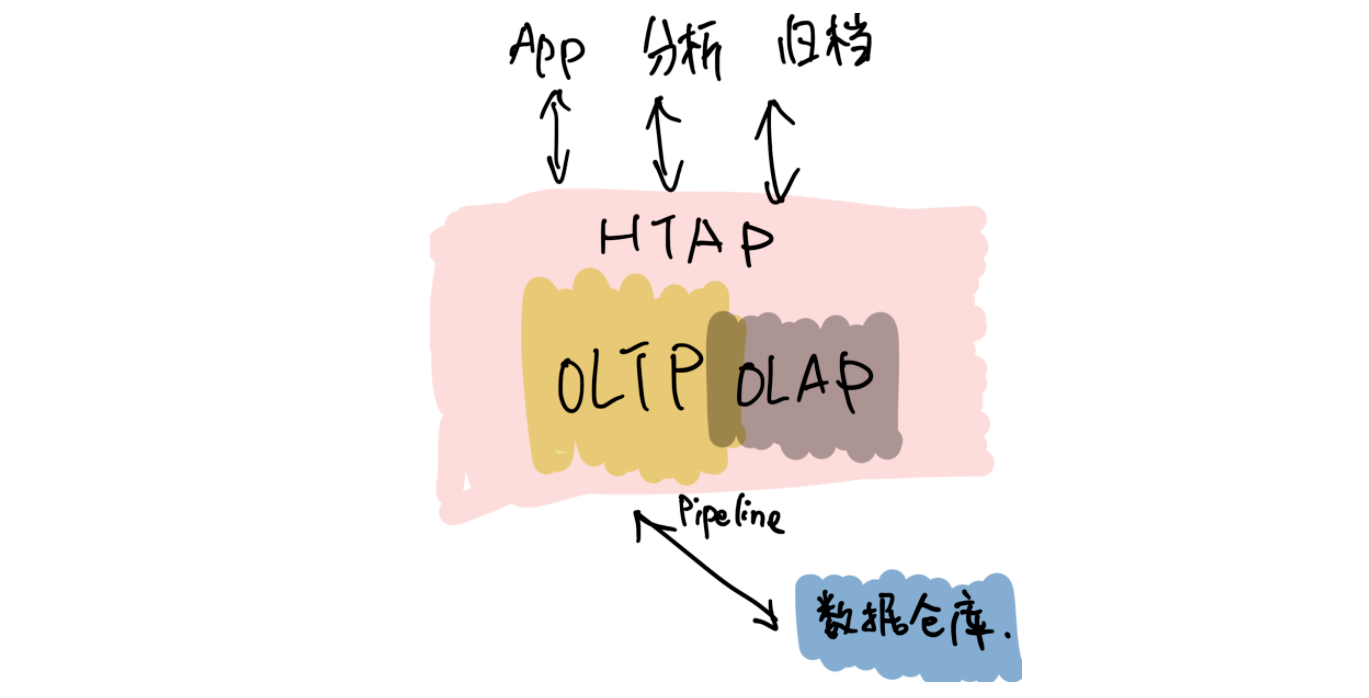

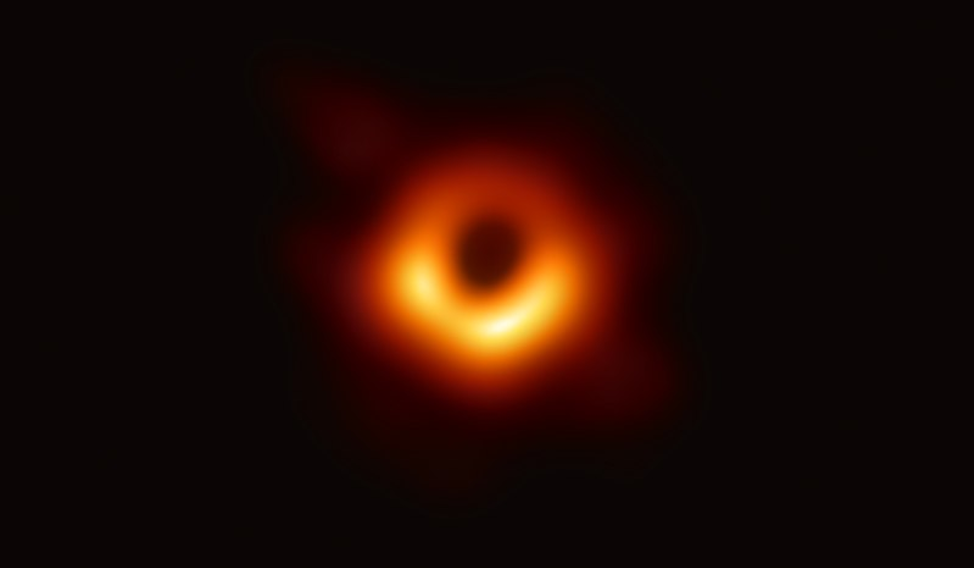

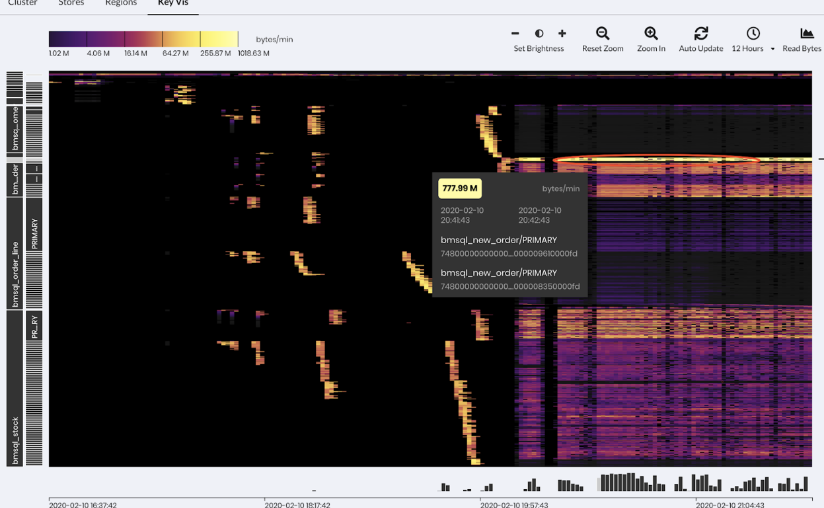

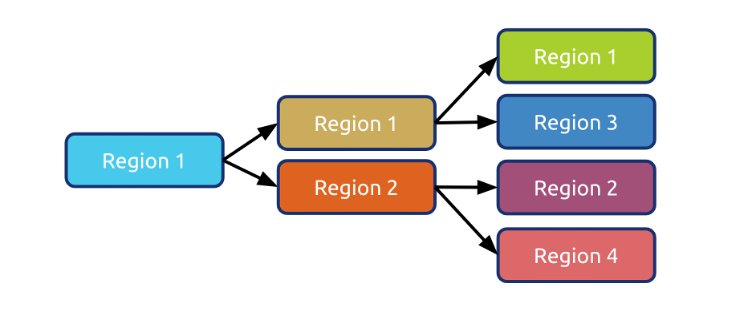

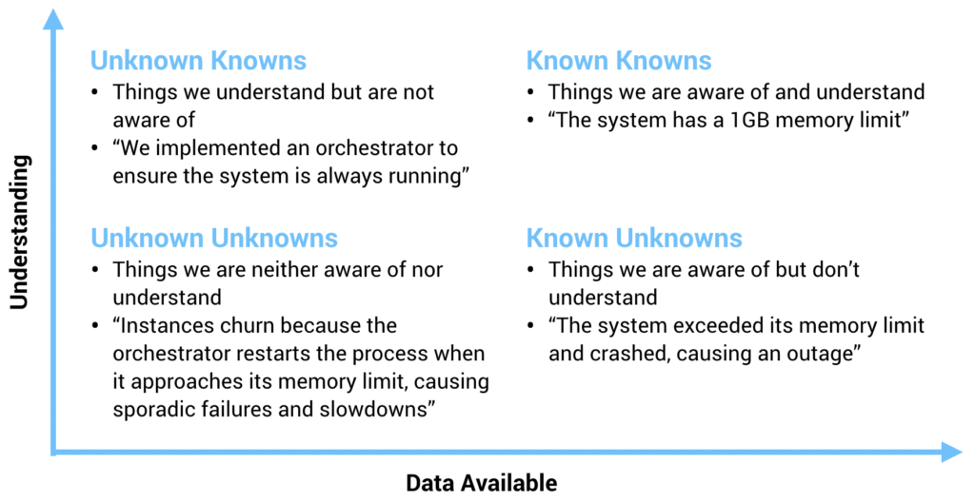

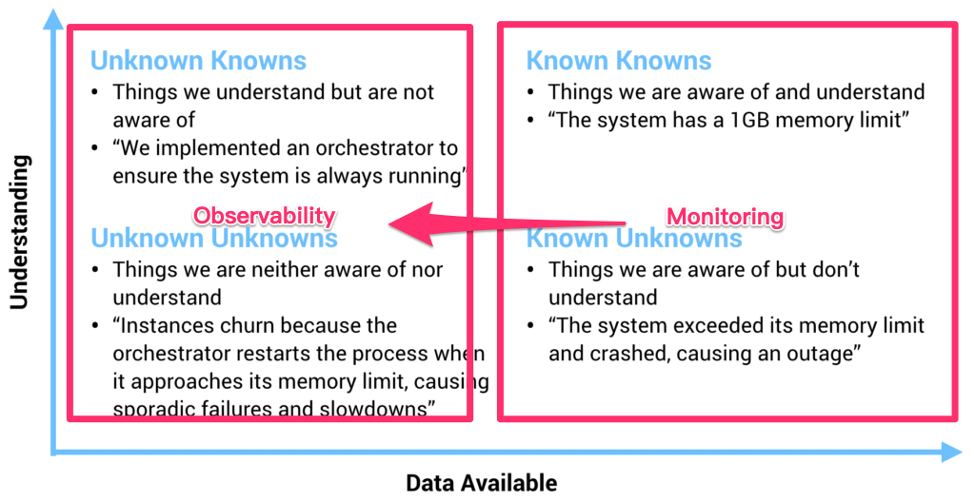

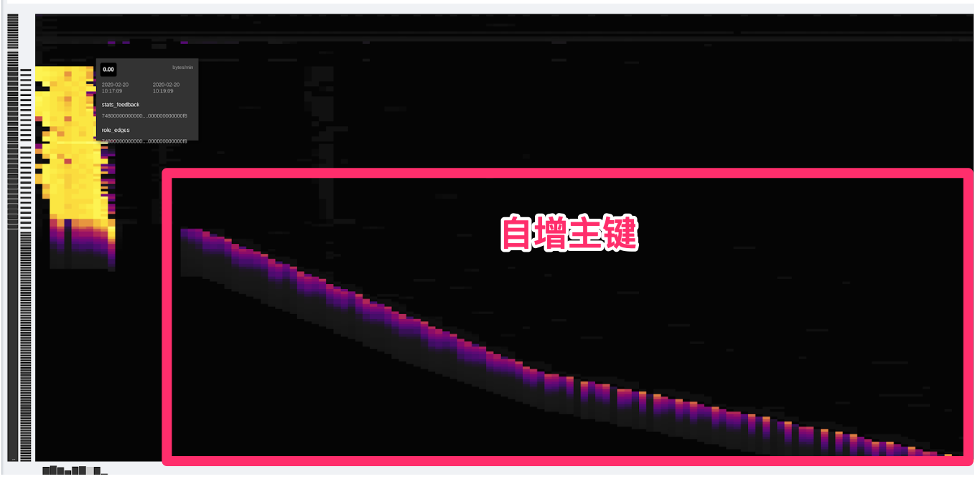

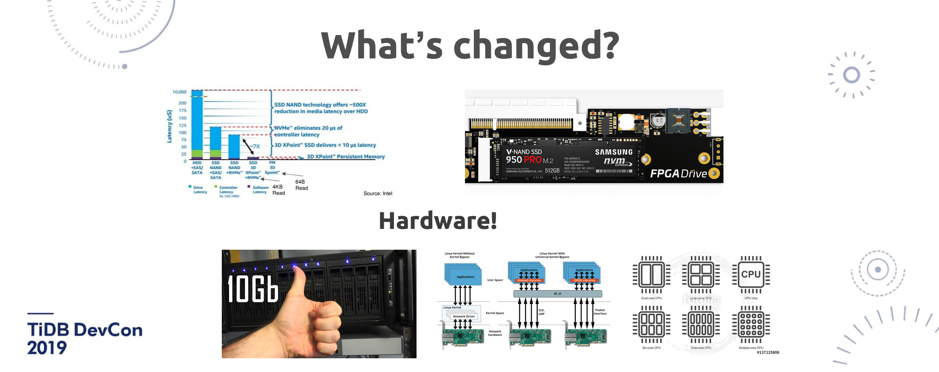

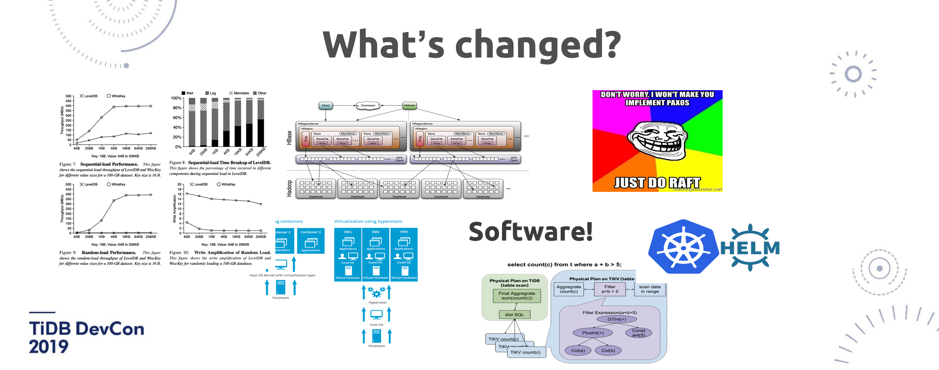

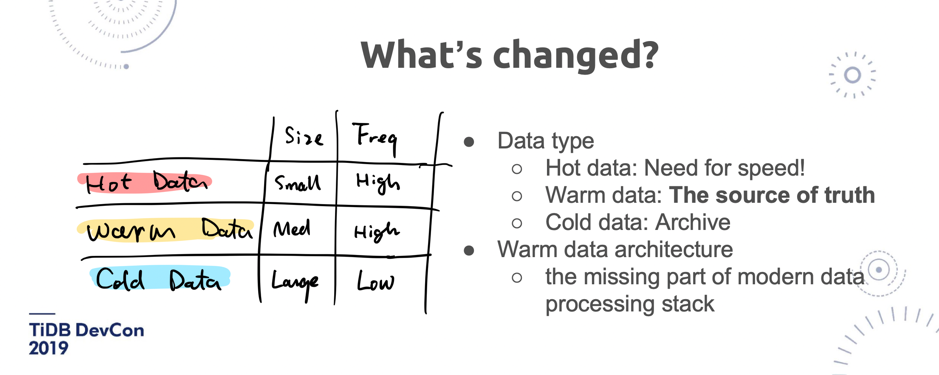

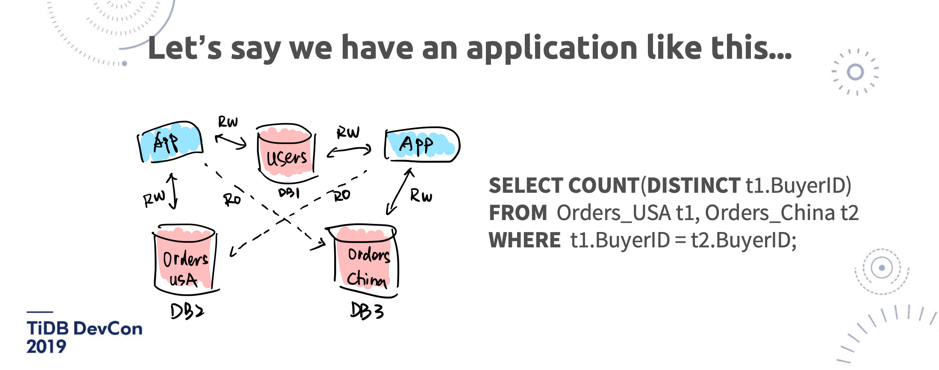

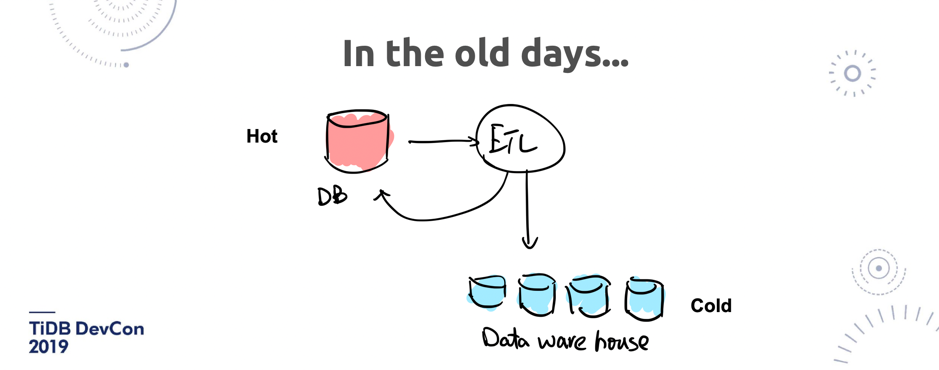

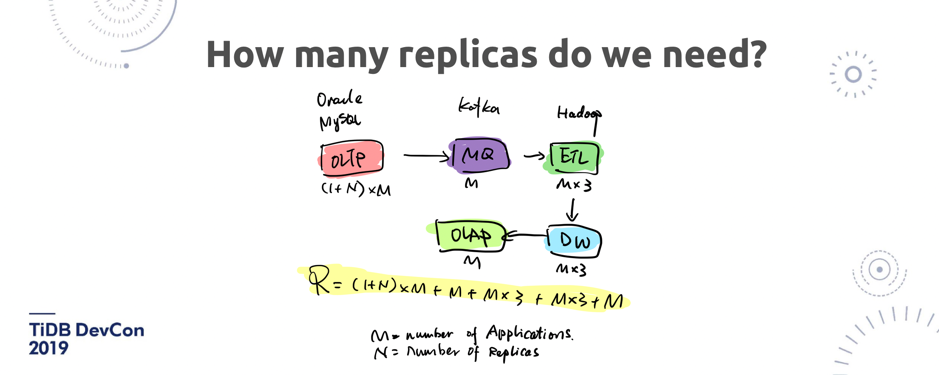

\n\n## 目前业界数据存储方案存在的问题?\n\n* 受限的 Scale 能力\n\n\t分库分表和一些「伪分库分表」的方案,仍然有天花板,带来了额外的运维和消耗。\n\n* 碎片化\n\n\t回想一下最近几年后端的技术栈,有 NoSQL、缓存、Kafka、 离线数据仓库、Hadoop、HBase……**不同的工具可能面对的是某些特定、甚至「狭窄」的场景,为了应对一个复杂的业务,大家必然就要多种技术方案组合来覆盖所有的应用场景。这个过程中自然会产生「数据孤岛」**,打通孤岛的成本也是巨大的,Kafka 最近几年这么火也是正因为存储方案的多样导致的「数据孤岛」的问题正在显现。\n\t\n* 在线业务与分析脱节\n\n\t现在大家构建存储系统的时候,默认会让在线业务与离线业务是分开的, 在线业务用 MySQL、MongoDB 等等,离线业务(或者分析系统)用 Hadoop 做数据分析,好像大家都是理所当然的认为:在线和离线就该这样,泾渭分明。\n\t\n\t**但目前有个趋势,分析的场景的需求越来越「实时」,或者说高时效的数据分析带来的业务价值受到重视**,这就与大家惯性认知产生了本质的冲突:业务需要当日甚至实时的数据分析结果,但后端只能说今天的数据明天才能导出。还有一个问题是,各个部分维护团队也是分开的,当业务发生变化时,很难灵活地调整和适应。\n\t\n**导致以上这些问题出现的深层共性是:变化永远比计划快**,你永远没法预测未来需要多少机器?业务会膨胀到多大?到底需要多“实时”的数据来做决策?\n\n**有没有可能存在一个应付更多变化、覆盖更多场景的系统**?从前可能是:我的工具箱里装了各种型号的锤子(工具软件),去应对不同场景、形状的钉子,现在可能追求用一个锤子,快速、低成本的解决不同的钉子(问题),**以不变应万变**。\n\n## Real-Time HTAP 是解药吗?\n\n聊到最近几年数据库领域的变化,申砾提到最近两年很多数据库打出了 HTAP 的标签,黄东旭分享了自己对“一个真正的 Real-Time HTAP 数据库”的理解:\n\n\n\n**那么 Real-Time HTAP 价值在何处?应该在于它是一个简单、灵活的方案——能够将各个系统/团队集中在一个 Real-Time HTAP 系统上,节省成本并灵活应对业务变化。**\n\n## Real-Time HTAP 之后?\n\nReal-Time HTAP 可能是当下厂商们能够看得到的努力方向,那么在 Real-Time HTAP 之后的未来是什么呢?\n\n或许五年之后有以下场景:\n\n\n\n基于这些场景,**未来数据库绕不开的核心能力应该是:智能、弹性调度能力**。\n\n最近有个新概念是 Serverless,Severless 是伴随云(Cloud)诞生的概念。当然 Severless 不是没有服务器,通俗地说,Serverless 就是会根据你的实际需求情况,调整数据库的形态,例如业务流量峰值的时候快速的采购弹性的计算资源进行扩容,低峰的时候自动的释放多余的资源。所以可以把 Severless 当做智能、弹性调度的落地形式来理解,同时未来的数据库一定是跑在云上的。","date":"2020-04-15","author":"PingCAP","fillInMethod":"writeDirectly","customUrl":"core-competence-of-future-database","file":null,"relatedBlogs":[]},{"id":"Blogs_128","title":"聊聊数据库的未来,写在 PingCAP 成立五周年之际","tags":["架构"],"category":{"name":"观点洞察"},"summary":"我们要造的是一个真正能作为整个系统的 Single Source of Truth 的基础软件。","body":">我还清楚记得,五年前的这个时候,当时还在豌豆荚,午后与刘奇和崔秋的闲聊关于未来数据库的想象,就像一粒种子一样,到了今天看起来也竟枝繁叶茂郁郁葱葱,有点感慨。按照惯例,五年是一个重要的节点,没有十年那么冗长,也没有一两年的短暂,是一个很好的回顾节点,就在此认真的回顾一下过去,展望一下未来。\n\n五年前创业的出发点其实很朴素:做一个更好的分布式数据库。从学术的角度上看起来,并不是提出了什么惊天地泣鬼神的神奇算法,我们选择的 Shared-nothing 的架构其实在当时的业界也不是什么新鲜的事情了,但真正令我激动的是:**我们要造的是一个真正能作为整个系统的 Single Source of Truth 的基础软件**。这句话怎么理解呢?我在后边会好好聊聊。\n\n## 数据是架构的中心\n\n作为一个互联网行业的架构师,几乎是天天都在和各种类型的数据打交道,这么多年的经验,不同行业不同系统,从技术层面来说,抽象到最高,总结成一句话就是:\n\n**数据是架构的中心。**\n\n仔细想想,我们其实做的一切工作,都是围绕着数据。数据的产生,数据的存储,数据的消费,数据的流动……只不过是根据不同的需求,变化数据的形态和服务方式。计算机系的同学可能还记得老师说过的一句话:程序 = 算法 + 数据结构,我这里斗胆模仿一下这个句式:**系统 = 业务逻辑 x 数据**。可以说很多架构问题都是出在数据层,例如常见的「烟囱式系统」带来的种种问题,特别是数据孤岛问题,其实本质上的原因就出在没有将数据层打通,如果不从数据架构去思考,就可能「头疼医头、脚疼医脚」,费了半天劲还是很别扭,反过来如果将数据层治理好,就像打通「任督二脉」一样,起到四两拨千斤的效果。\n\n但是理想通常很丰满,现实却很骨感。至少在我们五年前出来创业那会儿,我们觉得并没有一个系统能够很好的解决数据的问题。可能好奇的读者就要问了:不是有 Hadoop?还有 NoSQL?再不济关系型数据库也能分库分表啊?其实列出的这几个几乎就是当年处理存储问题的全部候选,这几个方案的共同特点就是:不完美。\n\n**具体一点来说,这几个解决方案对于数据应用的场景覆盖其实都不大,对于复杂一点的业务,可能需要同时使用 n 多个方案才能覆盖完整**。这就是为什么随着近几年互联网业务越来越复杂,类似 Kafka 这样的数据 Pipeline 越来越流行,从数据治理的角度其实很好理解:各种数据平台各负责各的,为了做到场景的全覆盖,必然需要在各个「岛」之间修路呀。\n\n**我们当年就在想,能不能有一个系统以一个统一的接口尽可能大的覆盖到更多场景。**\n\n**我们需要一个 Single Source of Truth**。数据应该是贯穿在应用逻辑各个角落,我理想中的系统中对于任意数据的存取都应该是可以不加限制的(先不考虑权限和安全,这是另一个问题),这里的“不加限制”是更广义的,例如:没有容量上限,只要有足够的物理资源,系统可以无限的扩展;没有访问模型限制,我们可以自由的关联、聚合数据;没有一致性上的限制;运维几乎不需要人工干预……\n\n## 以分布式数据库为统一中心的架构\n\n我当年特别着迷于一个美剧:Person of Interest (疑犯追踪),这个电视剧里面有一个神一样的人工智能 The Machine,收集一切数据加以分析,从而预测或是干预未来人们的行动。虽然这部美剧还是比较正统的行侠仗义之类的主题,但是更让我着迷的是,是否我们能设计一个 The Machine?虽然直到目前我还不是一个 AI 专家,但是给 The Machine 设计一个数据库似乎是可行的。这几年创业过程中,我们发现更令人兴奋的点在于:\n\n**以分布式数据库为统一中心的架构是可能的。**\n\n这个怎么理解呢?举个例子,就像在上面提到的分裂带来的问题,数据层的割裂必然意味着业务层需要更高的复杂度去弥补,其实很多工程师其实偏向于用线性的思维去思考维护系统的成本。但是实际的经验告诉我们,事情并不是这样的。一个系统只有一个数据库和有十个数据库的复杂程度其实并不是的简单的 10x,考虑到数据的流动,维护成本只可能是更多,这里还没有考虑到异构带来的其他问题。\n\n\n\n以分布式数据库为中心的架构是什么样子的呢?**很好理解,整个架构的中心是一个场景覆盖度足够广,且具有无限的水平伸缩能力的存储系统。大部分数据的流动被限制在这个数据库内部,这样应用层就可以几乎做到无状态,因为这个中心的数据库负责了绝大部分状态,每个应用可以通过自己的缓存来进行加速。\n这里我想提醒的是,为什么我在上面强调水平扩展能力,是因为受限的扩展能力也是导致分裂的一个重要的原因。我们从来都没有办法准确的预测未来,我们很难想象甚至是一年后业务的变化(想想这次疫情),有句老话说的很好:唯一不变的就是变化。**\n\n另外一个经常被问到的问题,为什么要强调缓存层需要离业务层更近,或者说,为什么位于中心的这个巨型数据库不应该承担缓存的责任?我的理解是,只有业务更懂业务,知道应该以什么样的策略缓存什么样的数据,而且出于性能(低延迟)考虑,缓存离业务更近也是有道理的。\n\n\n\n对应上面那句话「唯一不变的就是变化」,这个架构带来最大的好处正是「以不变应万变」,或者更简单的一个词:**简洁**。Google 其实在很早就想清楚了这个问题,因为他们很早就明白什么是真正的复杂。\n\n另一个例子是 **HTAP**,如果关注的数据库的发展的话,最近一定对 HTAP 这个词很熟悉,其实在我看来的 HTAP 的本质在于上面提到的覆盖度,下面是一个典型的架构:\n\n\n\n传统的数据架构通常将 OLTP、OLAP、离线数仓分离,各个系统各司其职,中间通过独立的 Pipeline 进行同步(有时候还会加上 ETL)。\n\n**下面是一个 HTAP 的系统的样子:**\n\n\n\n虽然从表面上看,只是简单的将接口层进行整合,但是这个意义其实是深远的,首先数据同步的细节被隐藏了一起来,这意味着数据库层面可以自己决定通过何种方式同步数据,另外由于 OLTP 引擎和 OLAP 引擎在同一个系统内部,使得很多细节信息不会在同步的过程中丢失,比如:事务信息,这就意味着在内部的分析引擎能够做到传统的 OLAP 没办法做的事情。另外对于业务层的使用来说,少一个系统意味着更统一的体验和更小的学习和改造成本,**不要低估统一带来的力量**。\n\n## 未来在哪里?\n\n上面这些是过去五年发生的事情,也几乎按照我们创业时候的设想一步步的变为现实,那么接下来的五年会发什么?随着对于行业和技术的理解的加深,至少有一点我深信不疑的是:\n\n### 弹性调度会是未来的数据库的核心能力\n\n谁都不会否认,最近十年在 IT 技术上,最大的变革是由云带来的,这场革命还在进行时。云的核心能力是什么?我认为是弹性。计算资源分配的粒度变得越来越细,就像从只能买房变成可以租房,甚至可以像住酒店一样灵活。这意味着什么?**本质在于我们可以不用为「想象中」的业务峰值提前支付成本。**\n\n过去我们的采购服务器也好,租赁机柜也好,都是需要设定一个提前量的,当业务峰值没有到来之前,其实这些成本是已经提前支付的了。云的出现将弹性变成了基础设施的一个基础能力,我预计数据库也会发生同样的事情。\n\n可能有很多朋友会有疑问,现在难道不是几乎所有数据库都号称能够支持透明水平扩展嘛?其实这里希望大家不要将**「弹性调度」**狭隘的理解为扩展性,而且这个词的重点在**「调度」**上,我举几个例子以方便大家理解:\n\n1. **数据库能不能够自动识别 workload,根据 workload 进行自动伸缩**?例如:预感到峰值即将来临,自动的采购机器,对热数据创建更多副本并重分布数据,提前扩容。在业务高峰过去后,自动回收机器进行缩容。\n\n2. **数据库能不能感知业务特点,根据访问特点决定分布**?例如:如果数据带有明显的地理特征(比如,中国的用户大概率在中国访问,美国用户在美国),系统将自动的将数据的地理特征在不同的数据中心放置。\n\n3. **数据库能不能感知查询的类型和访问频度,从而自动决定不同类型数据的存储介质**?例如:冷数据自动转移到 S3 之类比较便宜的存储,热数据放在高配的闪存上,而且冷热数据的交换完全是对业务方透明的。\n\n这里提到的一切背后都依赖的是「弹性调度」能力。未来我相信物理资源的成本会持续的降低,计算资源的单价持续下降带来的结果是:当存储成本和计算资源变得不是问题的时候,问题就变成**「如何高效的分配资源」**。如果将高效分配作为目标的话,「能调度」就是显而易见的基础。\n当然就像一切事物发展的客观规律一样,学会跑步之前,先要学会走路,我相信在接下来的一段时间内,我们会看到第一批初步拥有这样能力的新型数据库,让我们拭目以待。\n\n### 下一个阶段是智能\n\n对于更远的未来是怎么样子的?我不知道,但是就像 The Machine 一样,只有足够数据才能诞生出智能,我相信就像我们不了解宇宙和海洋一样,我们现在对于数据的认识一定是肤浅的,甚至大量的数据我们都还没记录下来,一定有更大奥秘隐藏在这海量的数据中,从数据中能获取什么样的洞察,能够怎么样更好的改变我们的生活,我并不知道,但是做这件事情的主角我猜不会是人类。虽然在这个小节我们讨论的东西可能就有点像科幻小说了,不过我愿意相信这样的未来,从数据的海洋中诞生出新的智能体。\n\n## 尾声\n\n创业这五年的时间,回头看看那个最朴素的出发点:写一个更好的数据库彻底解决烦人的 MySQL 分库分表问题。似乎也算没有偏离初心,但是在这个旅途中一步步看到了更大的世界,也越来越有能力和信心将我们相信的东西变为现实:\n\n我有一个梦想,未来的软件工程师不用再为维护数据库加班熬夜,各种数据相关的问题都将被数据库自动且妥善的处理;\n\n我有一个梦想,未来我们对数据的处理将不再碎片化,任何业务系统都能够方便的存储和获取数据;\n\n我有一个梦想,未来的我们在面临数据的洪流时候,能从容地以不变应万变。\n\n最近我听到一句话,我个人很喜欢:**雄心的一半是耐心**。构建一个完美的数据库并不是一朝一夕的工作,但是我相信我们正走在正确的道路上。\n\n**凡所过往,皆为序章。**","date":"2020-04-08","author":"黄东旭","fillInMethod":"writeDirectly","customUrl":"talk-about-the-future-of-databese-on-5th-anniversary-of-pingcap","file":null,"relatedBlogs":[]},{"id":"Blogs_167","title":"我眼中的分布式系统可观测性","tags":["Key Visualizer","TiDB 4.0 新特性"],"category":{"name":"观点洞察"},"summary":"在 Cloud Native 和微服务的世界里,大家正在将“系统的可观测性”放在更高的位置。","body":"\n\n位于 M87 中心的特大质量黑洞示意图(© EHT Collaboration)\n\n今天的文章我想从这张模糊的照片说起。\n\n相信很多小伙伴对这张照片并不陌生,这是去年人类第一次拍摄的 M87 中心黑洞的照片,从1915年,爱因斯坦提出相对论预言黑洞的存在到 2019 年我们终于第一次「**看到**」了黑洞的样子,中间整整相隔了 100 多年,这对于人类认识黑洞乃至认识宇宙都是一个里程碑式的事件。人类是一个感性的动物,所谓「**一图胜千言**」很多时候一张图传达的信息超过千言万语。\n\n关于黑洞我不想展开太多,今天我们聊聊「**望远镜**」。\n\n前几天,在 TiDB 4.0 的开发分支中,我们引入了一个新功能叫做:Key Visualizer(下面简称 KeyViz),说起来这个小工具也并不复杂,就是用不同颜色的方框来显示整个数据库的不同位置数据访问频度和流量。一开始我们只是仅仅将它定位为一个给 DBA 用来解决数据库热点问题的调优辅助小工具,但是从昨晚开始我就一直在把玩这个小东西,突然觉得它对于分布式数据库来说背后的意义远不及此。\n\n**在 CNCF 对 Cloud Native 的定义中,有一条叫做「Observability」,通用的翻译叫系统的「可观测性」。过去我一直苦于寻找一个例子说明什么叫做一个「可观测」的系统,在 KeyViz 这个项目上,我找到了对这点绝佳的体现。**\n\n**举几个直观的小例子。你知道 TPC-C 测试「长」什么样子吗?请看下图:**\n\n\n\n图中横轴是时间,纵轴是数据的分布,左半部分是数据导入的过程,有零星的亮点,可以看到写入分散到多个区块;右边密集的色块是测试在运行时系统的实时读写状态,越暗表示流量越小,越亮表示流量越高。从密集的色块我们能够看得出来,workload 基本分布均匀,但是大概有两处是明显偏亮的区域,其中靠近最上方,有一个特别明显的**局部访问热点**(最亮的那条线)。\n\n**第二个例子,你见过 Sysbench 测试 「长」什么样子吗?看看下面。**\n\n\n\n左边比较密集的明亮黄块部分,是导入数据阶段;右半段明暗相间的部分是在进行 oltp_point_select 测试,因为选取的模式是 uniform 模式,并且导入的时候是 32 线程 32 张测试表,可以看到的数据和分布和访问都比较均匀。\n如果你看懂了上面两个小例子,下面是一个小作业:这是我们模拟的一个实际用户的生产环境的照片,**这个用户的系统遇到了一些瓶颈,你能看出问题吗?**\n\n\n \n上面几个小例子是让大家对 KeyViz 有个感性的认识,在介绍这个东西背后的意义之前,我想先介绍一下 TiDB 这类典型的分布式数据库的系统架构,方便大家更好的理解。\n\n\n\n一个典型的分布式数据库的数据分布策略\n\n分布式数据库,顾名思义,数据一定是分散在不同机器上的。对于一张表的数据,我们会在逻辑上切分成若干个连续的区间,将这些区间内的数据分给不同的机器存储,不管是写入还是读取,只需要知道目标数据属于哪个区间,就可以直接到那个机器上进行访问。然后加上对每一个区间的数据在物理上做多副本冗余,实现高可用。如下图所示,Region 在 TiDB 的内部就是一个个连续的数据区间。\n\n\n\n和很多分布式数据库不太一样的是,我们的 Region 的大小比较小(默认 96MB) ,另外数据的分布并不是静态的,而是动态的,Region 会像细胞一样分裂/合并,也会在不同机器之间移动进行动态的负载均衡。\n\n\n\n现在回头看这个设计,还是觉得无比的简洁和优雅。对用户而言再也不用去思考怎么分库,怎么分表,数据在最底层的细胞就像有生命一样繁衍和迁徙。\n\n**然后问题就来了,对于这样的数据库而言,有没有一种办法能够直观地描述系统的运行时状态?我怎么知道它是不是「生病」了?我能不能预测这个系统的未来?我能不能发现未知的风险?**\n\n过去,不管是业务开发者还是 DBA,衡量一个数据库的状态,来来回回就是几个指标,QPS 、TPS、查询时间、机器负载(CPU、网络、磁盘),但很多时候就像是盲人摸象一样对于系统的全局我们是不清楚的。再加上在一个分布式的架构下,很多时候,我们可能会被海量的数字蒙蔽了双眼。一些有经验的 DBA 或许可以通过自己的经验,从多个指标里模糊构建出业务全局状态,但是到底这个经验往往是不可描述的,这就是为什么一些老运维、老 DBA 那么值钱的原因,但是我认为这种做事方式是很难 scale 的。\n\nCT 、B 超、核磁共振,这些现代化的手段极大地促进了现代医学的发展,因为我们第一次能「看见」我们身体的内部状态,从而才能得出正确的判断。**在计算机的世界道理也是相通的,最好通过某些工具让人清晰地「看见」系统运行的健康状态、帮助诊断病灶,从而降低经验门槛和不确定性。**\n\n过去也经常有朋友问我:“你说我这个业务适不适合使用 TiDB?”这时我们只能问,你的 QPS 多少 TPS 多少,数据量多少?读写比?典型查询?数据分布怎么样?表结构是什么呀?等等一连串的灵魂拷问,而且很多术语都非常专业,不是在这个行业摸爬滚打很久的老司机可能都搞不太清楚。而且有些信息可能是敏感的,也不方便共享。所以「**预判** TiDB 到底适不适合某项业务」就成了一个玄学问题,这个问题困扰了我很久,很多时候也只能凭个人感觉和经验。其实这个问题也并不是 TiDB 特有,尤其是最近几年,几乎所有现代的分布式系统,都或多或少有类似的问题。\n\n**在过去,一个物理机器的状态确实可以通过几个监控指标描述,但是随着我们的系统越来越复杂,我们的观测对象正渐渐的从「Infrastructure」转到「应用」,观察行为本身从「Monitoring(监控)」到「Observability(观测)」。** 虽然看上去这两者只是文字上的差别,但是请仔细思考背后的含义。关于这个话题,我很喜欢引用下面这张图:\n\n\n\n上图坐标描述了我们对系统的理解程度和可收集信息之间的关系。在 X 轴的右侧(Known Knows 和 Known Unknowns)这些称为**确定性的已知和未知**,图中也给出了相对应的例子,这些信息通常是最基础的普适的事实,也就是在系统上线之前我们一定就能想到,一定能够监控起来的(CPU Load、内存、TPS、QPS 之类的指标),我们过去已有的大多数运维监控都是围绕这些确定的东西。\n\n但是有一些情况是这些基础信息很难描述和衡量的,例如这个坐标的左上角:**Unknown Knowns**,用通俗的话来说,叫做「**假设**」。举个数据库的例子:有经验的架构师在设计一个基于分布式数据库的应用时,通常不会将表的主键设成自增主键,会尽可能的用 UUID 或者其他方式打散数据,这样在即使有突发写入压力的时候,系统也能很好的扩展。\n\n注意在这个例子中,其实「**假设**」的事情(写入压力突然增大)并没有发生,如果在日常压力不大,数据量不多的情况下,即使使用自增主键,从已有的基础监控中,可能也很难看出任何问题。但是到出事的时候,这个设计失误就会变成 **Unknown Unkowns(意外)**,这是任何人都不想看到的。有经验的架构师能通过种种的蛛丝马迹证实自己的推测,也从无数次翻车的 Post-mortem 中将 Unknown Unknowns 的范围变小。**但是更合理的做法是通过技术手段描绘系统更全面的状态。在 Cloud Native 和微服务的世界里,最近几年一个行业的大趋势是将「系统的可观测性」放在一个更高的位置(监控只是可观测性的一个子集),这是有道理的。**\n\n\n\n回到数据库的世界,TiDB KeyViz 的意义在于,就像上面提到的,这个工具不仅仅是一个监控工具,而且**它能以一个非常低门槛且形象的方式让架构师具象化的看到自己对于业务的「假设」是否符合预期,这些「假设」不一定是能够通过监控反映的,以获得对业务更深刻的 Insight。**\n\n还是说回上面那个主键的小例子。对于两种不同的主键设计,KeyViz 这边是怎么表现的呢?看看下面两张图,是不是非常一目了然?\n\n\n\n\n\n所以现在如果有朋友问我,“这个业务适不适合 TiDB?”我只需要通过录制线上流量,或者搭建一个从集群,只需要把 KeyViz 的图给我看一眼,我甚至都不需要压力测试就能判断这个业务是否适合,而且即使不适合,我也能准确的给出修改建议,因为 KeyViz 的图对我的「假设」的可解释性有了很强的支持。\n\n我们不妨在此基础上再放飞一下想象力,为什么人类能够一眼就从这图片中理解这些信息,这说明这些图形背后有**模式**,有模式我们就可以识别——\n\n想象一下,如果所有的 TiDB 用户,都使用 KeyViz 将自己的系统具象化后分享出来(其实这些图片已经高度抽象,已经不具有任何的业务机密信息),**我们是不是可以通过机器学习,挖掘背后更深层次的价值?AI 能不能通过这种形式更加理解我们的业务?**\n\n最后,我想以我最喜欢的科幻小说《三体:黑暗森林》中的一段话结束这篇文章,大致是面壁人希恩斯在冬眠后被妻子唤醒后的一个场景:\n\n>……与此同时,希恩斯感觉到围绕着他们的白雾发生了变化,雾被粗化了,显然是对某一局部进行了放大。他这时发现所谓的雾其实是由无数发光的小微粒组成的,那月光般的光亮是由这些小微粒自身发出的,而不是对外界光源的散射。放大在继续,小微粒都变成了闪亮的星星。希恩斯所看到的,并不是地球上的那种星空,他仿佛置身于银河系的核心,星星密密麻麻,几乎没有给黑夜留出空隙。\n>\n>“每一颗星星就是一个神经元。”山杉惠子说,一千亿颗星星构成的星海给他们的身躯镀上了银边。\n\n> 延展阅读:[做出让人爱不释手的基础软件:可观测性和可交互性](https://pingcap.com/zh/blog/how-to-develop-an-infrasoft-observability-and-interactivity) \n> [TiDB 4.0 新特性前瞻(一)拍个 CT 诊断集群热点问题](https://pingcap.com/zh/blog/tidb-4.0-key-visualizer)","date":"2020-02-22","author":"黄东旭","fillInMethod":"writeDirectly","customUrl":"observability-of-distributed-system","file":null,"relatedBlogs":[]},{"id":"Blogs_61","title":"分布式系统 in 2010s :测试和运维","tags":["分布式系统前沿技术"],"category":{"name":"观点洞察"},"summary":"本文为「分布式系统 in 2010s」 系列最终篇,这次我们来聊一聊测试和运维。","body":"我觉得面对测试的态度是区分一个普通程序员和优秀程序员的重要标准。现如今我们的程序和服务越来越庞大,光是单元测试 TDD 之类的就已经很难保证质量,不过这些都是 baseline,所以今天聊点新的话题。\n\n说测试之前,我们先问下自己,为什么要测试?当然是为了找 Bug。看起来这是句废话,但是仔细想想,如果我们能写出 Bug-free 的程序不就好了吗?何必那么麻烦。不过 100% 的 Bug-free 肯定是不行的,那么我们有没有办法能够尽可能地提升我们程序的质量?举个例子,我想到一个 Raft 的优化算法,与其等实现之后再测试,能不能在写代码前就知道这个算法理论上有没有问题?办法其实是有的,那就是形式化证明技术,比较常用的是 TLA+。\n\n## TLA+\n\nTLA+ 背后的思想很简单,TLA+ 会通过一套自己的 DSL(符号很接近数学语言)描述程序的初始状态以及后续状态之间的转换关系,同时根据你的业务逻辑来定义在这些状态切换中的不变量,然后 TLA+ 的 TLC model checker 对状态机的所有可达状态进行穷举,在穷举过程中不断检验不变量约束是否被破坏。\n\n举个简单的例子,分布式事务最简单的两阶段提交算法,对于 TLA+ Spec 来说,需要你定义好初始状态(例如事务要操作的 keys、有几个并发客户端等),然后定义状态间跳转的操作( Begin / Write / Read / Commit 等),最后定义不变量(例如任何处于 Committed 状态的 write ops 一定是按照 commit timestamp 排序的,或者 Read 的操作一定不会读到脏数据之类的),写完以后放到 TLC Checker 里面运行,等待结果就好。\n\n但是,我们活在一个不完美的世界,即使你写出了完美的证明,也很难保证你就是对的。第一, Simulator 并没有办法模拟出无限多的 paticipants 和并发度, 一般也就是三五个;第二,聪明的你可能也看出来了,一般 TLA+ 的推广文章也不会告诉你 Spec 的关键是定义不变量,如果不变量定义不完备,或者定义出错,那么证明就是无效的。因此,我认为形式化验证的意义在于让工程师在写代码之前提高信心,在写证明的过程中也能更加深对算法的理解,此外,如果在 TLC Checker 里就跑出异常,那就更好了。\n\n目前 PingCAP 应该是国内唯一一个使用 TLA+ 证明关键算法,并且将证明的 Spec 开源出来的公司,大家可以参考 [pingcap/tla-plus](https://github.com/pingcap/tla-plus) 这个 Repo,以及我们的首席架构师唐刘的这篇[博客](https://www.jianshu.com/p/721df5b4454b)了解更多。\n\n## Chaos Engineering\n\n如果完美的证明不存在,那么 Deterministic 的测试存在吗?我记得大概 2015 年在 PingCAP 成立前,我看到了一个 FoundationDB 关于他们的 Deterministic 测试的[演讲](https://www.youtube.com/watch?v=4fFDFbi3toc)。简单来说他们用自己的 IO 处理和多任务处理框架 [Flow](https://apple.github.io/foundationdb/flow.html) 将代码逻辑和操作系统的线程以及 IO 操作解耦,并通过[集群模拟器](https://apple.github.io/foundationdb/testing.html)做到了百分之百重现 Bug 出现时的事件顺序,同时可以在模拟器中精确模拟各种异常,确实很完美。但是考虑到现实的情况,我们当时选择使用的编程语言主要是 Go,很难或者没有必要做类似 Flow 的事情 。所以我们选择了从另一个方向解决这个问题,提升分布式环境下 Bug 的复现率,能方便复现的 Bug 就能好解决,这个思路也是最近几年很火的 Chaos Engineering。 做 Chaos Engineering 的几个关键点:\n\n1. 定义稳态,记录正常环境下的 workload 以及关注的重要指标。\n\n2. 定义系统稳态后,我们分为实验组和对照组进行实验,确认在理想的硬件情况下,无论如何操作实验组,最后都会回归稳态。\n\n3. 开始对底层的操作系统和网络进行破坏,再重复实验,观察实验组会不会回归稳态。\n\n道理大家都懂,但是实际做起来最大的问题在于如何将整个流程自动化。原因在于:一是靠手动的效率很低;二是正统的 Chaos Engineering 强调的是在生产环境中操作,如何控制爆炸半径,这也是个比较重要的问题。\n\n先说第一个问题,PingCAP 在实践 Chaos Engineering 的初期,都是在物理机上通过脚本启停服务,所有实验都需要手动完成,耗时且非常低效,在资源利用上也十分不合理。这个问题我们觉得正好是 K8s 非常擅长的,于是我们开发了一个基于 K8s 的,内部称为 Schrodinger 的自动化测试平台,将 TiDB 集群的启停镜像化,另外将 TiDB 本身的 CI/CD,自动化测试用例的管理、Fault Injection 都统一了起来。这个项目还催生出一个好玩的子项目 Chaos Operator:我们通过 CRD 来描述 Chaos 的类型,然后在不同的物理节点上启动一个 DaemonSets,这个 DaemonSets 就负责干扰 Pod,往对应的 Pod 里面注入一个 Sidecar,Sidecar 帮我们进行注入错误(例如使用 Fuse 来模拟 IO 异常,修改 iptable 制造网络隔离等),破坏 Pod。近期我们也有计划将 Chaos Operator 开源。\n\n第二个问题,其实在我看来,有 Chaos Engineering 仍然还是不够的,我们在长时间的对测试和质量的研究中发现提升测试质量的关键是如何发现更多的测试 workload。在早期我们大量依赖了 MySQL 和相关社区的集成测试,数量大概千万级别,这个决定让我们在快速迭代的同时保证质量,但是即使这样还是不够的,我们也在从学术界寻求答案.例如引入并通过官方的 Jepsen Test ,再例如通过 SQLfuzz 自动生成合法 SQL 的语句加入到测试集中,这个思路在最近我们的一次 Hackathon 项目中有一个很完美的落地,可以看看这篇介绍这个项目的文章[《你呼呼大睡,机器人却在找 bug?》](https://pingcap.com/blog-cn/sqldebug-automatically/)。\n\n总之,比起写业务逻辑,在分布式环境下写测试 + 写测试框架花费的精力可能一点都不少,甚至可能多很多(如果就从代码量来说,TiDB 的测试相关的代码行数可能比内核代码行数多一个数量级),而且这是一个非常值得研究和投资的领域。另外一个问题是如何通过测试发现性能回退。我们的测试平台中每天运行着一个名为 benchbot 的机器人,每天的回归测试都会自动跑性能测试,对比每日的结果。这样一来我们的工程师就能很快知道哪些变更导致了性能下降,以及得到一个长期性能变化趋势。\n\n## eBPF\n\n说完测试,另外一个相关的话题是 profiling 和分布式 tracing。tracing 看看 Google 的 Dapper 和开源实现 OpenTracing 就大概能理解,所以,我重点聊聊 profiling。最近这几年我关注的比较多的是 eBPF(extended BPF)技术。想象下,过去我们如果要开发一个 TCP filter,要么就自己写一个内核驱动,要么就用 libpcap 之类的基于传统 BPF 的库,而传统 BPF 只是针对包过滤这个场景设计的虚拟机,很难定制和扩展。\n\n\n\n 图 1 BPF 工作原理

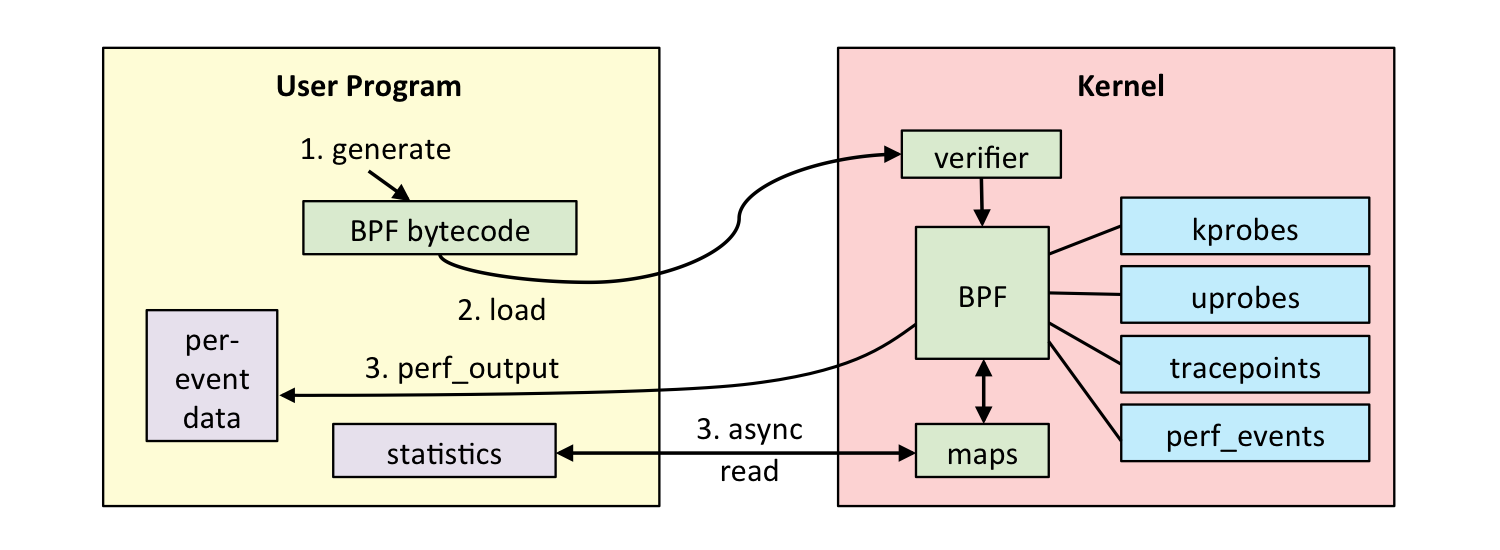

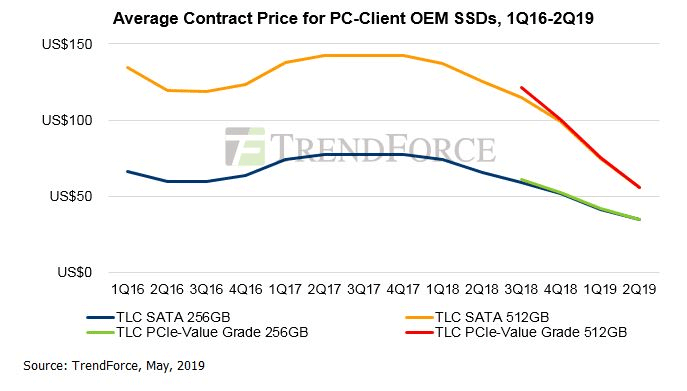

\n\n\n\n 图 2 eBPF 架构图

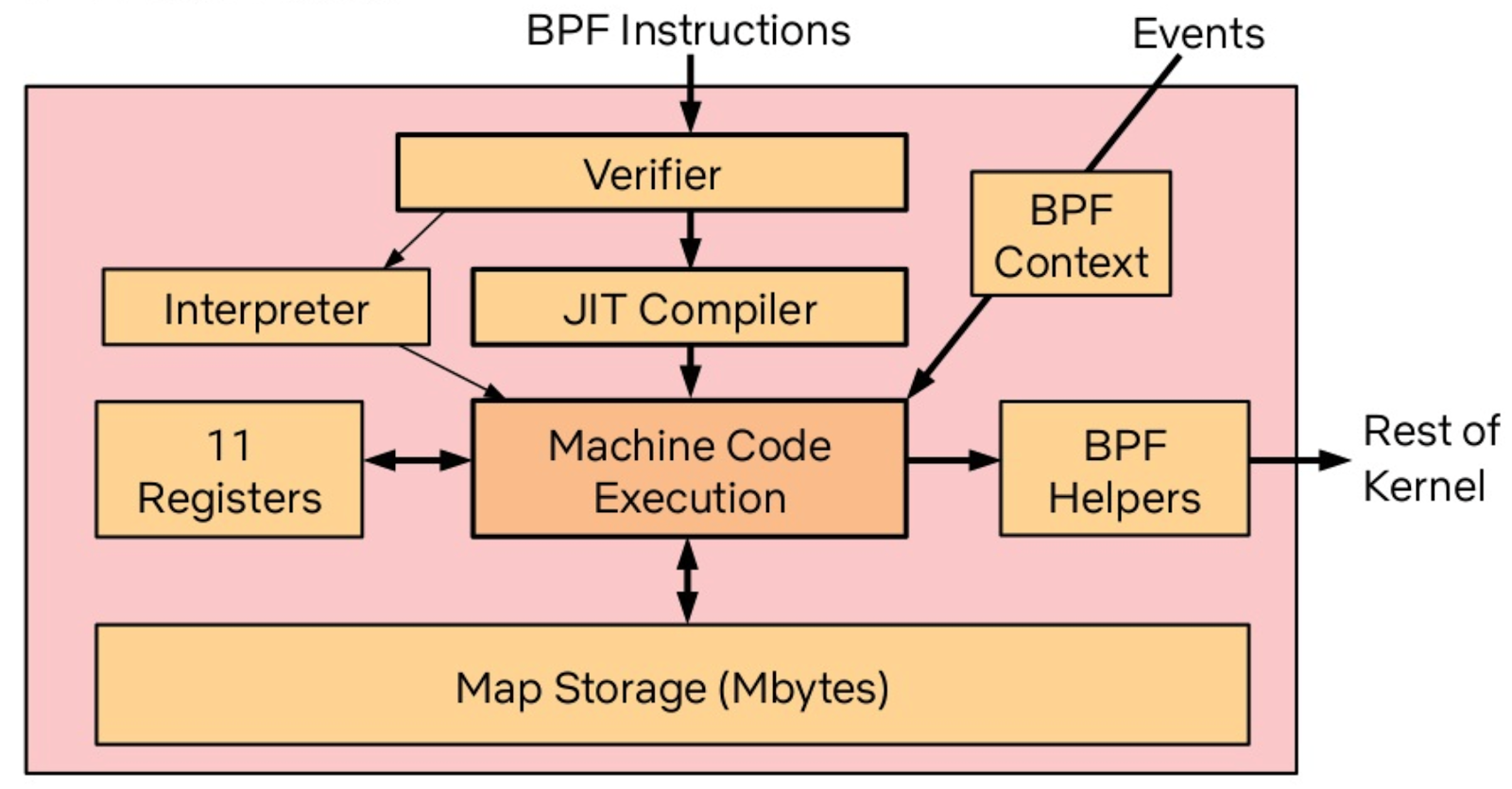

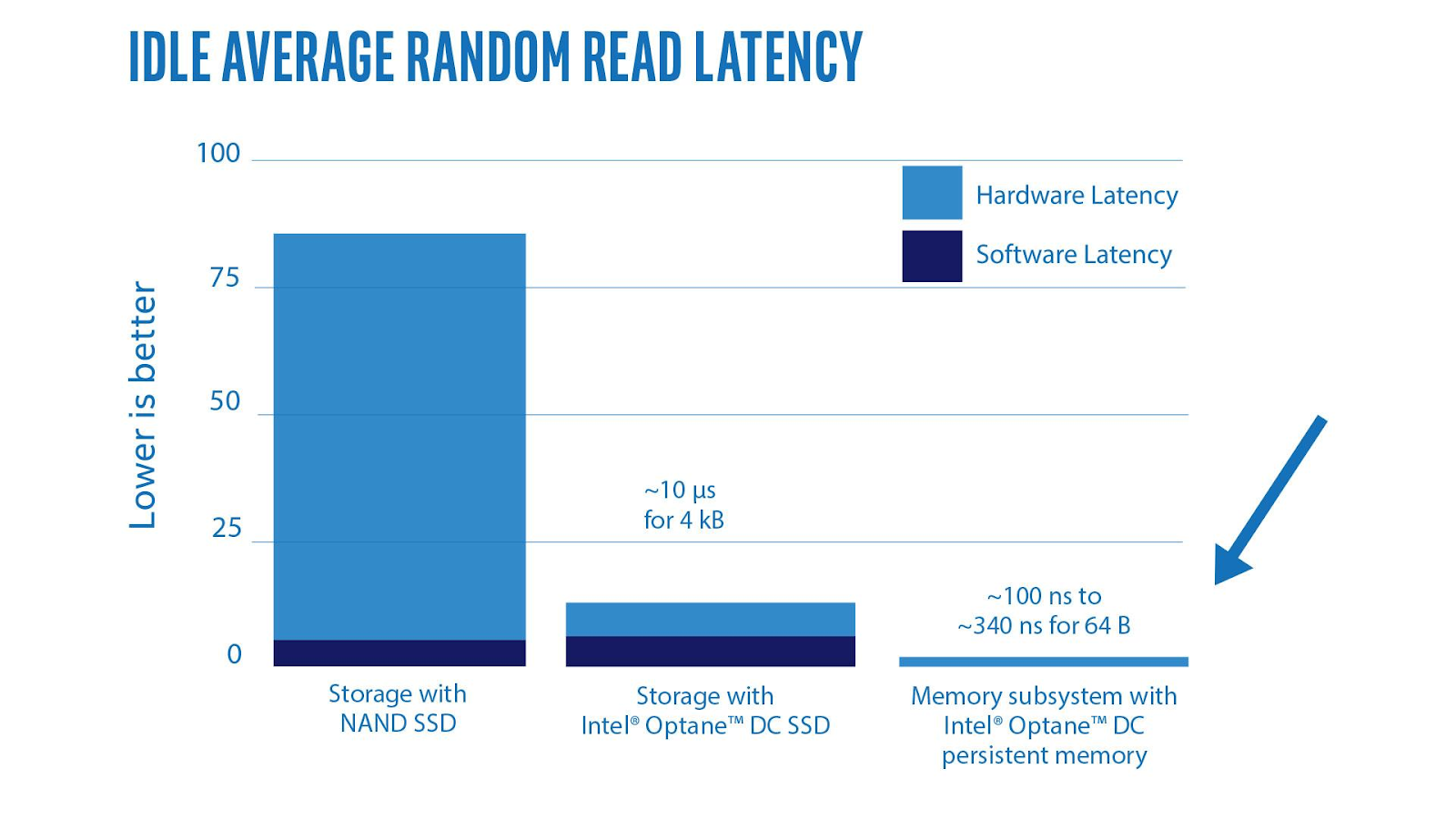

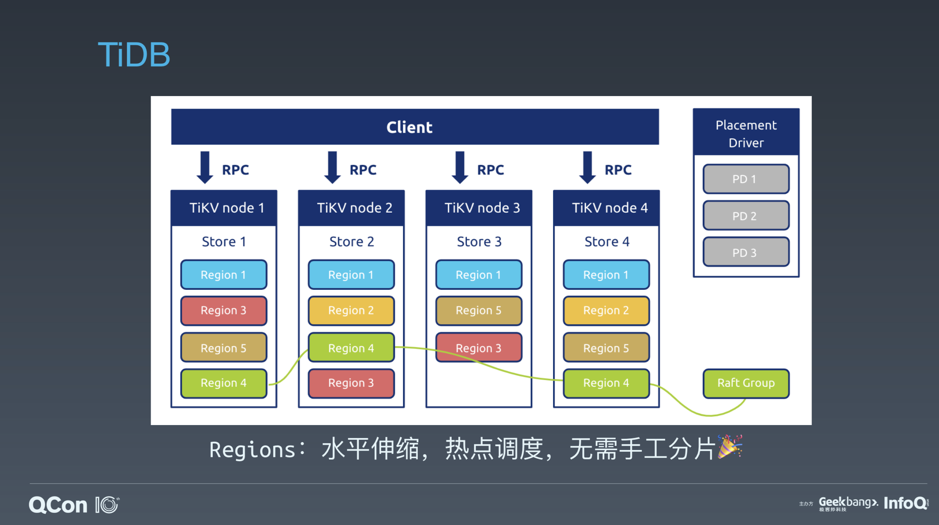

\n\n\n在这个背景下,eBPF 应运而生,eBPF 引入了 JIT 和寄存器,将 BPF 的功能进一步扩充,这背后的意义是,我们在内核中有一个安全的、高性能的、基于事件的、支持 JIT 的字节码的虚拟机!这其实极大地降低了拓展内核能力的门槛,我们可以不用担心在驱动中写个异常把内核搞崩,我们也可以将给 llvm 用的 clang 直接编译成 eBPF 对象,社区还有类似 bcc 这样的基于 Python 的实用工具集……\n\n过去其实大家是从系统状态监控、防火墙这个角度认识 eBPF 的。没错,性能监控以及防火墙确实是目前 eBPF 的王牌场景,但是我大胆地预测未来不止于此,就像最近 Brendan Gregg 在他的 blog 里喊出的口号:BPF is a new type of software。可能在不久的未来,eBPF 社区能诞生出更多好玩的东西,例如我们能不能用 eBPF 来做个超高性能的 web server?能不能做个 CDN 加速器?能不能用 BPF 来重定义操作系统的进程调度?我喜欢 eBPF 的另一个重要原因是,第一次内核应用开发者可以无视内核的类型和版本,只要内核能够运行 eBPF bytecode 就可以了,真正做到了一次编译,各个内核运行。所以有一种说法是 BPF is eating Linux,也不是没有道理 。\n\nPingCAP 也已经默默地在 BPF 社区投入了很长时间,我们也将自己做的一些 bcc 工具开源了,详情可以参考 [pingcap/kdt](https://github.com/pingcap/kdt) 这个 repo。其中值得一提的是,我们的 bcc 工具之一 drsnoop 被 Brendan Gregg 的新书收录了,也算是为社区做出了一点微小的贡献。\n\n上面聊的很多东西都是具体的技术,技术的落地离不开部署和运维,分布式系统的特性决定了维护的复杂度比单机系统大得多。在这个背景之下,我认为解法可能是:不可变基础设施。\n\n云和容器的普及让 infrastructure as code 的理念得以变成现实,通过描述式的语言来创建可重复的部署体验,这样可重用的描述其实很方便在开源社区共享,而且由于这些描述几乎是和具体的云的实现无关,对于跨云部署和混合数据中心部署的场景很适合。有些部署工具甚至诞生出自己的生态系统,例如 Terraform / Chef / Ansible。有一种说法戏称现在的运维工程师都是 yaml 语言工程师,其实很有道理的:人总是会出错,且传统的基于 shell 脚本的运维部署受环境影响太大,shell 天然也不是一个非常严谨的语言。描述意图,让机器去干事情,才是能 scale 的正道。\n\n> 相关阅读: \n[分布式系统 in 2010s :存储之数据库篇](https://pingcap.com/zh/blog/distributed-system-in-2010s-1); \n[分布式系统 in 2010s :软件构建方式和演化](https://pingcap.com/zh/blog/distributed-system-in-2010s-2); \n> [分布式系统 in 2010s :硬件的进化](https://pingcap.com/zh/blog/distributed-system-in-2010s-3)。","date":"2020-01-14","author":"黄东旭","fillInMethod":"writeDirectly","customUrl":"distributed-system-in-2010s-4","file":null,"relatedBlogs":[]},{"id":"Blogs_237","title":"分布式系统 in 2010s :硬件的进化","tags":["分布式系统前沿技术"],"category":{"name":"观点洞察"},"summary":"本文为「分布式系统 in 2010s」 系列第三篇,这次我们来聊一聊硬件的进化。","body":"[上篇](https://pingcap.com/blog-cn/distributed-system-in-2010s-2/)我们聊了软件构建方式和演化,今天我们来聊聊硬件吧!\n\n## SSD 普及的深远影响\n\n如果说云的出现是一种商业模式的变化的话,驱动这个商业革命的推手就是最近十年硬件的快速更新。比起 CPU,存储和网络设备的进化速度更加迅速。最近五年,SSD 的价格 (包括 PCIe 接口) 的成本持续下降,批量采购的话已经几乎达到和 HDD 接近的价格。\n\n\n\n 图 1 近 5 年 SSD 成本曲线

\n\nSSD 的普及,对于存储软件厂商的影响是深远的。\n\n其一,是极大地缓解了 IO 瓶颈。对于数据库厂商来说,可以将更多的精力花在其他事情,而不是优化存储引擎上。最近两年发生了一些更大的变化,NVMe 正在成为主流,我们很早就在 Intel Optane 进行实验和投资,类似这样的非易失内存的技术,正在模糊内存和存储的界限,但是同时对开发者带来挑战也是存在的。举一个简单的例子,对于 Optane 这类的非易失内存,如果你希望能够完全利用它的性能优势,最好使用类似 PMDK 这类基于 Page cache Bypass 的 SDK 针对你的程序进行开发,这类 SDK 的核心思想是将 NVM 设备真正地当做内存使用。如果仅仅将 Optane 挂载成本地磁盘使用,其实很大程度上的瓶颈不一定出现在硬件本身的 IO 上。\n\n下面这张图很有意思,来自 Intel 对于 Optane 的测试,我们可以看见在中间那一列,Storage with Optane SSD,随机读取的硬件延迟已经接近操作系统和文件系统带来的延迟,甚至 Linux VFS 本身会变成 CPU 瓶颈。其实背后的原因也很简单,过去由于 VFS 本身在 CPU 上的开销(比如锁)相比过去的 IO 来说太小了,但是现在这些新硬件本身的 IO 延迟已经低到让文件系统本身开销的比例不容忽视了。\n\n\n\n 图 2 Intel 对于 Optane 的测试

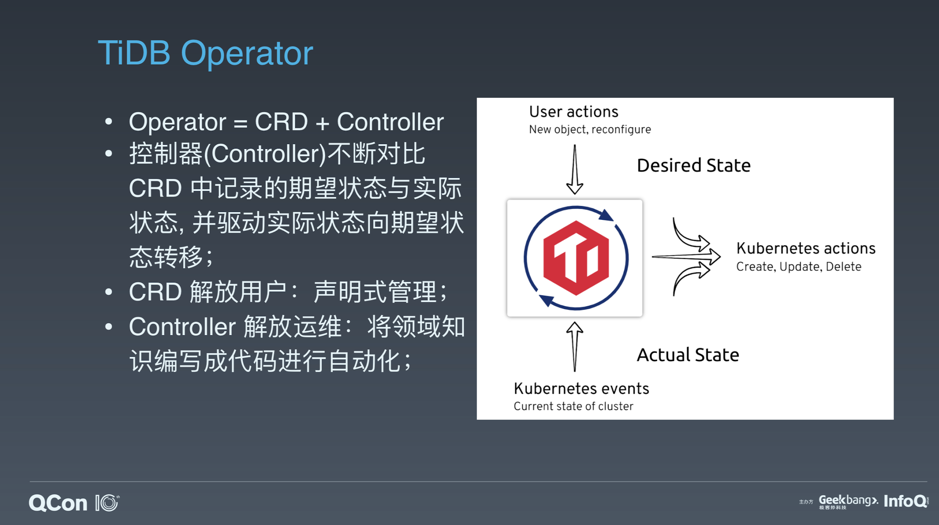

\n\n其二,这个变化影响了操作系统和文件系统本身。例如针对 Persistent Memory 设计新的文件系统,其中来自 UCSD 的 NVSL 实验室 (名字很厉害, Non-Volatile Systems Laboratory) 的 [NovaFS](https://lwn.net/Articles/749009/) 就是一个很好的例子。简单来说是大量使用了无锁数据结构,减低 CPU 开销,NovaFS 的代码量很小很好读,有兴趣可以看看。另外 Intel 对 Persistent Memory 编程模型有很好的一篇[文章](https://software.intel.com/en-us/articles/introduction-to-programming-with-persistent-memory-from-intel),感兴趣的话可以从这里开始了解这些新变化。\n\n## 内核开销的挑战\n\n说完了存储设备,我们聊聊网络设备。我还记得我第一份工作的数据中心里甚至还有百兆的网卡,但现在,1GbE 已经都快淘汰光了,主流的数据中心基本上开始提供 10GbE 甚至 25GbE 的网络。为什么会变成这样?我们做一个简单的算术题就知道了。根据 Cisco 的[文档介绍](https://tools.cisco.com/security/center/resources/network_performance_metrics), 一块千兆网卡的吞吐大概是: [1,000,000,000 b/s / (84 B * 8 b/B)] == 1,488,096 f/s (maximum rate)。\n\n那么万兆网卡的吞吐大概是它的十倍,也就是差不多每秒 1488 万帧,处理一个包的时间在百纳秒的级别,基本相当于一个 L2 Cache Miss 的时间。所以如何减小内核协议栈处理带来的内核-用户态频繁内存拷贝的开销,成为一个很重要的课题,这就是为什么现在很多高性能网络程序开始基于 DPDK 进行开发。\n\n对于不了解 DPDK 的朋友,在这里[简单科普一下](https://www.dpdk.org/wp-content/uploads/sites/35/2016/10/Day02-Session05-JingjingWu-Userspace2016.pdf):\n\n\n\n 图 3 DPDK Flow Bifurcation

\n\n从上图可以看到,数据包直接从网卡到了 DPDK,绕过了操作系统的内核驱动、协议栈和 Socket Library。DPDK 内部维护了一个叫做 UIO Framework 的用户态驱动 (PMD),通过 ring queue 等技术实现内核到用户态的 zero-copy 数据交换,避免了 Syscall 和内核切换带来的 cache miss,而且在多核架构上通过多线程和绑核,极大提升了报文处理效率。如果你确定你的网络程序瓶颈在包处理效率上,不妨关注一下 DPDK。\n\n另外 RDMA 对未来体系结构的影响也会很大,它会让一个分布式集群向一个超级 NUMA 的架构演进(它的通信延时/带宽已经跟现在 NUMA 架构中连接不同 socket node 的 QPI 的延时/带宽在一个量级),但是目前受限于成本和开发模型的变化,可能还需要等很长一段时间才能普及。\n\n其实不管是 DPDK,SPDK,PMDK ,背后的主线都是 Bypass kernel,Linux 内核本身带来的开销已经很难适应现代硬件的发展,但是生态和兼容性依然是大的挑战,我对于一言不合就搞个 Bypass Kernel SDK 的做法其实是不太赞同的。大量的基础软件需要适配,甚至整个开发模型都要变化。\n\n我认为有关内核的问题,内核社区从长期来看一定会解决。一个值得关注的技术是 Linux 5.1 内核中引入的 io_uring 系列的新系统调用,io_uring 的原理简单来说就是通过两个内核/用户态共享的 ring buffer 来实现 IO 事件的提交以及收割,避免了 syscall 及内核<->用户态的内存拷贝,同时提供了 poll 的模式, 不用等待硬件中断,而是不断轮询硬件,这极大降低了 IO 延迟,提升了整体吞吐。 我认为 io_uring 的出现也代表了内核社区在各种 Bypass Kernel 技术涌现的当下,正在奋起直追。\n\n> 相关阅读: \n[分布式系统 in 2010s :存储之数据库篇](https://pingcap.com/zh/blog/distributed-system-in-2010s-1); \n[分布式系统 in 2010s :软件构建方式和演化](https://pingcap.com/zh/blog/distributed-system-in-2010s-2); \n> [分布式系统 in 2010s :测试和运维](https://pingcap.com/zh/blog/distributed-system-in-2010s-4)。","date":"2020-01-07","author":"黄东旭","fillInMethod":"writeDirectly","customUrl":"distributed-system-in-2010s-3","file":null,"relatedBlogs":[]},{"id":"Blogs_281","title":"分布式系统 in 2010s :软件构建方式和演化","tags":["分布式系统前沿技术"],"category":{"name":"观点洞察"},"summary":"本文为「分布式系统 in 2010s」系列第二篇,内容为软件构建的方式和演化。","body":"我上大学的时候专业是软件工程,当时的软件工程是 CMM、瀑布模型之类。十几年过去了,看看现在我们的软件开发模式,尤其是在互联网行业,敏捷已经成为主流,很多时候老板说业务下周上线,那基本就是怎么快怎么来,所以现代架构师对于可复用性和弹性会有更多的关注。我所知道业界对 SOA 的关注是从 Amazon 的大规模 SOA 化开始, 2002 年 Bezos 要求 Amazon 的工程团队将所有的业务 API 和服务化,[几条原则](https://www.cio.com/article/3218667/have-you-had-your-bezos-moment-what-you-can-learn-from-amazon.html)放在今天仍然非常适用:\n\n>- All teams will henceforth expose their data and functionality through service interfaces.\n>\n>- Teams must communicate with each other through these interfaces.\n>\n>- There will be no other form of inter-process communication allowed: no direct linking, no direct reads of another team’s data store, no shared-memory model, no back-doors whatsoever. The only communication allowed is via service interface calls over the network.\n>\n>- It doesn’t matter what technology they use.\n>\n>- All service interfaces, without exception, must be designed from the ground up to be externalizable. That is to say, the team must plan and design to be able to expose the interface to developers in the outside world. No exceptions.\n\n尤其最后一条,我个人认为对于后来的 AWS 的诞生有直接的影响,另外这条也间接地对工程团队的软件质量和 API 质量提出了更高的要求。亚马逊在 SOA 上的实践是组件化在分布式环境中的延伸,尽可能地将业务打散成最细粒度的可复用单元(Services),新的业务通过组合的方式构建。这样的原则一直发展到今天,我们提到的微服务、甚至 Serverless,都是这个思想的延伸。\n\n## SOA 只是一个方法论\n\n很多人在思考 SOA 和微服务的区别时,经常有一些观点类似:「拆的粗就是 SOA,拆的细就是微服务 」,「使用 RESTful API 就是微服务,用 RPC 是 SOA」,「使用 XXX(可以是任何流行的开源框架) 的是微服务,使用 YYY 的是 SOA」... 这些观点我其实并不认可,我理解的 SOA 或者微服务只是一个方法论,核心在于有效地拆分应用,实现敏捷构建和部署,至于使用什么技术或者框架其实无所谓,甚至 SOA 本身就是反对绑定在某项技术上的。\n\n对于架构师来说, 微服务化也并不是灵丹妙药,有一些核心问题,在微服务化的实践中经常会遇到:\n\n1. 服务的拆分粒度到底多细?\n\n2. 大的单体服务如何避免成为单点,如何支持快速的弹性水平扩展?\n\n3. 如何进行流控和降级?防止调用者 DDoS?\n\n4. 海量服务背景下的 CI/CD (测试,版本控制,依赖管理),运维(包括 tracing,分布式 metric 收集,问题排查)\n\n … … \n \n上面几个问题都很大。熟悉多线程编程的朋友可能比较熟悉 Actor 模型,我认为 Actor 的思想和微服务还是很接近的,同样的最佳实践也可以在分布式场景下适用,事实上 Erlang OTP 和 Scala 的 Akka Framework 都尝试直接将 Actor 模型在大规模分布式系统中应用。其实在软件工程上这个也不是新的东西,Actor 和 CSP 的概念几乎在软件诞生之初就存在了,现在服务化的兴起我认为是架构复杂到一定程度后很自然的选择,就像当年 CSP 和 Actor 简化并发编程一样。\n\n## 服务化和云\n\n从服务化的大方向和基础设施方面来说,我们这几年经历了:本地单体服务 + 私有 API (自建数据中心,自己运维管理) -> 云 IaaS + 本地服务 + 云提供的 Managed Service (例如 EC2 + RDS) -> Serverless 的转变。其本质在于云的出现让开发者对于硬件控制力越来越低,算力和服务越来越变成标准化的东西。而容器的诞生,使得资源复用的粒度进一步的降低(物理机 -> VM -> Container),这无疑是云厂商非常希望看到的。对公有云厂商来说,资源分配的粒度越细越轻量,就越能精准地分配,以提升整体的硬件资源利用率,实现效益最大化。\n\n这里暗含着一个我的观点:公有云和私有云在价值主张和商业模式上是不一样的:对公有云来说,只有不断地规模化,通过不断提升系统资源的利用率,获取收益(比如主流的公有云几乎对小型实例都会超卖)。而私有云的模式可以概括成降低运维成本(标准化服务 + 自动化运维),对于自己拥有数据中心的企业来说,通过云技术提升硬件资源的利用率是好事,只是这个收益并没有公有云的规模化收益来得明显。\n\n在服务化的大背景下,也产生了另外一个趋势,就是基础软件的垂直化和碎片化,当然这也是和现在的 workload 变得越来越大,单一的数据库软件或者开发框架很难满足多变且极端的需求有关。数据库、对象存储、RPC、缓存、监控这几个大类,几乎每位架构师都熟悉多个备选方案,根据不同需求排列组合,一个 Oracle 包打天下的时代已经过去了。\n\n这样带来的结果是数据或状态在不同系统之间的同步和传递成为一个新的普遍需求,这就是为什么以 Kafka,Pulsar 为代表的分布式的消息队列越来越流行。但是在异构数据源之间的同步,暗含了异步和不一致(如果需要一致性,那么就需要对消费者实现幂等的语义),在一些对一致性有极端需求的场景,仍然需要交给数据库处理。 \n\n在这种背景下,容器的出现将计算资源分配的粒度进一步的降低且更加标准化,硬件对于开发者来说越来越透明,而且随着 workload 的规模越来越大,就带来的一个新的挑战:海量的计算单元如何管理,以及如何进行服务编排。既然有编排这里面还隐含了另外一个问题:服务的生命周期管理。\n\n## Kubernetes 时代开始了\n\n其实在 Kubernetes 诞生之前,很多产品也做过此类尝试,例如 Mesos。Mesos 早期甚至并不支持容器,主要设计的目标也是短任务(后通过 Marathon Framework 支持长服务),更像一个分布式的工作流和任务管理(或者是分布式进程管理)系统,但是已经体现了 Workload 和硬件资源分离的思想。\n\n在前 Kubernetes 时代,Mesos 的设计更像是传统的系统工程师对分布式任务调度的思考和实践,而 K8s 的野心更大,从设计之初就是要在硬件层之上去抽象所有类型的 workload,构建自己的生态系统。如果说 Mesos 还是个工具的话,那么 K8s 的目标其实是奔着做一个分布式操作系统去的。简单做个类比:整个集群的计算资源统一管控起来就像一个单机的物理计算资源,容器就像一个个进程,Overlay network 就像进程通信,镜像就像一个个可执行文件,Controller 就像 Systemd,Kubectl 就像 Shell……同样相似的类比还有很多。\n\n从另一方面看,Kubernetes 为各种 IaaS 层提供了一套标准的抽象,不管你底层是自己的数据中心的物理机,还是某个公有云的 VM,只要你的服务是构建在 K8s 之上,那么就获得了无缝迁移的能力。K8s 就是一个更加中立的云,在我的设想中,未来不管是公有云还是私有云都会提供标准 K8s 能力。对于业务来说,基础架构的上云,最安全的路径就是上 K8s,目前从几个主流的公有云厂商的动作上来看(GCP 的 GKE,AWS 的 EKS,Azure 的 AKS),这个假设是成立的。\n\n不选择 K8s 的人很多时候会从性能角度来攻击 K8s,理由是:多一层抽象一定会损害性能。对于这个我是不太同意的。从网络方面说,大家可能有个误解,认为 Overlay Network 的性能一定不好,其实这不一定是事实。下面这张图来自 ITNEXT 的工程师对几个流行的 CNI 实现的[评测](https://itnext.io/benchmark-results-of-kubernetes-network-plugins-cni-over-10gbit-s-network-36475925a560): \n\n\n\n Kubernetses CNI benchmark

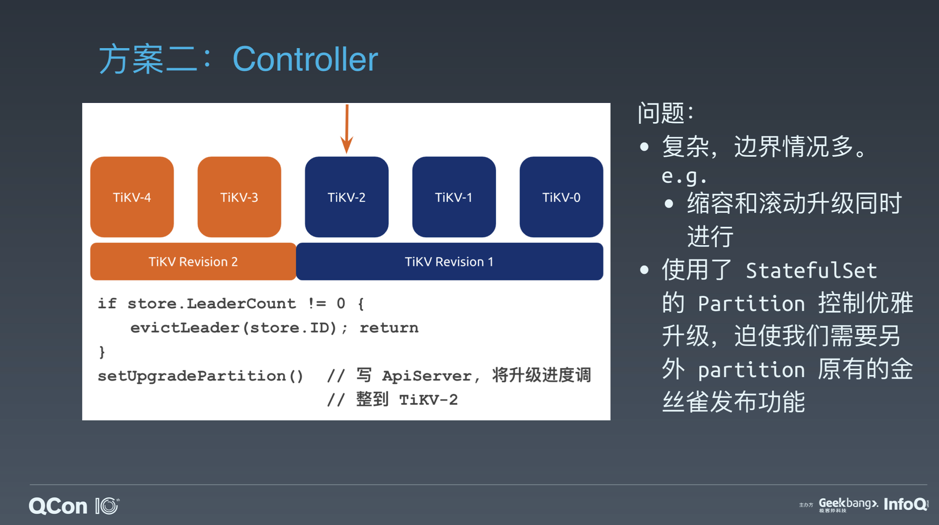

\n\n我们其实可以看到,除了 WaveNet Encrypted 因为需要额外的加密导致性能不佳以外,其它的 CNI 实现几乎已经和 Bare metal 的 host network 性能接近,出现异常的网络延迟大多问题是出现在 iptable NAT 或者 Ingress 的错误配置上面。 \n\n所以软件的未来在哪里?我个人的意见是硬件和操作系统对开发者会更加的透明,也就是现在概念刚开始普及起来的 Serverless。我经常用的一个比喻是:如果自己维护数据中心,采购服务器的话,相当于买房;使用云 IaaS 相当于租房;而 Serverless,相当于住酒店。长远来看,这三种方案都有各自适用的范围,并不是谁取代谁的关系。目前看来 Serverless 因为出现时间最短,所以发展的潜力也是最大的。\n\n从服务治理上来说,微服务的碎片化必然导致了管理成本上升,所以近年 Service Mesh (服务网格)的概念才兴起。 服务网格虽然名字很酷,但是其实可以想象成就是一个高级的负载均衡器或服务路由。比较新鲜的是 Sidecar 的模式,将业务逻辑和通信解耦。我其实一直相信未来在七层之上,会有一层以 Service Mesh 和服务为基础的「八层网络」,不过目前并没有一个事实标准出现。Istio 的整体架构过于臃肿,相比之下我更加喜欢单纯使用 Envoy 或者 Kong 这样更加轻量的 API Proxy。 不过我认为目前在 Service Mesh 领域还没有出现有统治地位的解决方案,还需要时间。\n\n> 相关阅读: \n[分布式系统 in 2010s :存储之数据库篇](https://pingcap.com/zh/blog/distributed-system-in-2010s-1); \n[分布式系统 in 2010s :硬件的进化](https://pingcap.com/zh/blog/distributed-system-in-2010s-3); \n> [分布式系统 in 2010s :测试和运维](https://pingcap.com/zh/blog/distributed-system-in-2010s-4)。","date":"2019-12-30","author":"黄东旭","fillInMethod":"writeDirectly","customUrl":"distributed-system-in-2010s-2","file":null,"relatedBlogs":[]},{"id":"Blogs_27","title":"分布式系统 in 2010s :存储之数据库篇","tags":["分布式系统前沿技术"],"category":{"name":"观点洞察"},"summary":"无论哪个时代,存储都是一个重要的话题,今天先聊聊数据库。","body":"回看这几年,分布式系统领域出现了很多新东西,特别是云和 AI 的崛起,让这个过去其实不太 sexy 的领域一下到了风口浪尖,在这期间诞生了很多新技术、新思想,让这个古老的领域重新焕发生机。站在 2010s 的尾巴上,我想跟大家一起聊聊分布式系统令人振奋的进化路程,以及谈一些对 2020s 的大胆猜想。\n\n无论哪个时代,存储都是一个重要的话题,今天先聊聊数据库。在过去的几年,数据库技术上出现了几个很明显的趋势。\n\n## 存储和计算进一步分离\n\n我印象中最早的存储-计算分离的尝试是 Snowflake,Snowflake 团队在 2016 年发表的论文[《The Snowflake Elastic Data Warehouse》](http://pages.cs.wisc.edu/~remzi/Classes/739/Spring2004/Papers/p215-dageville-snowflake.pdf)是近几年我读过的最好的大数据相关论文之一,尤其推荐阅读。Snowflake 的架构关键点是在无状态的计算节点 + 中间的缓存层 + S3 上存储数据,计算并不强耦合缓存层,非常符合云的思想。从最近 AWS 推出的 RedShift 冷热分离架构来看,AWS 也承认 Snowflake 这个搞法是先进生产力的发展方向。另外这几年关注数据库的朋友不可能不注意到 Aurora。不同于 Snowflake,Aurora 应该是第一个将存储-计算分离的思想用在 OLTP 数据库中的产品,并大放异彩。Aurora 的成功在于将数据复制的粒度从 Binlog降低到 Redo Log ,极大地减少复制链路上的 IO 放大。而且前端复用了 MySQL,基本做到了 100% 的应用层 MySQL 语法兼容,并且托管了运维,同时让传统的 MySQL 适用范围进一步拓展,这在中小型数据量的场景下是一个很省心的方案。\n\n虽然 Aurora 获得了商业上的成功,但是从技术上,我并不觉得有很大的创新。熟悉 Oracle 的朋友第一次见 Aurora 的架构可能会觉得和 RAC 似曾相识。Oracle 大概在十几年前就用了类似的方案,甚至很完美的解决了 Cache Coherence 的问题。另外,Aurora 的 Multi-Master 还有很长的路要走,从最近在 ReInvent 上的说法来看,目前 Aurora 的 Multi-Master 的主要场景还是作为 Single Writer 的高可用方案,本质的原因应该是目前 Multi-Writer 采用乐观冲突检测,冲突检测的粒度是 Page,在冲突率高的场合会带来很大的性能下降。\n\n我认为 Aurora 是一个很好的迎合 90% 的公有云互联网用户的方案:100% MySQL 兼容,对一致性不太关心,读远大于写,全托管。但同时,Aurora 的架构决定了它放弃了 10% 有极端需求的用户,如全局的 ACID 事务+ 强一致,Hyper Scale(百 T 以上,并且业务不方便拆库),需要实时的复杂 OLAP。这类方案我觉得类似 TiDB 的以 Shared-nothing 为主的设计才是唯一的出路。作为一个分布式系统工程师,我对任何不能水平扩展的架构都会觉得不太优雅。\n\n## 分布式 SQL 数据库登上舞台,ACID 全面回归\n\n回想几年前 NoSQL 最风光的时候,大家恨不得将一切系统都使用 NoSQL 改造,虽然易用性、扩展性和性能都不错,但是多数 NoSQL 系统抛弃掉数据库最重要的一些东西,例如 ACID 约束,SQL 等等。NoSQL 的主要推手是互联网公司,对于互联网公司的简单业务加上超强的工程师团队来说当然能用这些简单工具搞定。\n\n但最近几年大家渐渐发现低垂的果实基本上没有了,剩下的都是硬骨头。\n\n最好的例子就是作为 NoSQL 的开山鼻祖,Google 第一个搞了 NewSQL (Spanner 和 F1)。在后移动时代,业务变得越来越复杂,要求越来越实时,同时对于数据的需求也越来越强。尤其对于一些金融机构来说,一方面产品面临着互联网化,一方面不管是出于监管的要求还是业务本身的需求,ACID 是很难绕开的。更现实的是,大多数传统公司并没有像顶级互联网公司的人才供给,大量历史系统基于 SQL 开发,完全迁移到 NoSQL 上肯定不现实。\n\n在这个背景下,分布式关系型数据库,我认为这是我们这一代人,在开源数据库这个市场上最后一个 missing part,终于慢慢流行起来。这背后的很多细节由于篇幅的原因我就不介绍,推荐阅读 PingCAP TiFlash 技术负责人 maxiaoyu 的一篇文章《[从大数据到数据库](https://pingcap.com/zh/blog/from-big-data-to-databases)》,对这个话题有很精彩的阐述。\n\n## 云基础设施和数据库的进一步整合\n\n在过去的几十年,数据库开发者都像是在单打独斗,就好像操作系统以下的就完全是黑盒了,这个假设也没错,毕竟软件开发者大多也没有硬件背景。另外如果一个方案过于绑定硬件和底层基础设施,必然很难成为事实标准,而且硬件非常不利于调试和更新,成本过高,这也是我一直对定制一体机不是太感兴趣的原因。但是云的出现,将 IaaS 的基础能力变成了软件可复用的单元,我可以在云上按需地租用算力和服务,这会给数据库开发者在设计系统的时候带来更多的可能性,举几个例子:\n\n1. Spanner 原生的 TrueTime API 依赖原子钟和 GPS 时钟,如果纯软件实现的话,需要牺牲的东西很多(例如 CockroachDB 的 HLC 和 TiDB 的改进版 Percolator 模型,都是基于软件时钟的事务模型)。但是长期来看,不管是 AWS 还是 GCP 都会提供类似 TrueTime 的高精度时钟服务,这样一来我们就能更好的实现低延迟长距离分布式事务。\n\n2. 可以借助 Fargate + EKS 这种轻量级容器 + Managed K8s 的服务,让我们的数据库在面临突发热点小表读的场景(这个场景几乎是 Shared-Nothing 架构的老大难问题),比如在 TiDB 中通过 Raft Learner 的方式,配合云的 Auto Scaler 快速在新的容器中创建只读副本,而不是仅仅通过 3 副本提供服务;比如动态起 10 个 pod,给热点数据创建 Raft 副本(这是我们将 TiKV 的数据分片设计得那么小的一个重要原因),处理完突发的读流量后再销毁这些容器,变成 3 副本。\n\n3. 冷热数据分离,这个很好理解,将不常用的数据分片,分析型的副本,数据备份放到 S3 上,极大地降低成本。\n\n4. RDMA/CPU/超算 as a Service,任何云上的硬件层面的改进,只要暴露 API,都是可以给软件开发者带来新的好处。\n\n例子还有很多,我就不一一列举了。总之我的观点是云服务 API 的能力会像过去的代码标准库一样,是大家可以依赖的东西,虽然现在公有云的 SLA 仍然不够理想,但是长远上看,一定是会越来越完善的。\n\n所以,数据库的未来在哪里?是更加的垂直化还是走向统一?对于这个问题,我同意这个世界不存在银弹,但是我也并不像我的偶像,AWS 的 CTO,Vogels 博士那么悲观,相信未来是一个割裂的世界(AWS 恨不得为了每个细分的场景设计一个数据库)。过度地细分会加大数据在不同系统中流动的成本。解决这个问题有两个关键:\n\n1. 数据产品应该切分到什么粒度?\n\n2. 用户可不可以不用知道背后发生了什么?\n\n第一个问题并没有一个明确的答案,但是我觉得肯定不是越细越好的,而且这个和 Workload 有关,比如如果没有那么大量的数据,直接在 MySQL 或者 PostgreSQL 上跑分析查询其实一点问题也没有,没有必要非去用 Redshift。虽然没有直接的答案,但是我隐约觉得第一个问题和第二个问题是息息相关的,毕竟没有银弹,就像 OLAP 跑在列存储引擎上一定比行存引擎快,但是对用户来说其实可以都是 SQL 的接口。\n\nSQL 是一个非常棒的语言,它只描述了用户的意图,而且完全与实现无关,对于数据库来说,其实可以在 SQL 层的后面来进行切分,在 TiDB 中,我们引入 TiFlash 就是一个很好的例子。动机很简单:\n\n1. 用户其实并不是数据库专家,你不能指望用户能 100% 在恰当的时间使用恰当的数据库,并且用对。\n\n2. 数据之间的同步在一个系统之下才能尽量保持更多的信息,例如,TiFlash 能保持 TiDB 中事务的 MVCC 版本,TiFlash 的数据同步粒度可以小到 Raft Log 的级别。\n\n另外一些新的功能仍然可以以 SQL 的接口对外提供,例如全文检索,用 SQL 其实也可以简洁的表达。这里我就不一一展开了。\n\n我其实坚信系统一定是朝着更智能、更易用的方向发展的,现在都 21 世纪了,你是希望每天拿着一个 Nokia 再背着一个相机,还是直接一部手机搞定?\n\n> 相关阅读: \n[分布式系统 in 2010s :软件构建方式和演化](https://pingcap.com/zh/blog/distributed-system-in-2010s-2); \n[分布式系统 in 2010s :硬件的进化](https://pingcap.com/zh/blog/distributed-system-in-2010s-3); \n> [分布式系统 in 2010s :测试和运维](https://pingcap.com/zh/blog/distributed-system-in-2010s-4)。","date":"2019-12-26","author":"黄东旭","fillInMethod":"writeDirectly","customUrl":"distributed-system-in-2010s-1","file":null,"relatedBlogs":[]},{"id":"Blogs_123","title":"从大数据到数据库","tags":["大数据","数据库"],"category":{"name":"观点洞察"},"summary":"作为一个从大数据转行做数据库的人,我自以为能感受到两个世界的异同。本篇文章,斗胆聊下这个话题,以及对未来的看法。","body":"作为一个从大数据转行做数据库的人,我自以为能感受到两个世界的异同。在这里,斗胆聊下这个话题,以及对未来的看法。\n\n## 大数据兴起\n\n从 70 年代关系型数据库进入历史舞台,很长一段时间它几乎是包打天下的选择。你很可能可以用一套数据库玩转所有业务,你也不需要一个连的工程师来维护她。哪怕你也许业务复杂,需要不同的数据库,但她们终究是还是数据库,温柔体贴。\n\n这个黄金时代整整延续了 20 多年。\n\n上世纪 90 年代人们开始讨论「Big Data」。SGI 首席科学家 John Mashey 在一个名为「[Big Data… and the Next Wave of Infrastress](https://static.usenix.org/event/usenix99/invited_talks/mashey.pdf)」让这个词汇变得流行。那个时候,人们讨论着硬盘容量和网络带宽,在未来数据爆炸的阴影下瑟瑟发抖。那个时候,互联网公司是第一批真正尝试解决大数据问题的先行者。有别传统的运营方式让它们率先面对了大数据时代[著名的 3V 问题](https://blogs.gartner.com/doug-laney/files/2012/01/ad949-3D-Data-Management-Controlling-Data-Volume-Velocity-and-Variety.pdf)(By Gartner)。\n\n* 容量(Volumn):爆炸性的交易量带来爆炸性的数据容量。\n\n* 速度(Velocity):和在这个规模下仍提供高速的数据应用。\n\n* 多样性(Variety): 以及为了支持业务变更和复杂性所造成的数据多样性。\n\n与传统公司不同,互联网公司的数据单位价值偏低,但数据量极其庞大。而且它们并不一定是结构化的,并非完全能用 SQL 来处理。简而言之,它们已经超出了当时数据库的能力边界。而当时的互联网公司巨头们如 Google 和 Amazon,纷纷选择抛弃了传统手段,重起炉灶,由此拉开了「大数据」时代的大幕。\n\n有兴趣的童鞋,可以翻翻下面的论文:\n\n* [The Google File System](https://static.googleusercontent.com/media/research.google.com/en//archive/gfs-sosp2003.pdf) - 2003\n\n* [MapReduce: Simplified Data Processing on Large Clusters](https://static.googleusercontent.com/media/research.google.com/en//archive/mapreduce-osdi04.pdf) - 2004\n\n* [Bigtable: A Distributed Storage System for Structured Data](https://static.googleusercontent.com/media/research.google.com/en//archive/bigtable-osdi06.pdf) - 2006\n\n* [Dynamo: Amazon’s Highly Available Key-value Store](https://www.allthingsdistributed.com/files/amazon-dynamo-sosp2007.pdf) - 2007\n\n也许你并不了解 GFS,Google 内的 MapReduce 或者 BigTable 具体是什么样子的。不过相信既然你看到了这里,你一定听说过 Apache Hadoop 和 NoSQL。Hadoop 加上属于 NoSQL 的 HBase,就是以上面 Google 的几篇论文为基础开发而成的。这是一个真正现象级的开源通用大规模分布式数据存储和处理套件。它的影响力是巨大的,稍具规模的互联网公司就不得不用,稍有经验的从业者就可以领取不菲的薪水,人人都以能向其提交一个补丁为荣,更不用提一个实打实的 Committer,你都可以从他脑后看到光环。不管现在多少人宣称 Hadoop 已死,XXX 是真理,但是以 Hadoop + NoSQL 为基础,所谓大数据基础架构所带来的想法变迁,一直延续到了今天,且并没有太大变化:\n\n* 选用白菜价的硬件组成集群,突出 Scale Out 而非 Scale Up。\n\n* 极度简化和粗暴的计算模型。\n\n* 几乎不经整理的存储格式,在多种引擎之间共享,所谓数据湖。\n\n* 忽略 / 弱化一致性,抛弃关系模型,简化甚至无视事务,所谓 NoSQL。\n\n你可以说这是开源社区的威力,但追根究底还是 Google,Amazon 这些先行者卓有远见的工作为大家铺平了道路。不过,有些反直觉的是:这些引用数几千几万的论文其实并没有提出巧夺天工的设计;相反,它们本质上是告诉了业界,把数据库换成设计如此粗糙狂野的架构,仍然可以解决问题:就算你没钱买超高端的软硬件,只要你放宽心,告诉自己,无视一致性,忘掉精巧的优化执行器和存储结构,忽略半结构化带来的混乱,干掉 SQL 语言,多雇几个码农,你仍然活的下去,而且可以活的还不错。\n\n这些到底为我们带来了什么?且看曾经非常著名的 Sort Benchmark。\n\n* 2004 年,NEC Express 5800 / 1320 Xd 单机,价格可能介于 200-600 万 USD 之间,1 分钟排序 34G。\n\n* 2006 年,Fujitsu PrimeQuest 480 单机,2 年将结果推高 6G,1 分钟排序 40G 数据;机器价格不可考。\n\n* 2007 年,麻省理工林肯国防实验室,Bradley C. Kuszmaul 使用 TX-2500 磁盘集群(550 万 + USD),440 节点用 Infiband 串联,使用了自制系统(文件系统,通信模块),在经历了无数硬件软件故障之后,一分钟内排序了 214GB 数据;该试验相比之前的超豪华服务器,已经开始使用「便宜硬件」,但是使用自制软件系统。\n\n* 2009年,Yahoo! 使用 Hadoop 以近似的总价(500 万 USD,以单价反推)但近 1/3 的单价串联了 1400 个白菜价节点集群,得到了一倍多的速度,排序了 500G。而这里 1400 的节点数是为了凑整 500G / 1 分钟,而非只能这么多或者必须这么多。\n\n请允许我用一句诗来总结它的意义:「旧时王谢堂前燕,飞入寻常百姓家」。\n\n## 王之蔑视\n\n与业界的欢腾不同,当时数据库研究者圈子对此的反应已经不是嗤之以鼻,而是痛心疾首了。这有点像,老师傅练了一辈子武艺,你突然告诉他,打架只要抡大锤就行了。\n\n[MapReduce: A major step backwards](https://homes.cs.washington.edu/~billhowe/mapreduce_a_major_step_backwards.html) by David DeWitt & Michael Stonebraker\n\n上面这篇文章是 DeWitt 和 Stonebraker 大神合写的对 MapReduce 的批评。这两尊是真神,DeWitt 是美国工程院院士,微软 Jim Gray 实验室老大,而石破天,则是图灵奖获得者。在他们看来,这破玩意抛弃了数据库所有美好的特点,实现也丑陋,还接不上数据库工具,简直臭不可闻。文末,老人家们「酸酸」地说,我们很高兴看到社区对这些技术感兴趣,但是也别把我们几十年的研究成果当 X 啊。\n\n\n\n两位的评论,哪怕延伸到整个大数据生态,就算放到时隔多年的今天,也还是套的上去。但这套糙快猛的理念催生的技术栈,已经无需赘述获得了多大的成功。哪怕是数据库圈内的人,也时有抱怨:老一辈的人有时候不够 Open-Minded。所以,他们说错了么?\n\n也许他们对业界面临的困扰不够感同身受,也许他们不够有包容心。不过,他们对技术的判断着实是精准到位的。\n\n事实上,没过多久,人们在大数据体系中引入了 SQL、MPP 引擎、列存,加入了向量化、JIT,实现了 CBO。对于数据库圈外的童鞋们,有时你看社区兴高采烈地宣称,他们实现了多么神奇的技术,仿佛普罗米修斯从天上带来了火种,其实他们只是从十几甚至几十年前的故纸堆中汲取了养分。\n\n是大数据社区的人无知无能因此重新「发明」数据库界玩烂的技术么?不,只是因为业界等不了数据库圈子慢慢悠悠匠心打磨:没有合适的工具,他们每分每秒都在损失 $。且不说大规模分布式交易型数据库一直是老大难,就算脱开交易型场景不谈,分布式的分析型数据库早已有之,却也因为包袱沉重,还没来得及跟上时代的步伐,就被大数据的浪头打的狼狈不堪。Pivotal 先是由 Greenplum 折腾了对接 Hadoop 的 HAWQ ,继而被迫双双开源;就连 Teradata 这样的巨擘也不得不支持 Hadoop。\n\n只是,一旦社区步入小康,虽是野蛮生长的生态,也还是阻挡不了人们追求小资生活的决心:用户希望友好、快速、高效、稳定的数据存储和处理手段,这是亘古不变的需求。而这些,恰恰是数据库领域多年积累所在。\n\n\n\n摘自 pramodgampa.blogspot.com

\n\n现今的大数据生态,如同哥斯拉,强大而难以驯服。不管什么场景,似乎都经不起它尾巴一扫。但若说干净灵巧地解决问题,却是难如登天。毕竟狂野粗放基因的产物,不管如何演化,都很难优雅起来。对数据湖而言,开放形态加上公共存储格式,能轻易串联多种引擎,但也几乎抹杀了精细整理数据的可能;而混沌的存储体系和不受控的数据入口,也限制了整个体系可以伸展腾挪的空间。对 NoSQL 而言,孱弱或者干脆不存在的事务,所谓最终一致性,小儿科的 SQL 支持,也都成为人们诟病的理由。而整个圈子野蛮生长的开放体系,在得到巨大动能的同时,也使得用户体验几乎不可能良好。这些种种,使得大数据生态很大程度上都只服务于工程师,而你需要一大票专家才能真的驯服大数据平台。从这个角度看,MapR 变卖家当给 HP,Hortonworks 被收购,Cloudera 巨亏股价狂泻,都是必然的:大数据生态基本不可能做成类似 Oracle 这样的标准件生意。\n\n也许,更偏向于数据库形态的方案,才是更友善的方案;也许,随着技术的成熟,我们还有机会回到黄金时代。\n\n## 回归数据库\n\n随着时间的推进,Google 这样的巨人自己也忍受不了自己创造的怪物,又开始了新的探索:哪怕是 Google 这样聪明脑袋汇聚的地方,也不想总是需要自己花心思处理一致性,或者用繁琐的代码实现 SQL 逻辑。\n\n[Spanner: Google’s Globally-Distributed Database](https://static.googleusercontent.com/media/research.google.com/en//archive/spanner-osdi2012.pdf) - 2012\n\nSpanner 是一个能像 NoSQL 一样延展(甚至横跨多个大陆),但却支持传统数据库事务的分布式交易型数据库。它创造性地用原子钟解决了以往分布式事务一致性需要依赖中心节点,因而无法大规模扩展的问题。这算是拉开了所谓 NewSQL 的大幕。这启发了很多项目,比如小强,比如我们的 TiDB。她们拥有对业务透明的 Sharding 设计和分布式事务,良好的可扩容性,又兼顾了一致性,这让分布式体系很大程度上拥有单机数据库近似的用户体验。不过有意思的是,哪怕论文最创新的点是基于原子钟的分布式事务,但是对很多人来说,它更大的意义仍然是:证明给一个类似 NoSQL 架构加上传统数据库特性,用来做传统数据库业务,是可行的(当然共识算法 Paxos / Raft 的应用也很重要)。天知道这背后经历了多少试错,这就是先行者的伟大。\n\n至此,业界也许可以说解决了整个体系中最难啃的问题:分布式交易型数据库。而随着技术不断成熟,人们也逐渐开始接受这个新鲜事物:光就 TiDB 而言,从第一个用户拿来做并不那么 TP 的边缘业务,到现在登上银行核心系统。也许你在刷二维码付费的时候,背后支撑你这笔交易的数据库就是 TiDB。\n\n对我们来说,现有的 Multi-Raft 体系,提供了可自由伸缩,对用户透明的分片体系,以及可均衡的并行复制机制。以这些为基础,通过 Raft Learner 将数据从 TP 行存到 AP 列存进行异步异构复制但提供一致性读取,我们得以整合了 TP 和 ODS 层,而且互相之间不影响,这就是今年我们折腾的 TiFlash。希望明年能尝试进一步同样通过 Raft 协议将列存引擎延伸到传统的数仓业务,而统一更多场景。很多人不相信最终数据库能做到一站式服务(Silver Bullet),能简化到一个产品,去除平台间数据的迁移。毕竟,有些设计的取舍很难兼顾。我个人的看法是,也许,但通过小心的设计,我们现在已经可以做到将不同的引擎无缝地整合到一个产品中。毕竟,经过这十多年的大数据浪潮,哪怕浪不再那么高,社区终究沉淀下了宝贵的财富,前人设计的得失也好,强大的开源引擎如 Spark 也好(Spark 已经慢慢脱离野蛮生态直通云霄了),甚至更多有经验的小伙伴也好,这都成为我们能借力的抓手,让我们能有勇气挑战似乎不切实际的目标:让用户从大数据生态复杂的技术栈解放出来,让数据平台收敛到单一一个产品,因为这才是数据处理应有的模样,哪怕这是一条很长很长的路。","date":"2019-12-18","author":"马晓宇","fillInMethod":"writeDirectly","customUrl":"from-big-data-to-databases","file":null,"relatedBlogs":[]},{"id":"Blogs_115","title":"高效编排有状态应用——TiDB 的云原生实践与思考","tags":["TiDB Operator","云原生"],"category":{"name":"观点洞察"},"summary":"本文将以 TiDB 与 Kubernetes 的“爱恨情仇”为例,总结有状态应用走向云原生的工程最佳实践。","body":"## 导语\n\n云原生时代以降,无状态应用以其天生的可替换性率先成为各类编排系统的宠儿。以 Kubernetes 为代表的编排系统能够充分利用云上的可编程基础设施,实现无状态应用的弹性伸缩与自动故障转移。这种基础能力的下沉无疑是对应用开发者生产力的又一次解放。 然而,在轻松地交付无状态应用时,我们应当注意到,状态本身并没有消失,而是按照各类最佳实践下推到了底层的数据库、对象存储等有状态应用上。那么,“负重前行”的有状态应用是否能充分利云与 Kubernetes 的潜力,复制无状态应用的成功呢?\n\n或许你已经知道,Operator 模式已经成为社区在 Kubernetes 上编排有状态应用的最佳实践,脚手架项目 KubeBuilder 和 operator-sdk 也已经愈发成熟,而对磁盘 IO 有严苛要求的数据库等应用所必须的 Local PV(本地持久卷)也已经在 1.14 中 GA。这些积木似乎已经足够搭建出有状态应用在平稳运行在 Kubernetes 之上这一和谐景象。然而,书面上的最佳实践与生产环境之间还有无数工程细节造就的鸿沟,要在 Kubernetes 上可靠地运行有状态应用仍需要相当多的努力。下面我将以 TiDB 与 Kubernetes 的“爱恨情仇”为例,总结有状态应用走向云原生的工程最佳实践。\n\n## TiDB 简介\n\n首先让我们先熟悉熟悉研究对象。TiDB 是一个分布式的关系型数据库,它采用了存储和计算分离的架构,并且分层十分清晰:\n\n\n\n图 1 TiDB 架构

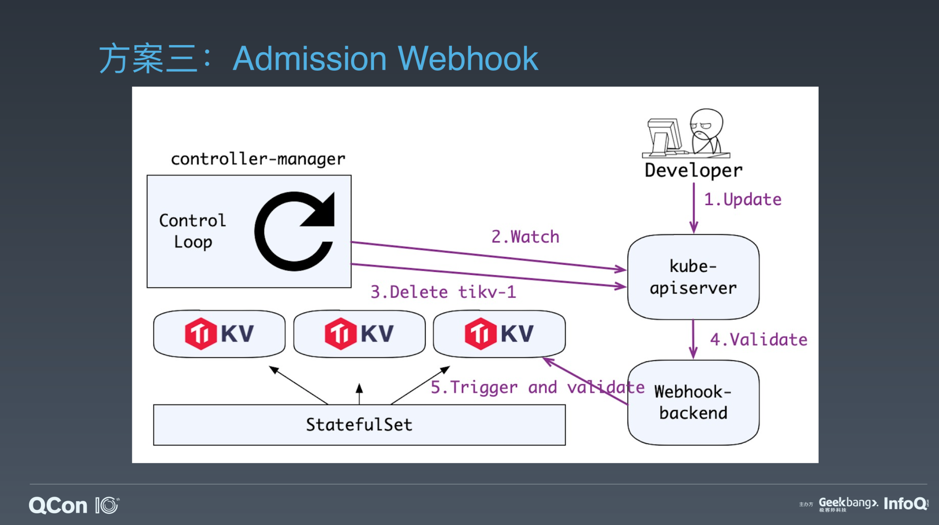

\n\n其中 TiDB 是 SQL 计算层,TiDB 进程接收 SQL 请求,计算查询计划,再根据查询计划去查询存储层完成查询。\n\n存储层就是图中的 TiKV,TiKV 会将数据拆分为一个个小的数据块,比如一张 1000000 行的表,在 TiKV 中就有可能被拆分为 200 个 5000 行的数据块。这些数据块在 TiKV 中叫做 Region,而为了确保可用性, 每个 Region 都对应一个 Raft Group,通过 Raft Log 复制实现每个 Region 至少有三副本。\n\n\n\n图 2 TiKV Region 分布

\n\n而 PD 则是集群的大脑,它接收 TiKV 进程上报的存储信息,并计算出整个集群中的 Region 分布。借由此,TiDB 便能通过 PD 获知该如何访问某块数据。更重要的是,PD 还会基于集群 Region 分布与负载情况进行数据调度。比如,将过大的 Region 拆分为两个小 Region,避免 Region 大小由于写入而无限扩张;将部分 Leader 或数据副本从负载较高的 TiKV 实例迁移到负载较低的 TiKV 实例上,以最大化集群性能。这引出了一个很有趣的事实,也就是 TiKV 虽然是存储层,但它可以非常简单地进行水平伸缩。这有点意思对吧?在传统的存储中,假如我们通过分片打散数据,那么加减节点数往往需要重新分片或手工迁移大量的数据。而在 TiKV 中,以 Region 为抽象的数据块迁移能够在 PD 的调度下完全自动化地进行,而对于运维而言,只管加机器就行了。\n\n**了解有状态应用本身的架构与特性是进行编排的前提,比如通过前面的介绍我们就可以归纳出,TiDB 是无状态的,PD 和 TiKV 是有状态的,它们三者均能独立进行水平伸缩。我们也能看到,TiDB 本身的设计就是云原生的——它的容错能力和水平伸缩能力能够充分发挥云基础设施提供的弹性,既然如此,云原生“操作系统” Kubernetes 不正是云原生数据库 TiDB 的最佳载体吗?TiDB Operator 应运而生。**\n\n## TiDB Operator 简介\n\nOperator 大家都很熟悉了,目前几乎每个开源的存储项目都有自己的 Operator,比如鼻祖 etcd-operator 以及后来的 prometheus-operator、postgres-operator。Operator 的灵感很简单,Kubernetes 自身就用 Deployment、DaemonSet 等 API 对象来记录用户的意图,并通过 control loop 控制集群状态向目标状态收敛,那么我们当然也可以定义自己的 API 对象,记录自身领域中的特定意图,并通过自定义的 control loop 完成状态收敛。\n\n在 Kubernetes 中,添加自定义 API 对象的最简单方式就是 CustomResourceDefinition(CRD),而添加自定义 control loop 的最简单方式则是部署一个自定义控制器。自定义控制器 + CRD 就是 Operator。具体到 TiDB 上,用户可以向 Kubernetes 提交一个 TidbCluster 对象来描述 TiDB 集群定义,假设我们这里描述说“集群有 3 个 PD 节点、3 个 TiDB 节点和 3 个 TiKV 节点”,这是我们的意图。 而 TiDB Operator 中的自定义控制器则会进行一系列的 Kubernetes 集群操作,比如分别创建 3 个 TiKV、TiDB、PD Pod,来让真实的集群符合我们的意图。\n\n\n\n图 3 TiDB Operator

\n\nTiDB Operator 的意义在于让 TiDB 能够无缝运行在 Kubernetes 上,而 Kubernetes 又为我们抽象了基础设施。因此,TiDB Operator 也是 TiDB 多种产品形态的内核。对于希望直接使用 TiDB Operator 的用户, TiDB Operator 能做到在既有 Kubernetes 集群或公有云上开箱即用;而对于不希望有太大运维负载,又需求一套完整的分布式数据库解决方案的用户,我们则提供了打包 Kubernetes 的 on-premise 部署解决方案,用户可以直接通过方案中打包的 GUI 操作 TiDB 集群,也能通过 OpenAPI 将集群管理能力接入到自己现有的 PaaS 平台中;另外,对于完全不想运维数据库,只希望购买 SQL 计算与存储能力的用户,我们则基于 TiDB Operator 提供托管的 TiDB 服务,也即 DBaaS(Database as a Service)。\n\n\n\n图 4 TiDB Operator 的多种上层产品形态

\n\n多样的产品形态对作为内核的 TiDB Operator 提出了更高的要求与挑战——事实上,由于数据资产的宝贵性和引入状态后带来的复杂性,有状态应用的可靠性要求与运维复杂度往往远高于无状态应用,这从 TiDB Operator 所面临的挑战中就可见一斑。\n\n## 挑战\n\n描绘架构总是让人觉得美好,而生产中的实际挑战则将我们拖回现实。\n\n**TiDB Operator 的最大挑战就是数据库的场景极其严苛,大量用户的期盼都是我的数据库能够“永不停机”,对于数据不一致或丢失更是零容忍**。很多时候大家对于数据库等有状态应用的可用性要求甚至是高于承载线上服务的 Kubernetes 集群的,至少线上集群宕机还能补救,而数据一旦出问题,往往意味着巨大的损失和补救成本,甚至有可能“回天乏术”。这本身也会在很大程度上影响大家把有状态应用推上 Kubernetes 的信心。\n\n**第二个挑战是编排分布式系统这件事情本身的复杂性**。Kubernetes 主导的 level driven 状态收敛模式虽然很好地解决了命令式编排在一致性、事务性上的种种问题,但它本身的心智模型是更为抽象的,我们需要考虑每一种可能的状态并针对性地设计收敛策略,而最后的实际状态收敛路径是随着环境而变化的,我们很难对整个过程进行准确的预测和验证。假如我们不能有效地控制编排层面的复杂度,最后的结果就是没有人能拍胸脯保证 TiDB Operator 能够满足上面提到的严苛挑战,那么走向生产也就无从谈起了。\n\n**第三个挑战是存储**。数据库对于磁盘和网络的 IO 性能相当敏感,而在 Kubernetes 上,最主流的各类网络存储很难满足 TiDB 对磁盘 IO 性能的要求。假如我们使用本地存储,则不得不面对本地存储的易失性问题——磁盘故障或节点故障都会导致某块存储不可用,而这两种故障在分布式系统中是家常便饭。\n\n**最后的问题是,尽管 Kubernetes 成功抽象了基础设施的计算能力与存储能力,但在实际场景的成本优化上考虑得很少**。对于公有云、私有云、裸金属等不同的基础设施环境,TiDB Operator 需要更高级、特化的调度策略来做成本优化。大家也知道,成本优化是没有尽头的,并且往往伴随着一些牺牲,怎么找到优化过程中边际收益最大化的点,同样也是非常有意思的问题之一。\n\n其中,场景严苛可以作为一个前提条件,而针对性的成本优化则不够有普适性。我们接下来就从编排和存储两块入手,从实际例子来看 TiDB 与 TiDB Operator 如何解决这些问题,并推广到一般的有状态应用上。\n\n## 控制器——剪不断,理还乱\n\nTiDB Operator 需要驱动集群向期望状态收敛,而最简单的驱动方式就是创建一组 Pod 来组成 TiDB 集群。通过直接操作 Pod,我们可以自由地控制所有编排细节。举例来说,我们可以:\n\n* 通过替换 Pod 中容器的 image 字段完成原地升级。\n\n* 自由决定一组 Pod 的升级顺序。\n\n* 自由下线任意 Pod。\n\n事实上我们也确实采用过完全操作 Pod 的方案,但是当真正推进该方案时我们才发现,这种完全“自己造轮子”的方案不仅开发复杂,而且验证成本非常高。试想,为什么大家对 Kubernetes 的接受度越来越高, 即使是传统上较为保守的公司现在也敢于拥抱 Kuberentes?除了 Kubernetes 本身项目素质过硬之外,更重要的是有整个社区为它背书。我们知道 Kubernetes 已经在各种场景下经受过大量的生产环境考验,这种信心是各类测试手段都没法给到我们的。回到 TiDB Operator 上,选择直接操作 Pod 就意味着我们抛弃了社区在 StatefulSet、Deployment 等对象中沉淀的编排经验,随之带来的巨大验证成本大大影响了整个项目的开发效率。\n\n因此,在目前的 TiDB Operator 项目中,大家可以看到控制器的主要操作对象是 StatefulSet。StatefulSet 能够满足有状态应用的大部分通用编排需求。当然,StatefulSet 为了做到通用化,做了很多不必要的假设,比如高序号的 Pod 是隐式依赖低序号 Pod 的,这会给我们带来一些额外的限制,比如:\n\n+ 无法指定 Pod 进行下线缩容。\n+ 滚动更新顺序固定。\n+ 滚动更新需要后驱 Pod 全部 Ready。\n\nStatefulSet 和 Pod 的抉择,最终是灵活性和可靠性的权衡,而在 TiDB 面临的严苛场景下,我们只有先做到可靠,才能做开发、敢做开发。最后的选择自然就呼之欲出——StatefulSet。当然,这里并不是说,使用基于高级对象进行编排的方案要比基于 Pod 进行编排的方案更好,只是说我们在当时认为选择 StatefulSet 是一个更好的权衡。当然这个故事还没有结束,当我们基于 StatefulSet 把第一版 TiDB Operator 做稳定后,我们正在接下来的版本中开发一个新的对象来水平替换 StatefulSet,这个对象可以使用社区积累的 StatefulSet 测试用例进行验证,同时又可以解除上面提到的额外限制,给我们提供更好的灵活性。 假如你也在考虑从零开始搭建一个 Operator,或许也可以参考“先基于成熟的原生对象快速迭代,在验证了价值后再增强或替换原生对象来解决高级需求”这条落地路径。\n\n接下来的问题是控制器如何协调基础设施层的状态与应用层的状态。举个例子,在滚动升级 TiKV 时,每次重启 TiKV 实例前,都要先驱逐该实例上的所有 Region Leader;而在缩容 TiKV 时,则要先在 PD 中将待缩容的 TiKV 下线,等待待缩容的 TiKV 实例上的 Region 全部迁移走,PD 认为 TiKV 下线完成时,再真正执行缩容操作调整 Pod 个数。这些都是在编排中协调应用层状态的例子,我们可以怎么做自动化呢?\n\n大家也注意到了,上面的例子都和 Pod 下线挂钩,因此一个简单的方案就通过 container lifecycle hook,在 preStop 时执行一个脚本进行协调。这个方案碰到的第一个问题是缺乏全局信息,脚本中无法区分当前是在滚动升级还是缩容。当然,这可以通过在脚本中查询 apiserver 来绕过。更大的问题是 preStop hook 存在 grace period,kubelet 最多等待 .spec.terminationGracePeriodSeconds 这么长的时间,就会强制删除 Pod。对于 TiDB 的场景而言,我们更希望在自动的下线逻辑失败时进行等待并报警,通知运维人员介入,以便于最小化影响,因此基于 container hook 来做是不可接受的。\n\n第二种方案是在控制循环中来协调应用层的状态。比如,我们可以通过 partition 字段来控制 StatefulSet 升级进度,并在升级前确保 leader 迁移完毕,如下图所示:\n\n\n\n图 5 在控制循环中协调状态

\n\n在伪代码中,每次我们因为要将所有 Pod 收敛到新版本而进入这段控制逻辑时,都会先检查下一个要待升级的 TiKV 实例上 leader 是否迁移完毕,直到迁移完毕才会继续往下走,调整 partition 参数,开始升级对应的 TiKV 实例。缩容也是类似的逻辑。但你可能已经意识到,缩容和滚动更新两个操作是有可能同时出现在状态收敛的过程中的,也就是同时修改 replicas 和 image 字段。这时候由于控制器需要区分缩容与滚动更新,诸如此类的边界条件会让控制器越来越复杂。\n\n第三种方案是使用 Kubernetes 的 Admission Webhook 将一部分协调逻辑从控制器中拆出来,放到更纯粹的切面当中。针对这个例子,我们可以拦截 Pod 的 Delete 请求和针对上层对象的 Update 请求,检查缩容或滚动升级的前置条件,假如不满足,则拒绝请求并触发指令进行协调,比如驱逐 leader,假如满足,那么就放行请求。控制循环会不断下发指令直到状态收敛,因此 webhook 就相应地会不断进行检查直到条件满足,如下图所示:\n\n\n\n\n图 6 在 Webhook 中协调状态

\n\n这种方案的好处是我们把逻辑拆分到了一个与控制器垂直的单元中,从而可以更容易地编写业务代码和单元测试。当然,这个方案也有缺点,一是引入了新的错误模式,处理 webhook 的 server 假如宕机,会造成集群功能降级;二是该方案适用面并不广,只能用于状态协调与特定的 Kubernetes API 操作强相关的场景。在实际的代码实践中,我们会按照具体场景选择方案二或方案三,大家也可以到项目中一探究竟。\n\n**上面的两个例子都是关于如何控制编排逻辑复杂度的,关于 Operator 的各类科普文中都会用一句“在自定义控制器中编写领域特定的运维知识”将这一部分轻描淡写地一笔带过,而我们的实践告诉我们,真正编写生产级 的自定义控制器充满挑战与抉择。**\n\n## Local PV —— 想说爱你不容易\n\n接下来是存储的问题。我们不妨看看 Kubernetes 为我们提供了哪些存储方案:\n\n\n\n图 7 存储方案

\n\n其中,本地临时存储中的数据会随着 Pod 被删除而清空,因此不适用于持久存储。\n\n远程存储则面临两个问题:\n\n+ 通常来说,远程存储的性能较差,这尤其体现在 IOPS 不够稳定上,因此对于磁盘性能有严格要求的有状态应用,大多数远程存储是不适用的。\n\n+ 通常来说,远程存储本身会做三副本,因此单位成本较高,这对于在存储层已经实现三副本的 TiDB 来说是不必要的成本开销。\n\n因此,最适用于 TiDB 的是本地持久存储。这其中,hostPath 的生命周期又不被 Kubernetes 管理,需要付出额外的维护成本,最终的选项就只剩下了 Local PV。\n\nLocal PV 并非免费的午餐,所有的文档都会告诉我们 Local PV 有以下限制:\n\n+ 数据易失(相比于远程存储的三副本)。\n\n+ 节点故障会影响数据访问。\n\n+ 难以垂直扩展容量(相当一部分远程存储可以直接调整 volume 大小)。\n\n这些问题同样也是在传统的虚拟机运维场景下的痛点,因此 TiDB 本身设计就充分考虑了这些问题:\n\n+ 本地存储的易失性要求应用自身实现数据冗余。\n - TiDB 的存储层 TiKV 默认就为每个 Region 维护至少三副本。\n - 当副本缺失时,TiKV 能自动补齐副本数。\n+ 节点故障会影响本地存储的数据访问。\n - 节点故障后,相关 Region 会重新进行 leader 选举,将读写自动迁移到健康节点上。\n+ 本地存储的容量难以垂直扩展。\n - TiKV 的自动数据切分与调度能够实现水平伸缩。\n\n存储层的这些关键特性是 TiDB 高效使用 Local PV 的前提条件,也是 TiDB 水平伸缩的关键所在。当然,在发生节点故障或磁盘故障时,由于旧 Pod 无法正常运行,我们需要自定义控制器帮助我们进行恢复,及时补齐实例数,确保有足够的健康实例来提供整个集群所需的存储空间、计算能力与 IO 能力。这也就是自动故障转移。\n\n我们先看一看为什么 TiDB 的存储层不能像无状态应用或者使用远程存储的 Pod 那样自动进行故障转移。假设下图中的节点发生了故障,由于 TiKV-1 绑定了节点上的 PV,只能运行在该节点上,因此 在节点恢复前,TiKV-1 将一直处于 Pending 状态:\n\n\n\n\n图 8 节点故障

\n\n此时,假如我们能够确认 Node 已经宕机并且短期无法恢复,那么就可以删除 Node 对象(比如 NodeController 在公有上会查询公有云的 API 来删除已经释放的 Node)。此时,控制器通过 Node 对象不存在这一事实理解了 Node 已经无法恢复,就可以直接删除 pvc-1 来解绑 PV,并强制删除 TiKV-1,最终让 TiKV-1 调度到其它节点上。当然,我们同时也要做应用层状态的协调,也就是先在 PD 中下线 TiKV-1,再将新的 TiKV-1 作为一个新成员加入集群,此时,PD 就会通知 TiKV-1 创建 Region 副本来补齐集群中的 Region 副本数。\n\n\n\n图 9 能够确定节点状态时的故障转移

\n\n当然,更多的情况下,我们是无法在自定义控制器中确定节点状态的,此时就很难针对性地进行原地恢复,因此我们通过向集群中添加新 Pod 来进行故障转移:\n\n\n\n图 10 无法确定节点状态时的故障转移

\n\n上面讲的是 TiDB 特有的故障转移策略,但其实可以类推到大部分的有状态应用上。比如对于 MySQL 的 slave,我们同样可以通过新增 slave 来做 failover,而在 failover 时,我们同样也要做应用层的一些事情, 比如说去 S3 上拉一个全量备份,再通过 binlog 把增量数据补上,当 lag 达到可接受的程度之后开始对外提供读服务。因此大家就可以发现,对于有状态应用的 failover 策略是共通的,也都需要应用本身支持某种 failover 形式。比如对于 MySQL 的 master,我们只能通过 M-M 模式做一定程度上的 failover,而且还会损失数据一致性。这当然不是 Kubernetes 或云原生本身有什么问题,而是说 Kubernetes 只是改变了应用的运维模式,但并不能影响应用本身的架构特性。假如应用本身的设计就不是云原生的,那只能从应用本身去解决。\n\n## 总结\n\n通过 TiDB Operator 的实践,我们有以下几条总结:\n\n* Operator 本身的复杂度不可忽视。\n\n* Local PV 能满足高 IO 性能需求,代价则是编排上额外的复杂度。\n\n* 应用本身必须迈向云原生(meets kubernetes part way)。\n\n最后,言语的描述总是不如代码本身来得简洁有力,TiDB Operator 是一个完全开源的项目,眼见为实,大家可以尽情到 [项目仓库](https://github.com/pingcap/tidb-operator) 中拍砖,也欢迎大家加入社区一起玩起来,期待你的 issue 和 PR!\n\n假如你对于文章有任何问题或建议,或是想直接加入 PingCAP 鼓捣相关项目,欢迎通过我的邮箱 wuyelei@pingcap.com 联系我。\n\n\n>本文为吴叶磊在 2019 QCon 全球软件开发大会(上海)上的专题演讲实录,Slides [下载地址](https://github.com/pingcap/presentations/blob/master/conference/%E5%90%B4%E5%8F%B6%E7%A3%8A-QCon-2019-%E9%AB%98%E6%95%88%E7%BC%96%E6%8E%92%E6%9C%89%E7%8A%B6%E6%80%81%E5%BA%94%E7%94%A8-TiDB%E7%9A%84%E4%BA%91%E5%8E%9F%E7%94%9F%E5%AE%9E%E8%B7%B5%E4%B8%8E%E6%80%9D%E8%80%83.pdf)。","date":"2019-10-29","author":"吴叶磊","fillInMethod":"writeDirectly","customUrl":"efficiently-orchestrating-stateful-application","file":null,"relatedBlogs":[]},{"id":"Blogs_279","title":"势高,则围广:TiDB 的架构演进哲学","tags":["TiDB","架构"],"category":{"name":"观点洞察"},"summary":"我们更多时候是站在哲学层面思考整个公司的运转和 TiDB 这个产品的演进的思路。这些思路很多时候是大家看不见的,因为不是一个纯粹的技术层面或者算法层面的事情。","body":"大家可能知道我是 PingCAP CEO,但是不知道的是,我也是 PingCAP 的产品经理,应该也是最大的产品经理,是对于产品重大特性具有一票否决权的人。中国有一类产品经理是这样的,别人有的功能我们统统都要有,别人没有的功能,我们也统统都要有,所以大家看到传统的国内好多产品就是一个超级巨无霸,功能巨多、巨难用。所以我在 PingCAP 的一个重要职责是排除掉“看起来应该需要但实际上不需要”的那些功能,保证我们的产品足够的专注、足够聚焦,同时又具有足够的弹性。\n\n## 一、最初的三个基本信念\n\n本次分享题目是《TiDB 的架构演进哲学》,既然讲哲学那肯定有故事和教训,否则哲学从哪儿来呢?但从另外的角度来说,一般大家来讲哲学就先得有信念。有一个内容特别扯的美剧叫做《美国众神》,里面核心的一条思路是“你相信什么你就是什么”。其实人类这么多年来,基本上也是朝这条线路在走的,人类对于未知的东西很难做一个很精确的推导,这时信念就变得非常重要了。\n\n\n\n图 1 最初的基本信念

\n\n实际上,我们开始做 TiDB 这个产品的时候,第一个信念就是相信云是未来。当年 K8s 还没火,我们就坚定的拥抱了 K8s。第二是不依赖特定硬件、特定的云厂商,也就是说 TiDB 的设计方向是希望可以 Run 在所有环境上面,包括公有云私有云等等。第三是能支持多种硬件,大家都知道我们支持 X86、AMD64、ARM 等等,可能大家不清楚的是 MIPS,MIPS 典型代表是龙芯,除此之外,TiDB 未来还可以在 GPU 上跑(TiFlash 的后续工作会支持 GPU)。\n\n## 二、早期用户故事\n\n### 2.1 Make it work\n\n有一句话大概是“眼睛里面写满了故事,脸上没有一点沧桑”,其实现实是残酷的,岁月一定会给你沧桑的。我们早期的时候,也有相对比较难的时候,这时候就有一些故事关于我们怎么去经历、怎么渡过的。 \n\n首先大家做产品之前肯定先做用户调研,这是通用的流程,我们当初也做过这个事,跟用户聊。我们通常会说:“我们要做一个分布式数据库,自动弹性伸缩,能解决分库分表的问题,你会用吗?”用户说“那肯定啊,现在的分库分表太痛苦了。”这是最初我们获取需求最普通的方式,也是我们最容易掉入陷阱的方式,就好像“我有一百万,你要不要?肯定要。”“我有一瓶水,喝了之后就健康无比,延年益寿你要不要?肯定要。”很容易就得到类似的结论。\n\n所以这个一句话结论的代价是我们进行了长达两年的开发。在这两年的时间里,我们确定了很多的技术方向,比如最初 TiDB 就决定是分层的。很显然一个复杂的系统如果没有分层,基本上没有办法很好的控制规模和复杂度。TiDB 分两层,一层是 SQL 层,一层是 key-value 层,那么到底先从哪一个层开始写呢?其实从哪层开始都可以,但是总要有一个先后,如何选择?\n\n这里就涉及到 TiDB 的第一条哲学。我们做一个产品的时候会不断面临选择,那每次选择的时候核心指导思想是什么?核心思想是能一直指导我们持续往前去迭代,所以我们第一条哲学就是:**永远站在离用户更近的地方去考虑问题。**\n\n为什么我们会定义这样一条哲学?因为离用户越近越能更快的得到用户的反馈,更快的验证你的想法是不是可行的。显然 SQL 层离用户更近,所以我们选择从 SQL 层写起。其实一直到现在,绝大多数用户用 TiDB 的时候根本感受不到 KV 层的存在,用户写的都是 SQL,至于底层存储引擎换成了别的,或者底层的 RocksDB 做了很多优化和改进,这些变化对于用户关注的接口来说是不可见的。\n\n选择从 SQL 层开始写之后,接下来面临的问题就是怎么做测试,怎么去更好的做验证,怎么让整个架构,先能够完整跑起来。\n\n在软件开发领域有一条非常经典的哲学:**「Make it work, make it right, make it fast」**。我想大家每一个学软件开发的人,或者每一个学计算机的人可能都听过这样一句话。所以当时我们就做另外一个决定,先在已有的 KV 上面构建出一个原形,用最短的时间让整个系统能够先能 work。\n\n我们在 2015 年的 9 月份开源了第一个版本,当时是没有存储层的,需要接在 HBase 上。当这个系统能跑起来之后,我们的第一想法是赶紧找到当初调研时说要用的那些用户,看看他们是什么想法,尽快的去验证我们的想法是不是可行的。因为很多人做产品思维属于自嗨型,“我做的东西最厉害,只要一推出去肯定一群人蜂拥而至。”抱有这种想法的人太多了,实际上,只有尽快去验证才是唯一的解决之道,避免产品走入误区。\n\n\n\n图 2 与调研用户第二次对话

\n\n然而当我跟用户讲,你需要先装一个 Hadoop,可能还要装一组 Zookeeper,**但用户说:“我只想要一个更强大的 MySQL,但是让我装这一堆东西,你是解决问题还是引入问题?”**\n\n这个问题有什么解决办法呢?一个办法是你去解决用户,可以通过销售或者通过某些关系跟用户聊,显然这是一个不靠谱的思路。作为一个产品型的公司,我们很快就否了这个想法。用户的本质要求是:你不要给我装一堆的东西,要真正解决我的问题。所以我们马上开始启动分布式 KV 的开发工作,彻底解决掉这个问题,满足用户的要求。\n\n\n\n图 3 开发 TiKV 前的技术考量

\n\n开始开发 KV 层时候又会面临很多技术选择,我们有很多考量(如图 3)。\n\n**第一点,我们认为作为数据库最重要的是正确性。** 假设这个数据库要用在金融行业,用在银行、保险、证券,和其他一些非常关键的场合的时候,正确性就是无比重要的东西。没有人会用一个不正确的数据库。\n\n**第二点是实现简洁、易用。** 用户对于一个不简洁、不易用的东西是无法接受的,所以我们当时的一个想法是一定要做得比 HBase 更加易用,代码量也要比 HBase 小,所以时至今天 TiDB 代码量仍然是比 HBase 小得多,大约还不到 HBase 的十分之一。\n\n**第三点考虑是扩展性。** TiDB 不仅在整体上是分层的,在存储层 TiKV 内部也是分层的,所以有非常好的扩展性,也支持 Raw KV API、Transaction API,这个设计后来也收获了很多用户的支持,比如一点资讯的同学就是用的 Raw KV API。\n\n**第四点就是要求高性能低延迟。** 大家对于数据库的性能和延迟的追求是没有止境的,但是我们当时并没有把太多精力花在高性能低延迟上。刚才说到我们有一条哲学是「Make it work, make it right, make it fast」,大家可以看到这句话里面 「Fast」是放最后的,这一点也是 TiDB 和其他产品有非常大的差异的地方。作为一个技术人员,通常大家看一个产品好不好,就会想:“来,不服跑个分,产品架构、易用性、技术文档、Community 这些指标都不看,先跑个分让大家看看行不行”。这个思路真正往市场上去推时是不对的。很多事情的选择是一个综合的过程。你可以让你的汽车跑的巨快无比,上面东西全拆了就留一个发动机和四个轮子,那肯定也是跑得巨快,重量轻,而且还是敞篷车,但没有一个人会在路上用的。同样的,选择 Rust 也是综合考量的结果。我们看中了 Rust 这个非常具有潜力的语言。当时 Rust 没有发布 1.0,还不是一个 stable 版本,但我们相信它会有 1.0。大概过了几个月,Rust 就发布了 1.0 版本,证明我们的选择还是非常正确的。\n\n**最后一点就是稳定性。** 作为一个分布式数据库,每一层的稳定性都非常重要。最底下的一个存储引擎,我们选择了非常稳定的 RocksDB。不过后来我们也查到几个 RocksDB 掉数据的 Bug。这也是做数据库或者说做基础产品的残酷性,我们在做产品的过程中找到了 Rust 编译器的 Bug,XFS 掉数据的 Bug,RocksDB 掉数据的 Bug,好像几大基础组件的 Bug 都聚在这里开会。\n\n接着我们辛辛苦苦干了三个月,然后就开源了 TiKV,所以这时候看起来没有那么多的组件了。我们也不忘初心,又去找了我们当初那个用户,说我们做了一些改进,你要不要试一试。\n\n\n\n图 4 与调研用户第三次对话

\n\n但是用户这时候给了一个让我们非常伤心非常难受的回答:没有,我们不敢上线,虽然你们的产品听起来挺好的,但是数据库后面有很大的责任,心理上的担心确实是过不去。于是我们回去开始加班加点写 TiDB Binlog,让用户可以把 binlog 同步给 MySQL。**毕竟用户需要一个 Backup:万一 TiDB 挂了怎么办,我需要切回 MySQL,这样才放心,因为数据是核心资产。**\n\n\n\n图 5 第一个上线用户的架构图

\n\n所以最终我们第一个用户上线的时候,整个 TiDB 的架构是这样的(如图 5)。用户通过 Client 连上 TiDB,然后 TiDB 后面就通过 Binlog 同步到 MySQL。后来过了一段时间,用户就把后面的 MySQL 撤了。我们当时挺好奇为什么撤了,用户说,第一个原因是后面 MySQL 撑不起一个集群给它回吐 Binlog,第二就是用了一段时间觉得 TiDB 挺稳定的,然后就不需要 Binlog 备份了。\n\n其实第一个用户上线的时候,数据量并不算大,大概 800G 的数据,使用场景是 OLTP 为主,有少量的复杂分析和运算,但这少量的复杂分析运算是当时他们选择 TiDB 最重要的原因。因为当时他们需要每隔几分钟算一个图出来,如果是在 MySQL 上面跑,大约需要十几分钟,但他们需要每隔几分钟打一个点,后来突然发现第二天才能把前一天的点都打出来,这对于一个实时的系统来说就很不现实了。虽然这个应用实践只有少部分运算,但也是偏 OLAP,我记得 TiDB 也不算特别快,大概是十几秒钟,因为支持了一个并行的 Hash Join。\n\n**不管怎样,这个时候终于有第一个用户能证明我们做到了「Make it work」。**\n\n### 2.2 Make it right\n\n接下来就是「Make it right」。大家可能想象不到做一个保证正确性的数据库这件事情有多么难,这是一个巨大的挑战,也有巨大的工作量,是从理论到实践的距离。\n\n\n\n图 6 理论到实践的距离

\n\n#### 2.2.1 TLA+ 证明\n\n大家可能会想写程序跟理论有什么关系?其实在分布式数据库领域是有一套方法论的。这个方法论要求先实现正确性,而实现正确的前提是有一个形式化的证明。为了保证整个系统的理论正确,我们把所有的核心算法都用 TLA+ 写了一遍证明,并且把这个证明 [开源](https://github.com/pingcap/tla-plus) 出去了,如果大家感兴趣可以翻看一下。以前写程序的时候,大家很少想到先证明一下算法是对的,然后再把算法变成一个程序,其实今天还有很多数据库厂商没有做这件事。\n\n#### 2.2.2 千万级别测试用例\n\n在理论上保证正确性之后,下一步是在现实中测试验证。这时只有一个办法就是用非常庞大的测试用例做测试。大家通常自己做测试的时候,测试用例应该很少能达到十万级的规模,而我们现在测试用例的规模是以千万为单位的。当然如果以千万为单位的测试用例靠纯手写不太现实,好在我们兼容了 MySQL 协议,可以直接从 MySQL 的测试用例里收集一些。这样就能很快验证整个系统是否具备正确性。\n\n这些测试用例包括应用、框架、管理工具等等。比如有很多应用程序是依赖 MySQL,那直接拿这个应用程序在 TiDB 上跑一下,就知道 TiDB 跟 MySQL 的兼容没问题,如 Wordpress、无数的 ORM 等等。还有一些 MySQL 的管理工具可以拿来测试,比如 Navicat、PHP admin 等。另外我们把公司内部在用的 Confluence、Jira 后面接的 MySQL 都换成了 TiDB,虽然说规模不大,但是我们是希望在应用这块有足够的测试,同时自己「Eat dog food」。\n\n#### 2.2.3 7*24 的错误注入测试用例\n\n这些工作看起来已经挺多的了,但实际上还有一块工作比较消耗精力,叫 7*24 的错误注入测试。最早我们也不知道这个测试这么花钱,我们现在测试的集群已经是几百台服务器了。如果创业的时候就知道需要这么多服务器测试,我们可能就不创业了,好像天使轮的融资都不够买服务器的。不过好在这个事是一步一步买起来,刚开始我们也没有买这么多测试服务器,后来随着规模的扩大,不断的在增加这块的投入。\n\n大家可能到这儿的时候还是没有一个直观的感受,说这么多测试用例,到底是一个什么样的感受。我们可以对比看一下行业巨头 Oracle 是怎么干的。\n\n\n\n图 7 前 Oracle 员工的描述

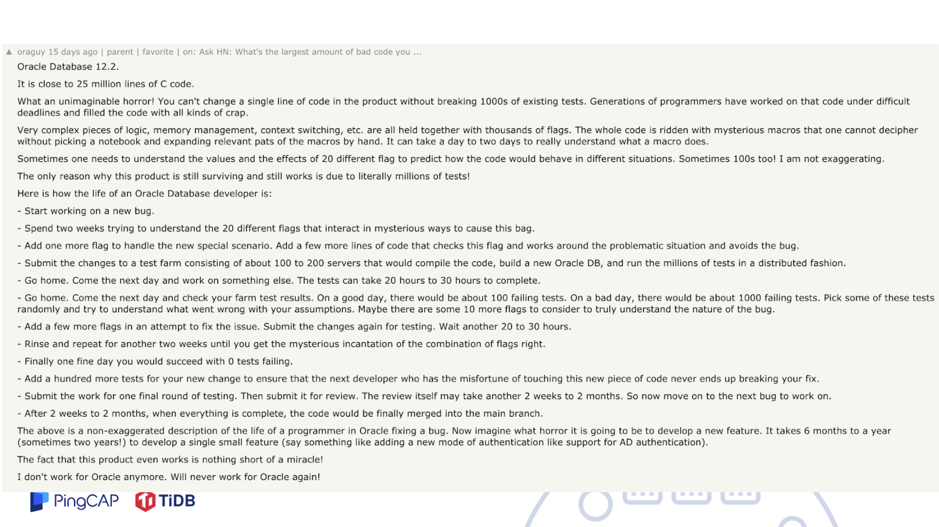

\n\n这是一篇 [在 HackNews上面的讨论](https://news.ycombinator.com/item?id=18442941&utm_source=wanqu.co&utm_campaign=Wanqu+Daily&utm_medium=website),讨论的问题是:你觉得这个最坏的、规模最大的代码是什么样子的?下面就有一个 Oracle 的前员工就介绍了 Oracle Database 12.2 这个版本的情况。他说这个整体的源代码接近 2500 万行 C 代码,可能大家维护 25 万行 C 代码的时候就会痛不欲生了,可以想想维护这么多代码的是一种什么样的感受。到现在为止,TiDB 的代码应该还不到 25 万行。当然 TiDB 的功能远远没有 Oracle 那么多,Oracle 的功能其实是很多的,历史积累一直往上加,加的很凶。\n\n这位 Oracle 前员工介绍了自己在 Oracle 的开发工作的流程,如下图:\n\n\n\n图 8 Oracle 开发者 fix bug 的过程

\n\n比如用户报了一个 Bug,然后他开始 fix。第一件事是花两周左右的时间去理解 20 个不同的 flag,看看有没有可能因为内部乱七八糟的原因来造成这个 Bug。大家可能不知道 MySQL 有多少变量,我刚做 TiDB 的时候也不知道,当时我觉得自己是懂数据库的,后来去看了一下 MySQL 的 flag 的变量数就惊呆了,但看到 Oracle 的 flag 变量数,那不是惊呆了,是绝望了。大家可能知道开启 1 个 flag 的时候会对什么东西有影响,但是要去理解 20 个 flag 开启时和另外几个 flag 组合的时候都有什么影响,可能会崩溃。所以其实精通 Oracle 这件事情,实际上可能比精通 C++ 这件事情更困难的。一个 Oracle 开发者在内部处理这件事情都这么复杂,更何况是外面的用户。但 Oracle 确实是功能很强大。\n\n说回这位前 Oracle 员工的描述,他接着添加了更多的 flag 处理一个新的用户场景的问题,然后加强代码,最后改完以后会提交一个测试。先在 100 到 200 台机器上面把这个 Oracle 给 build 出来,然后再对这个 Oracle 去做新的测试。他应该对 Oracle 的测试用例的实际数量了解不深刻,我猜他可能不知道 Oracle 有多少个测试,所以写的是 “millions of tests”,这显然太低估了 Oracle 的测试数量。通常情况下,只会看到挂了的测试,看不到全部的测试数量。\n\n下面的步骤更有意思了:Go home,因为整个测试需要 20-30 个小时,跑完之后测试系统反馈了一个报告:挂了 200 多个 test,更茫然的是这 200 tests 他以前都没见过,这也是 Oracle 非常强大的一个地方,如果一个开发者的代码提交过去挂掉一两百个测试,是很正常的事情,因为 Oracle 的测试能 Cover 东西非常多,是这么多年来非常强大的积累,不停的堆功能的同时就不停的堆测试,当然也不停的堆 flag。所以从另一个角度来看,限制一个系统的功能数量,对于维护来说是非常重要的。\n\n总之,看完这个回复之后,我对行业前辈们充满了敬畏之情。\n\n### 2.3 Make it fast\n\n#### 2.3.1 新问题\n\n随着 TiDB 有用户开始上线,用户的数量和规模越来越大,这时候就出现了一个很有意思的事情,一部分用户把 TiDB 当成了可以支持事务、拥有良好实时性的数据仓库在用,和我们说:我们把公司 Hadoop 换了,数据量十几 T。\n\n我们就一下开始陷入了深深的思考,因为 TiDB 本来设计的目的不是这个方向,我们想做一个分布式 OLTP 数据库,并没有想说我们要做一个 Data Warehouse。但是用户的理由让我们觉得也很有道理,无法反驳——TiDB 兼容 MySQL,会 MySQL 的人很多,更好招人,最重要的是 Hadoop 跑得还不够快。\n\n虽然我们自己也很吃惊,但这体现了 TiDB 另一方面的价值,所以我们继续问用户还有什么痛点。用户表示还有一部分查询不够快,数据没办法做到 shuffle,而且以前用 Spark,TiDB 好像没有 Spark 的支持。\n\n我们想了想,TiDB 直接连 Spark 也是可以的,但这样 Spark 对底下没有感知,事务跑得巨慢,就跟 Spark 接 MySQL 没什么差别。我们研究了一下,做出了一个新的东西——TiSpark。TiSpark 就开始能够同时在 TiDB 上去跑 OLAP 和 OLTP。\n\n\n\n图 9 出现的新问题

\n\n就在我们准备改进 TiDB 的数据分析能力的时候,突然又有一大批 TP 用户上线了,给我们报了一堆问题,比如执行计划不准确,选不到最优执行计划,数据热点分布不均匀,Raft store 单线程写入瓶颈,报表跑的慢等等……于是我们制定了 1.0 到 2.X 的计划,先把用户提的这些问题一一解决。\n\n**这里有另外一条哲学:将用户遇到的问题放在第一优先级。我们从产品最初设计和之后 Roadmap 计划永远是按照这个原则去做的。**\n\n**首先,执行计划不准确的问题。** 最简单有效的解决办法是加一个 Index Hint,就像是“你告诉我怎么执行,我就怎么执行,我自己不会自作聪明的选择”。但这不是长久之计,因为用户可能是在一个界面上选择各种条件、参数等等,最后拼成一个 SQL,他们自己没办法在里面加 Index Hint。我们不能决定用户的使用习惯,所以从这时开始,我们决定从 RBO(Rule Based Optimizer)演进到 CBO(Cost Based Optimizer),这条路也走了非常久,而且还在持续进行。\n\n**第二个是热点数据处理问题。** 我们推出了一个热点调度器,这个可能大家在分布式数据库领域第一次听说,数据库领域应该是 PingCAP 首创。 热点调度器会统计、监控整个系统热点情况,再把这些热点做一个快速迁移和平衡,比如整个系统有 10 个热点,某一个机器上有 6 个热点,这台机器就会很卡,这时热点调度器会开始将热点打散,快速分散到集群的其他机器上去,从而让整个集群的机器都处于比较正常的负载状态。\n\n**第三个就是解决 Raft store 单线程瓶颈的问题**。为了改变 Raft store 单线程,我们大概花了一年多的时间,目前已经在 TiDB 3.0 里实现了。我们将 Raft store 线程更多耗时的计算变成异步操作,offload 到其它线程。不知道有没有人会好奇为什么这个改进会花这么长时间?我们一直认为数据库的稳定性第一位的。分布式系统里面一致性协议本身也复杂,虽然说 Raft 是比 Paxos 要简单,但它实际做起来也很复杂,要在一个复杂系统里支持多线程,并且还要做优化,尽可能让这个 I/O 能 group 到一起,其实非常耗精力。\n\n**第四个就是解决报表跑得慢的问题**,这个骨头特别硬,我们也是啃到今天还在继续。首先要大幅提升 TiDB 在分析场景下的能力。大家都可以看到我们在发布每一个版本的时候,都会给出与上一个版本的 TPC-H 性能对比(TPC-H 是一个有非常多的复杂查询、大量运算的场景)。其次就是高度并行化,充分利用多核,并提供参数控制,这个特性可能很多用户不知道,我们可以配一下参数,就让 TiDB 有多个并发在底层做 Scan。\n\n解决完这些问题,我们终于觉得可以喘口气了,但喘气的时间就不到一个星期,很快又有很多用户的反馈开始把我们淹没了。因为随着用户规模的扩大,用户反馈问题的速度也变得越来越快,我们处理的速度不一定跟的上用户的增速。\n\n#### 2.3.4 新呼声\n\n这时候我们也听到了用户的一些「新呼声」。\n\n有用户说他们在跑复杂查询时 OLTP 的查询延迟变高了,跑一个报表的时候发现 OLTP 开始卡了。这个问题的原因是在跑复杂查询的时候,SQL 资源被抢占。我们又想有没有可能将 OLAP 和 OLTP 的 Workload 分开?于是我们搞了第一个实验版本,在 TiKV 里把请求分优先级,放到不同队列里面去,复杂 Query 放在第一优先级的队列, OLTP 放在高优先级。然后我们发现自己是对报表理解不够深刻,这个方案只能解决一部分用户的问题,因为有的报表跑起来需要几个小时,导致队列永远是满的,永远抢占着系统的资源。还有一部分用户的报表没有那么复杂,只是希望报表跑得更快、更加实时,比如一个做餐饮 SaaS 的用户,每天晚上需要看一下餐馆营收情况,统计一家餐馆时速度还行,如果统计所有餐馆的情况,那就另说了。\n\n另外,报表有一些必需品,比如 View 和 Window Function,没有这些的话 SQL 写起来很痛苦,缺乏灵活度。\n\n与此同时,用户关于兼容性和新特性的要求也开始变多,比如希望支持 MySQL 类似的 table partition,还有银行用户习惯用悲观锁,而 TiDB 是乐观锁,迁移过来会造成额外的改造成本(TiDB 3.0 已经支持了悲观锁)。\n\n还有用户有 400T 的数据,没有一个快速导入的工具非常耗时(当然现在我们有快速导入工具TiDB Lightning),这个问题有一部分原因在于用户的硬件条件限制,比如说千兆网导入数据。\n\n还有些用户的数据规模越来越大,到 100T 以上就开始发现十分钟已经跑不完 GC 了(TiDB 的 GC 是每十分钟一次),一个月下来 GC 已经整体落后了非常多。\n\n\n\n图 10 用户的新呼声

\n\n我们当时非常头痛,收到了一堆意见和需求,压力特别大,然后赶紧汇总了一下,如图 10 所示。\n\n面对这么多的需求,我们考虑了两个点:\n\n* 哪些是共性需求?\n\n* 什么是彻底解决之道?\n\n**把共性的需求都列在一块,提供一个在产品层面和技术层面真正的彻底的解决办法。**\n\n比如图 10 列举的那么多问题,其实真正要解决三个方面:性能、隔离和功能。性能和隔离兼得好像很困难,但是这个架构有非常独特的优势,也是可以做得到的。那可以进一步「三者兼得」,同时解决功能的问题吗?我们思考了一下,也是有办法的。TiDB 使用的 Raft 协议里有一个 Raft Learner 的角色,可以不断的从 Leader 那边复制数据,我们把数据同步存成了一个列存,刚才这三方面的问题都可以用一个方案去彻底解决了。\n\n首先复杂查询的速度变快了,众所周知分析型的数据引擎基本上全部使用的是列存。第二就是强一致性,整个 Raft 协议可以保证从 Learner 读数据的时候可以选择一致性的读,可以从 Leader 那边拿到 Learner 当前的进度,判断是否可以对外提供请求。第三个是实时性可以保证,因为是通过 streaming 的方式复制的。\n\n所以这些看上去非常复杂的问题用一个方案就可以解决,并且强化了原来的系统。这个「强化」怎么讲?从用户的角度看,他们不会考虑 Query 是 OLAP 还是 OLTP,只是想跑这条 Query,这很合理。**用一套东西解决用户的所有问题,对用户来说就是「强化」的系统。**\n\n## 三、关于成本问题的思考\n\n\n\n\n图 11 成本问题

\n\n很多用户都跟我们反馈了成本问题,用户觉得全部部署到 SSD 成本有点高。一开始听到这个反馈,我们还不能理解,SSD 已经很便宜了呀,而且在整个系统来看,存储机器只是成本的一小部分。后来我们深刻思考了一下,其实用户说得对,很多系统都是有早晚高峰的,如果在几百 T 数据里跑报表,只在每天晚上收工时统计今天营业的状况,那为什么要求用户付出最高峰值的配置呢?这个要求是不合理的,合不合理是一回事,至于做不做得到、怎么做到是另外一回事。\n\n于是我们开始面临全新的思考,这个问题本质上是用户的数据只有一部分是热的,但是付出的代价是要让机器 Handle 所有的数据,所以可以把问题转化成:我们能不能在系统里面做到冷热数据分离?能不能支持系统动态弹性的伸缩,伸展热点数据,用完就释放?\n\n如果对一个系统来说,峰值时段和非峰值时段的差别在于峰值时段多了 5% 的热点。我们有必要去 Handle 所有的数据吗?**所以彻底的解决办法是对系统进行合理的监控,检测出热点后,马上创建一个新的节点,这个新的节点只负责处理热点数据,而不是把所有的数据做动态的 rebalance,重新搬迁。在峰值时间过去之后就可以把复制出来的热点数据撤掉,占的这个机器可以直接停掉了,不需要长时间配备非常高配置的资源,而是动态弹性伸缩的。**\n\nTiDB 作为一个高度动态的系统,本身的架构就具有非常强的张力,像海绵一样,能够满足这个要求,而且能根据系统负载动态的做这件事。这跟传统数据库的架构有很大的区别。比如有一个 4T 的 MySQL 数据库,一主一从,如果主库很热,只能马上搞一个等配的机器重挂上去,然后复制全部数据,但实际上用户需要的只是 5% 的热数据。而在 TiDB 里,数据被切成 64MB 一个块,可以很精确的检测热数据,很方便的为热数据做伸展。这个特性预计在 TiDB 4.0 提供。\n\n这也是一个良好的架构本身带来的强大的价值,再加上基于 K8s 和云的弹性架构,就可以得到非常多的不一样的东西。同样的思路,如果我要做数据分析,一定是扫全部数据吗?对于一个多租户的系统,我想统计某个餐馆今天的收入,数据库里有成千上万个餐馆,我需要运算的数据只是其中一小块。如果我要快速做列存计算时,需要把数据全部复制一份吗?也不需要,只复制我需要的这部分数据就行。这些事情只有一个具有弹性、高度张力的系统才能做到。这是 TiDB 相对于传统架构有非常不一样的地方。时至今天,我们才算是把整个系统的架构基本上稳定了,基于这个稳定的架构,我们还可以做更多非常具有张力的事情。\n\n**所以,用一句话总结我们解决成本问题的思路是:一定要解决真正的核心的问题,解决最本质的问题。**\n\n## 四、关于横向和纵向发展的哲学\n\nTiDB 还有一条哲学是关于横向和纵向发展的选择。 \n\n通常业内会给创业公司的最佳建议是优先打“透”一个行业,因为行业内复制成本是最低的,可复制性也是最好的。**但 TiDB 从第一天开始就选择了相反的一条路——「先往通用性发展」,这是一条非常艰难的路,意味着放弃了短时间的复制性,但其实我们换取的是更长时间的复制性,也就是通用性。**\n\n因为产品的整体价值取决于总的市场空间,产品的广泛程度会决定产品最终的价值。早期坚定不移的往通用性上面走,有利于尽早感知整个系统是否有结构性缺陷,验证自己对用户需求的理解是否具有足够的广度。如果只往一个行业去走,就无法知道这个产品在其他行业的适应性和通用性。如果我们变成了某个行业专用数据库,那么再往其他行业去发展时,面临的第一个问题是自己的恐惧。这恐惧怎么讲呢?Database 应该是一个通用型的东西,如果在一个行业里固定了,那么你要如何确定它在其他场景和行业是否具有适应性?\n\n**这个选择也意味着我们会面临非常大的挑战,一上来先做最厉害的、最有挑战的用户。** 如果大家去关注整个 TiDB 发展的用户案例的情况,你会注意到 TiDB 有这样一个特点,TiDB 是先做百亿美金以上的互联网公司,这是一个非常难的选择。但大家应该知道,百亿美金以上的互联网公司,在选择一个数据库等技术产品的时候,是没有任何商业上的考量的,对这些公司来说,你的实力是第一位的,一定要能解决他们问题,才会认可你整个系统。但这个也不好做,因为这些公司的应用场景通常都压力巨大。数据量巨大,QPS 特别高,对稳定性的要求也非常高。我们先做了百亿美金的公司之后,去年我们有 80% 百亿美金以上的公司用 TiDB,除了把我们当成竞争对手的公司没有用,其他全部在用。然后再做 30 亿美金以上的公司,今年是 10 亿美金以上的用户,实际上现在是什么样规模的用户都有,甭管多少亿美金的,“反正这东西挺好用的,我就用了。”所以我们现在也有人专门负责在用户群里面回答大家的提问。\n\n**其实当初这么定那个目标主要是考虑数据量,因为 TiDB 作为一个分布式系统一定是要处理具有足够数据量的用户场景,** 百亿美金以上的公司肯定有足够的数据,30 亿美金的公司也会有,因为他们的数据在高速增长,当我们完成了这些,然后再开始切入到传统行业,因为在这之前我们经过了稳定性的验证,经过了规模的验证,经过了场景的验证。\n\n\n\n图 12 横向发展与纵向发展

\n\n**坚持全球化的技术视野也是一个以横向优先的发展哲学。** 最厉害的产品一定是全球在用的。这个事情的最大差异在于视野和格局,而格局最终会反映到人才上,最终竞争不是在 PingCAP 这两百个员工,也不是现在 400 多个 Contributors,未来可能会有上千人参与整个系统的进化迭代,在不同的场景下对系统进行打磨,所以竞争本质上是人才和场景的竞争。基于这一条哲学,所以才有了现在 TiDB 在新一代分布式数据库领域的全面领先,无论是从 GitHub Star 数、 Contributor 数量来看,还是从用户数据的规模、用户分布的行业来看,都是领先的。同样是在做一个数据库,大家的指导哲学不一样会导致产品最终的表现和收获不一样,迭代过程也会完全不一样。我们在做的方向是「携全球的人才和全球的场景去竞争」。\n\n关于横向和纵向发展,并不是我们只取了横向。\n\n**2019 年 TiDB 演进的指导思想是:稳定性排第一,易用性排第二,性能第三,新功能第四。** 这是我在 2018 年经过思考后,把我们发展的优先级做了排序。上半年我们重点关注的是前两个,稳定性和易用性。下半年会关注纵向发展,「Make it fast」其实是纵向上精耕细作、释放潜力的事情。这个指导思想看起来好像又跟其他厂商想法不太一样。\n\n我们前面讲的三条哲学里面,最后一条就是「Make it fast」,如果要修建五百层的摩天大楼,要做的不是搭完一层、装修一层,马上给第一层做营业,再去搭第二层。而一定要先把五百层的架构搭好,然后想装修哪一层都可以。**TiDB 就是「摩天大楼先搭架构后装修」的思路,所以在 TiDB 3.0 发布之后,我们开始有足够的时间去做「装修」的事情。**\n\n## 五、总结与展望\n\n说了这么多故事,如果要我总结一下 2015 - 2019 年外面的朋友对 TiDB 的感受,是下图这样的:\n\n\n\n图 13 2015-2019 小结

\n\n2015 年,当我们开始做 TiDB 的时候,大家说:啊?这事儿你们也敢干?因为写一个数据库本身非常难,写一个分布式数据库就是无比的难,然后还是国人自主研发。到 2016 年的时候,大家觉得你好像折腾了点东西,听到点声音,但也没啥。到 2017、2018 年,大家看到有越来越多用户在用。2019 年,能看到更多使用后点赞的朋友了。\n\n我昨天翻了一下 2015 年 4 月 19 日发的一条微博。\n\n\n\n图 14 刚创业时发的微博

\n\n当时我们正准备创业,意气风发发了一条这样微博。这一堆话其实不重要,大家看一下阅读量 47.3 万,有 101 条转发,44 条评论,然而我一封简历都没收到。当时大家看到我们都觉得,这事儿外国人都没搞,你行吗?折腾到今天,我想应该没有人再对这个问题有任何的怀疑。**很多国人其实能力很强了,自信也可以同步跟上来,毕竟我们拥有全球最快的数据增速,很多厂家拥有最大的数据量,对产品有最佳的打磨场景。**\n\n想想当时我也挺绝望的,想着应该还有不少人血气方刚,还有很多技术人员是有非常强大的理想的,但是前面我也说了,总有一个从理想到现实的距离,这个距离很长,好在现在我们能收到很多简历。所以很多时候大家也很难想象我们刚开始做这件事情的时候有多么的困难,以及中间的每一个坚持。**只要稍微有一丁点的松懈,就可能走了另外一条更容易走的路,但是那条更容易走的路,从长远上看是一条更加困难的路,甚至是一条没有出路的路。**\n\n\n\n图 15 对 2020 年的展望

\n\n最后再说一下 2020 年。在拥有行业复制能力的之后,在产品层面我们要开始向着更高的性能、更低的延迟、更多 Cloud 支持(不管是公有云还是私有云都可以很好的使用 TiDB)等方向纵向发展。同时也会支持我刚刚说的,热点根据 Workload 自动伸缩,用极小的成本去扛,仅仅需要处理部分热点的数据,而不是复制整个数据的传统主-从思路。\n\n大家去想一想,如果整个系统会根据 Workload 自动伸缩,本质上是一个 self-driving 的事情。现在有越来越多的用户把 TiDB 当成一个数据中台来用,有了 TiDB 行列混存,并且 TiDB 对用户有足够透明度,就相当于是握有了 database 加上 ETL,加上 data warehouse,并且是保证了一致性、实时性的。\n\n昨天我写完 slides 之后想起了以前看的一个电视剧《大秦帝国》。第一部第九集里有一段关于围棋的对话。商鞅执黑子先行,先下在了一个应该是叫天元位置,大约在棋盘的中间。大家知道一般下围棋的时候都是先从角落开始落子居多。商鞅的对手就说,我许你重下,意思就是你不要开玩笑,谁下这儿啊?于是商鞅说这样一句话,“中枢之地,辐射四极,雄视八荒”,这也是一个视野和格局的事情。然后对手说:“先生招招高位,步步悬空,全无根基实地”,就是看起来好像是都还挺厉害的,一点实际的基础都没有,商鞅说:“旦有高位,岂无实地?”,后来商鞅赢了这盘棋,他解释道:“**棋道以围地为归宿,但必以取势为根本。势高,则围广**”。\n\n**这跟我们做 TiDB 其实很像,我们一上来就是先做最难最有挑战的具有最高 QPS 和 TPS、最大数据量的场景,这就是一个「取势」的思路,因为「势高,则围广」。** 所以我们更多时候是像我前面说的那样,站在哲学层面思考整个公司的运转和 TiDB 这个产品的演进的思路。这些思路很多时候是大家看不见的,因为不是一个纯粹的技术层面或者算法层面的事情。\n\n我也听说有很多同学对 TiDB 3.0 特别感兴趣,不过今天没有足够的时间介绍,我们会在后续的 TechDay 上介绍 3.0 GA 的重大特性,因为从 2.0 到 3.0 产生了一个巨大的变化和提升,性能大幅提升,硬件成本也下降了一倍的样子,需要一天的时间为大家详细的拆解。\n\n\n\n>本文根据我司 CEO 刘奇在第 100 期 Infra Meetup 上的演讲整理。\n\n- END -

","date":"2019-05-30","author":"刘奇","fillInMethod":"writeDirectly","customUrl":"guiding-ideologies-in-the-evolution-of-tidb","file":null,"relatedBlogs":[]},{"id":"Blogs_187","title":"The (Near) Future of Database — TiDB DevCon 2019","tags":["TiDB","架构"],"category":{"name":"观点洞察"},"summary":"在 TiDB DevCon 2019 上,我司联合创始人兼 CTO 黄东旭分享了对数据库行业大趋势以及未来数据库技术的看法。","body":">在 TiDB DevCon 2019 上,我司联合创始人兼 CTO 黄东旭分享了对数据库行业大趋势以及未来数据库技术的看法。以下是演讲实录,enjoy~ \n\n\n\n我司联合创始人兼 CTO 黄东旭

\n\n大家今天在这里看到了 TiDB 社区用户实践分享和我们自己的一些技术进展和展望,还有非常好玩的 Demo Show,正好在大会结束之前,我想跟大家聊一聊我心目中未来的 Database 应该是一个什么样子。\n\n其实我们并不是一个特别擅长发明名词的公司,我记得我们第一次去用 HTAP 这个词的时候,应该是 2016 左右。在使用 HTAP 这个词的时候,我们市场部同事还跟我们说 HTAP 这个词从来没人用过,都是论文里的词,大家都不知道,你把你们公司的产品定位改成这个别人都不知道怎么办?我们后来仔细想,还是觉得 HTAP 这个方向是一个更加适合我们的方向,所以还是选了 HTAP 这个词。现在很欣喜的看到现在各种友商、后来的一些数据库,都开始争相说 HTAP,就是说得到了同行的认可。\n\n那么在 HTAP 的未来应该是一个什么样子,我希望能够在今年这个 Talk 里面先说一说,但是这个题目起的有点不太谦虚,所以我特地加了一个「Near」, 分享一下这一年、两年、三年我们想做什么,和对行业大趋势的展望。\n\n\n\n图 1

\n\n**今天我们的分享的一个主题就是:「我们只做用户想要的东西,并不是要去做一个完美的东西」**。其实很多工程师包括我们自己,都会有一个小小的心理的洁癖,就是想要做一个超级快、超级牛的东西,但是做出来一个数据库,单机跑分一百万 TPS ,其实用户实际业务就需要 3000,然后所有的用户还会说我需要这些东西,比如需要 Scalability(弹性扩展), Super Large 的数据量,最好是我的业务一行代码都不用改,而且 ACID 能够完全的满足,怎么踹都踹不坏,机器坏了可以高可用,业务层完全不用动, 另外可以在跑 OLTP 的同时,完全不用担心任何资源隔离地跑 OLAP(这里不是要说大家的愿望不切实际,而是非常切实际,我们也觉得数据库本身就应该是这样的。所以大家记住这几个要点,然后慢慢看 TiDB 到底是不是朝着这个方向发展的)。**本质上来说用户的需求就是「大一统」。看过《魔戒》的同学都知道这句话 :ONE RING TO RULE THEM ALL,就是一套解决方案去解决各种问题**。\n\n过去很多,包括一些行业的大佬之前说在各种环境下都要出一个数据库来解决特定的一个问题,但是其实看上去我们想走的方案还是尽可能在一个平台里面,尽可能大范围去解决用户的问题。因为不同的产品之间去做数据的交互和沟通,其实是蛮复杂的。\n\n\n\n图 2 理想中的「赛道」

\n\n这张图(图 2)什么意思呢?就是很多人设计系统的时候,总是会陷入跑分思维,就是说这个东西在实验室或者说在一个特定的 Workload 下,跑得巨快无比。如果大家去看一下大概 2000 年以后关于数据库的论文,很多在做一个新的模型或者新的系统的时候,都会说 TPCC 能够跑到多大,然后把 Oracle 摁在地上摩擦,这样的论文有很多很多很多。但是大家回头看看 Oracle 还是王者。所以大多数实验室的产品和工程师自己做的东西都会陷入一个问题,就是想象中的我的赛道应该是一个图 2 那样的,但实际上用户的业务环境是下面这样的(图 3)。很多大家在广告上看到特别牛的东西,一放到生产环境或者说放到自己的业务场景里面就不对了,然后陷入各种各样的比较和纠结的烦恼之中。\n\n\n\n图 3 实际上用户的业务环境

\n\nTiDB 的定位或者说我们想做的事情,并不是在图 2 那样的赛道上,跑步跑得巨快,全世界没人在短跑上跑得过我,我们不想做这样。或者说,**我们其实也能跑得很快,但是并不想把所有优势资源全都投入到一个用户可能一辈子都用不到的场景之中。我们其实更像是做铁人三项的,因为用户实际应用场景可能就是一个土路。这就是为什么 TiDB 的设计放在第一位的是「稳定性」**。\n\n我们一直在想能不能做一个数据库,怎么踹都踹不坏,然后所有的异常的状况,或者它的 Workload 都是可预期的。我觉得很多人远远低估了这个事情的困难程度,其实我们自己也特别低估了困难程度。大概 4 年前出来创业的时候,我们就是想做这么一个数据库出来,我跟刘奇、崔秋三个人也就三个月做出来了。但是到现在已经 4 年过去了,我们的目标跟当年还是一模一样。不忘初心,不是忘不掉,而是因为初心还没达到,怎么忘?其实把一个数据库做稳,是很难很难的。\n\n\n\n\n图 4 近年来硬件的发展

\n\n**而且我们这个团队的平均年龄可能也就在二十到三十岁之间,为什么我们如此年轻的一个团队,能够去做数据库这么古老的一件事情。其实也是得益于整个 IT 行业这几年非常大的发展**。图 4 是这几年发展起来的 SSD,内存越来越大,万兆的网卡,还有各种各样的多核的 CPU,虚拟化的技术,让过去很多不可能的事情变成了可能。\n\n举一个例子吧,比如极端一点,大家可能在上世纪八九十年代用过这种 5 寸盘、3 寸盘,我针对这样的磁盘设计一个数据结构,现在看上去是个笑话是吧?因为大家根本没有人用这样的设备了。在数据库这个行业里面很多的假设,在现在新的硬件的环境下其实都是不成立的。比如说,为什么 B-Tree 就一定会比 LSM-Tree 要快呢?不一定啊,我跑到 Flash 或者 NVMe SSD 、Optane 甚至未来的持久化内存这种介质上,那数据结构设计完全就发生变化了。过去可能需要投入很多精力去做的数据结构,现在暴力就好了。\n\n\n\n图 5 近年来软件变革

\n\n同时在软件上也发生了很多很多的变革,图 5 左上角是 Wisckey 那篇论文里的一个截图,还有一些分布式系统上的新的技术,比如 2014 年 Diego 发表了 Raft 这篇论文,另外 Paxos 这几年在各种新的分布式系统里也用得越来越多。\n\n**所以我觉得这几年我们赶上了一个比较好的时代,就是不管是软件还是硬件,还是分布式系统理论上,都有了一些比较大突破,所以我们基础才能够打得比较好**。\n\n\n\n图 6 Data Type

\n\n除了有这样的新的硬件和软件之外,我觉得在业务场景上也在发生一些比较大变化。过去,可能十年前就是我刚开始参加工作的时候,线上的架构基本就是在线和离线两套系统,在线是 Oracle 和 MySQL,离线是一套 Hadoop 或者一个纯离线的数据仓库。**但最近这两年越来越多的业务开始强调敏捷、微服务和中台化,于是产生了一个新的数据类型,就是 warm data,它需要像热数据这样支持 transaction、支持实时写入,但是需要海量的数据都能存在这个平台上实时查询, 并不是离线数仓这种业务**。\n\n所以对 warm data 来说,过去在 TiDB 之前,其实是并没有太好的办法去很优雅的做一层大数据中台架构的,**「the missing part of modern data processing stack」,就是在 warm data 这方面,TiDB 正好去补充了这个位置,所以才能有这么快的增长**。当然这个增长也是得益于 MySQL 社区的流行。\n\n\n\n图 7 应用举例

\n\n想象一下,我们如果在过去要做这样很简单的业务(图 7),比如在美国的订单库跟在中国的订单库可能都是在不同的数据库里,用户库可能是另外一个库,然后不同的业务可能是操作不同的库。如果我想看看美国的消费者里面有哪些在中国有过消费的,就是这么一条 SQL。过去如果没有像 TiDB 这样的东西,大家想象这个东西该怎么做?\n\n\n\n图 8 过去的解决方案

\n\n假如说这两边的数据量都特别大,然后已经分库分表了。过去可能只能第二天才可以看到前一天的数据,因为中间比如说一个 T+1 要做一个 ETL 到一个 data ware house 里。或者厉害一点的架构师可能会说,我可以做一套实时的 OLAP 来做这个事情,怎么做呢?比如说 MySQL 中间通过一个 MQ 再通过 Hadoop 做一下 ETL,然后再导到 Hadoop 上做一个冷的数据存储,再在上面去跑一个 OLAP 做实时的分析。先不说这个实时性到底有多「实时」,大家仔细算一算,这套架构需要的副本数有多少,比如 M 是我的业务数,N 是每一个系统会存储的 Replica,拍脑袋算一下就是下面这个数字(图 9 中的 **R** )。\n\n\n\n图 9 过去解决方案里需要的 Replica 数量

\n\n所以大家其实一开始在过去说,TiDB 这个背后这么多 Replica 不好,但其实你想想,你自己在去做这个业务的时候,大家在过去又能怎么样呢?所以我觉得 TiDB 在这个场景下去统一一个中台,是一个大的趋势。今天在社区实践分享上也看到很多用户都要提到了 TiDB 在中台上非常好的应用。\n\n\n\n图 10 现在的解决方案

\n\n**回顾完行业和应用场景近年来的一些变化之后,我们再说说未来。假设要去做一个面向未来的数据库,会使用哪些技术?**\n\n## 1. Log is the new database\n\n第一个大的趋势就是日志,「log is the new database」 这句话应该也是业界的一个共识吧。现在如果有一个分布式数据库的复制协议,还是同步一个逻辑语句过去,或者做 binlog 的复制,那其实还算比较 low 的。\n\n\n\n图 11 Log is the new database

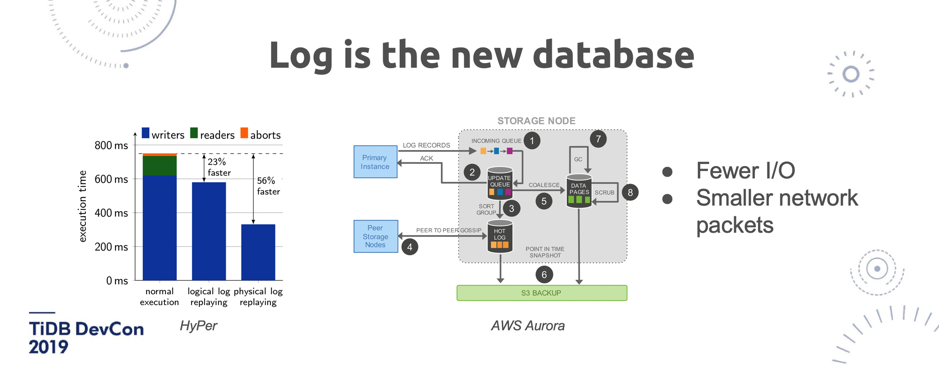

\n\n上面图 11 左半部分是 Hyper,它是慕尼黑工业大学的一个实验性数据库项目,它做了一些分析,第一个柱形是正常的 SQL 语句的执行时间,比如说直接把一语句放到另外一个库里去执行,耗时这么多。第二个柱形是用逻辑日志去存放,耗时大概能快 23%,第三个柱形能看到如果是存放物理日志能快 56%。所以大家仔细想想,**TiDB 的架构里的 TiFlash 其实同步的是 Raft 日志,而并不是同步 Binlog 或者其他的**。\n\n上面图 11 右半部分是 Aurora,它的架构就不用说了,同步的都是 redo log 。其实他的好处也很明显,也比较直白,就是 I/O 更小,网络传输的 size 也更小,所以就更快。\n\n然后在这一块 TiDB 跟传统的数据库有点不一样的就是,其实如果很多同学对 TiDB 的基础架构不太理解的话就觉得, Raft 不是一个一定要有 Index 或者说是一定强顺序的一个算法吗?那为什么能做到这样的乱序的提交?**其实 TiDB 并不是单 Raft 的架构,而是一个多 Raft 的架构,I/O 可以发生在任何一个 Raft Group 上**。传统的单机型数据库,就算你用更好的硬件都不可能达到一个线性扩展,因为无论怎么去做,都是这么一个架构不可改变。比如说我单机上 Snapshot 加 WAL,不管怎么写, 总是在 WAL 后面加,I/O 总是发生在这。但 TiDB 的 I/O 是分散在多个 Raft Group、多个机器上,这是一个很本质的变化,这就是为什么在一些场景下,TiDB 能够获取更好的吞吐。\n\n## 2. Vectorized\n\n第二个大趋势是全面的向量化。向量化是什么意思?我举个简单的例子。比如我要去算一个聚合,从一个表里面去求某一列的总量数据,如果我是一个行存的数据库,我只能把这条记录的 C 取出来,然后到下一条记录,再取再取再取,整个 Runtime 的开销也好,还有去扫描、读放大的每一行也好,都是很有问题的。但是如果在内存里面已经是一个列式存储,是很紧凑的结构的话,那会是非常快的。\n\n\n\n图 12 TiDB 向量化面临的挑战

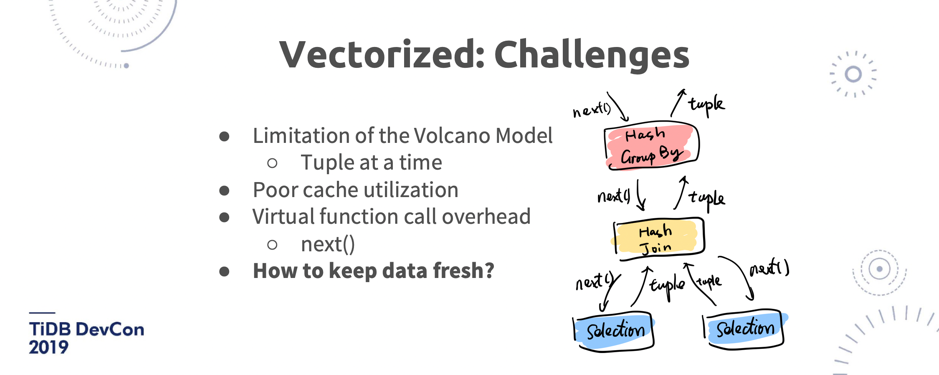

\n\n这里面其实也有一些挑战。我们花了大概差不多 2018 年一年的时间去做向量化的改造,其实还挺难的。为什么?首先 TiDB SQL 引擎是用了 Volcano 模型,这个模型很简单,就是遍历一棵物理计划的树,不停的调 Next,每一次 Next 都是调用他的子节点的 Next,然后再返回结果。这个模型有几个问题:第一是每一次都是拿一行,导致 CPU 的 L1、L2 这样的缓存利用率很差,就是说没有办法利用多 CPU 的 Cache。第二,在真正实现的时候,它内部的架构是一个多级的虚函数调用。大家知道虚函数调用在 Runtime 本身的开销是很大的,在[《MonetDB/X100: Hyper-Pipelining Query Execution》](http://cidrdb.org/cidr2005/papers/P19.pdf)里面提到,在跑 TPC-H 的时候,Volcano 模型在 MySQL 上跑,大概有 90% 的时间是花在 MySQL 本身的 Runtime 上,而不是真正的数据扫描。所以这就是 Volcano 模型一个比较大的问题。第三,如果使用一个纯静态的列存的数据结构,大家知道列存特别大问题就是它的更新是比较麻烦的, 至少过去在 TiFlash 之前,没有一个列存数据库能够支持做增删改查。那在这种情况下,怎么保证数据的新鲜?这些都是问题。\n\n\n\n\n图 13 TiDB SQL 引擎向量化

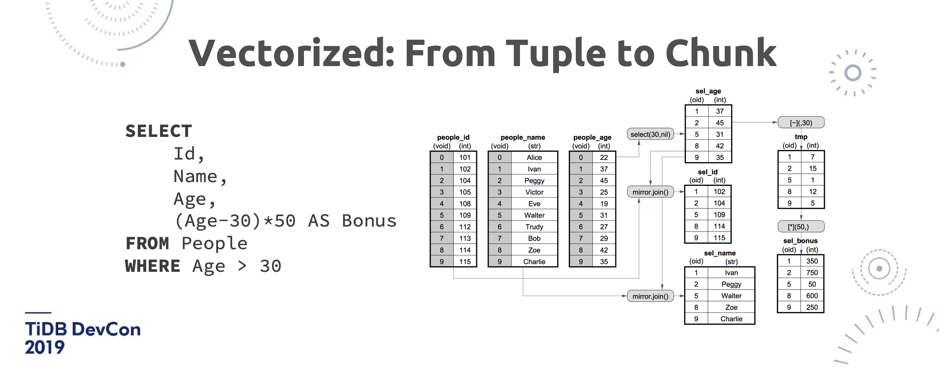

\n\nTiDB 已经迈出了第一步,我们已经把 TiDB SQL 引擎的 Volcano 模型,从一行一行变成了一个 Chunk 一个 Chunk,每个 Chunk 里面是一个批量的数据,所以聚合的效率会更高。而且在 TiDB 这边做向量化之外,我们还会把这些算子推到 TiKV 来做,然后在 TiKV 也会变成一个全向量化的执行器的框架。\n\n## 3. Workload Isolation\n\n另外一个比较大的话题,是 Workload Isolation。今天我们在演示的各种东西都有一个中心思想,就是怎么样尽可能地把 OLTP 跟 OLAP 隔离开。这个问题在业界也有不同的声音,包括我们的老前辈 Google Spanner,他们其实是想做一个新的数据结构,来替代 Bigtable-Like SSTable 数据结构,这个数据结构叫 Ressi,大家去看 2018 年 《Spanner: Becoming a SQL System》这篇 Paper 就能看到。它其实表面上看还是行存,但内部也是一个 Chunk 变成列存这样的一个结构。但我们觉得即使是换一个新的数据结构,也没有办法很好做隔离,因为毕竟还是在一台机器上,在同一个物理资源上。最彻底的隔离是物理隔离。\n\n\n\n\n图 14 TiFlash 架构

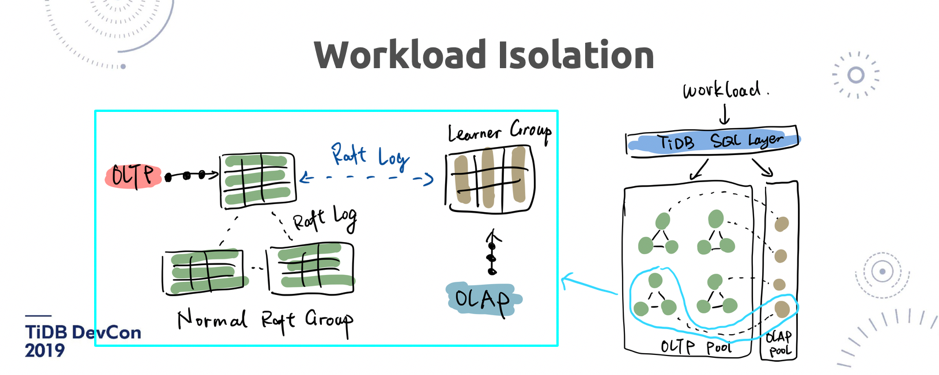

\n\n我们在 TiFlash 用了好几种技术来去保证数据是更新的。一是增加了 Raft Leaner,二是我们把 TiDB 的 MVCC 也实现在了 TiFlash 的内部。第三在 TiFlash 这边接触了更新(的过程),在 TiFlash 内部还有一个小的 Memstore,来处理更新的热数据结果,最后查询的时候,是列存跟内存里的行存去 merge 并得到最终的结果。**TiFlash 的核心思想就是通过 Raft 的副本来做物理隔离**。\n\n这个有什么好处呢?这是我们今天给出的答案,但是背后的思考,到底是什么原因呢?为什么我们不能直接去同步一个 binlog 到另外一个 dedicate 的新集群上(比如 TiFlash 集群),而一定要走 Raft log?**最核心的原因是,我们认为 Raft log 的同步可以水平扩展的**。因为 TiDB 内部是 Mult-Raft 架构,Raft log 是发生在每一个 TiKV 节点的同步上。大家想象一下,如果中间是通过 Kafka 沟通两边的存储引擎,那么实时的同步会受制于中间管道的吞吐。比如图 14 中绿色部分一直在更新,另一边并发写入每秒两百万,但是中间的 Kafka 集群可能只能承载 100 万的写入,那么就会导致中间的 log 堆积,而且下游的消费也是不可控的。**而通过 Raft 同步, Throughput 可以根据实际存储节点的集群大小,能够线性增长。这是一个特别核心的好处**。\n\n## 4. SIMD\n\n说完了存储层,接下来说一说执行器。TiDB 在接下来会做一个很重要的工作,就是全面地 leverage SIMD 的计算。我先简单科普一下 SIMD 是什么。\n\n\n\n\n图 15 SIMD 原理举例(1/2)

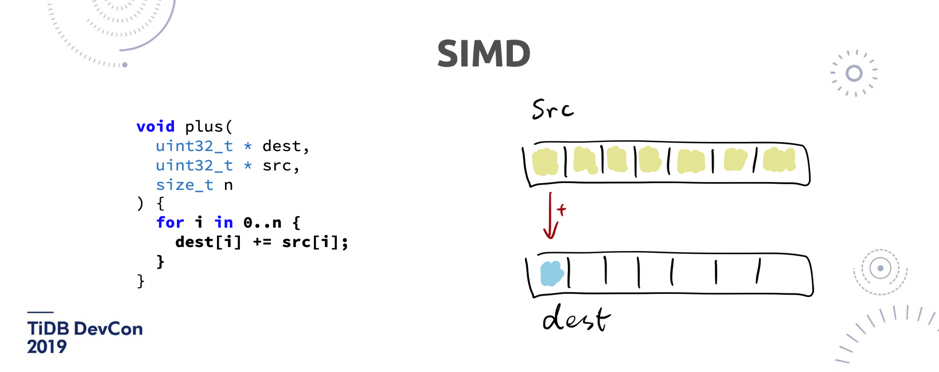

\n\n如图 15,在做一些聚合的时候,有这样一个函数,我要去做一个求和。正常人写程序,他就是一个 for 循环,做累加。但是在一个数据库里面,如果有一百亿条数据做聚合,每一次执行这条操作的时候,CPU 的这个指令是一次一次的执行,数据量特别大或者扫描的行数特别多的时候,就会很明显的感受到这个差别。\n\n\n\n图 16 SIMD 原理举例(2/2)

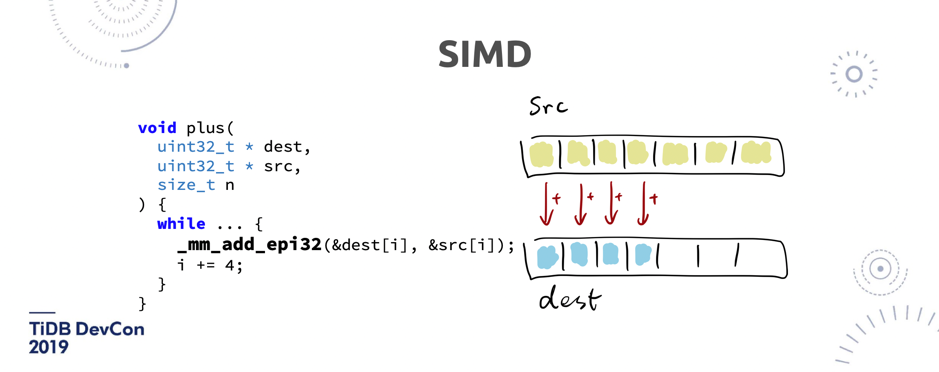

\n\n现代的 CPU 会支持一些批量的指令,比如像 _mm_add_epi32,可以一次通过一个32 位字长对齐的命令,批量的操作 4 个累加。看上去只是省了几个 CPU 的指令,但如果是在一个大数据量的情况下,基本上能得到 4 倍速度的提升。\n\n**顺便说一句,有一个很大的趋势是 I/O 已经不是瓶颈了**,大家一定要记住我这句话。再过几年,如果想去买一块机械磁盘,除了在那种冷备的业务场景以外,我相信大家可能都要去定制一块机械磁盘了。未来一定 I/O 不会是瓶颈,那瓶颈会是什么?CPU。**我们怎么去用新的硬件,去尽可能的把计算效率提升,这个才是未来我觉得数据库发展的重点**。比如说我怎么在数据库里 leverage GPU 的计算能力,因为如果 GPU 用的好,其实可以很大程度上减少计算的开销。所以,如果在单机 I/O 这些都不是问题的话,下一个最大问题就是怎么做好分布式,这也是为什么我们一开始就选择了一条看上去更加困难的路:我要去做一个 Share-nothing 的数据库,并不是像 Aurora 底下共享一个存储。\n\n## 5. Dynamic Data placement\n\n\n\n\n图 17 Dynamic Data placement (1/2)分库分表方案与 TiDB 对比

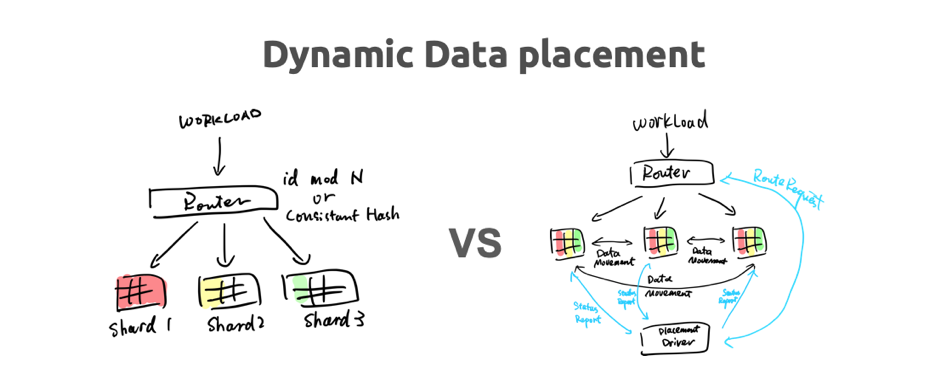

\n\n在今天大家其实看不到未来十年数据增长是怎样的,回想十年前大家能想到现在我们的数据量有这么大吗?不可能的。所以新的架构或者新的数据库,一定要去面向我们未知的 Scale 做设计。比如大家想象现在有业务 100T 的数据,目前看可能还挺大的,但是有没有办法设计一套方案去解决 1P、2P 这样数据量的架构?**在海量的数据量下,怎么把数据很灵活的分片是一个很大的学问**。\n\n为什么分库分表在对比 TiDB 的时候,我们会觉得分库分表是上一代的方案。这个也很好理解,核心的原因是分库分表的 Router 是静态的。如果出现分片不均衡,比如业务可能按照 User ID 分表,但是发现某一地方/某一部分的 User ID 特别多,导致数据不均衡了,这时 TiDB 的架构有什么优势呢?就是 TiDB 彻底把分片这个事情,从数据库里隔离了出来,放到了另外一个模块里。**分片应该是根据业务的负载、根据数据的实时运行状态,来决定这个数据应该放在哪儿。这是传统的静态分片不能相比的,不管传统的用一致性哈希,还是用最简单的对机器数取模的方式去分片(都是不能比的)**。\n\n在这个架构下,甚至未来我们还能让 AI 来帮忙。把分片操作放到 PD 里面,它就像一个 DBA 一样,甚至预测 Workload 给出数据分布操作。比如课程报名数据库系统,系统发现可能明天会是报名高峰,就事先把数据给切分好,放到更好的机器上。这在传统方案下是都需要人肉操作,其实这些事情都应该是自动化的。\n\n\n\n图 18 Dynamic Data placement (2/2)

\n\n**Dynamic Data placement 好处首先是让事情变得更 flexible ,对业务能实时感知和响应**。另外还有一点,为什么我们有了 Dynamic Placement 的策略,还要去做 Table Partition([今天上午申砾也提到了](https://zhuanlan.zhihu.com/p/57749943))?Table Partition 在背后实现其实挺简单的。相当于业务这边已经告诉我们数据应该怎么分片比较好,我们还可以做更多针对性的优化。这个 Partition 指的是逻辑上的 Partition ,是可能根据你的业务相关的,比如说我这张表,就是存着 2018 年的数据,虽然我在底下还是 TiDB 这边,通过 PD 去调度,但是我知道你 Drop 这个 Table 的时候,一定是 Drop 这些数据,所以这样会更好,而且更加符合用户的直觉。\n\n但这样架构仍然有比较大的挑战。当然这个挑战在静态分片的模型上也都会有。比如说围绕着这个问题,我们一直在去尝试解决怎么更快的发现数据的热点,比如说我们的调度器,如果最好能做到,比如突然来个秒杀业务,我们马上就发现了,就赶紧把这块数据挪到好的机器上,或者把这块数据赶紧添加副本,再或者把它放到内存的存储引擎里。这个事情应该是由数据库本身去做的。所以为什么我们这么期待 AI 技术能够帮我们,是因为虽然在 TiDB 内部,用了很多规则和方法来去做这个事情,但我们不是万能的。\n\n## 6. Storage and Computing Seperation\n\n\n\n图 19 存储计算分离

\n\n还有大的趋势是存储计算分离。我觉得现在业界有一个特别大的问题,就是把存储计算分离给固化成了某一个架构的特定一个指代,比如说只有长的像 Aurora 那样的架构才是存储计算分离。那么 TiDB 算存储计算分离吗?我觉得其实算。**或者说存储计算分离本质上带来的好处是什么?就是我们的存储依赖的物理资源,跟计算所依赖的物理资源并不一样。这点其实很重要**。就用 TiDB 来举例子,比如计算可能需要很多 CPU,需要很多内存来去做聚合,存储节点可能需要很多的磁盘和 I/O,如果全都放在一个组件里 ,调度器就会很难受:我到底要把这个节点作为存储节点还是计算节点?其实在这块,可以让调度器根据不同的机型(来做决定),是计算型机型就放计算节点,是存储型机型就放存储节点。\n\n## 7. Everything is Pluggable\n\n\n\n图 20 Everything is Pluggable

\n\n今天由于时间关系没有给大家演示的**插件平台**。未来 TiDB 会变成一个更加灵活的框架,像图 20 中 TiFlash 是一个 local storage,我们其实也在秘密研发一个新的存储的项目叫 Unitstore,可能明年的 DevCon 就能看到它的 Demo 了。在计算方面,每一层我们未来都会去对外暴露一个非常抽象的接口,能够去 leverage 不同的系统的好处。今年我其实很喜欢的一篇 Paper 是 [F1 Query](https://mp.weixin.qq.com/s/PrX0yhGkoPzQUZFQ2EkIbw) 这篇论文,基本表述了我对一个大规模的分布式系统的期待,架构的切分非常漂亮。\n\n## 8. Distributed Transaction\n\n\n\n图 21 Distributed Transaction(1/2)

\n\n说到分布式事务,我也分享一下我的观点。**目前看上去,ACID 事务肯定是必要的**。我们仍然还没有太多更好的办法,除了 Google 在这块用了原子钟,Truetime 非常牛,我们也在研究各种新型的时钟的技术,但是要把它推广到整个开源社区也不太可能。当然,时间戳,不管是用硬件还是软件分配,仍然是我们现在能拥有最好的东西, 因为如果要摆脱中心事务管理器,时间戳还是很重要的。**所以在这方面的挑战就会变成:怎么去减少两阶段提交带来的网络的 round-trips?或者如果有一个时钟的 PD 服务,怎么能尽可能的少去拿时间戳?**\n\n\n\n图 22 Distributed Transaction(2/2)

\n\n我们在这方面的理论上有一些突破,我们把 Percolator 模型做了一些优化,能够在数学上证明,可以少拿一次时钟。虽然我们目前还没有在 TiDB 里去实现,但是我们已经把数学证明的过程已经开源出来了,我们用了 [TLA+ 这个数学工具去做了证明](https://github.com/pingcap/tla-plus/blob/master/OptimizedCommitTS/OptimizedCommitTS.tla)。此外在 PD 方面,我们也在思考是不是所有的事务都必须跑到 PD 去拿时间戳?其实也不一定,我们在这上面也已有一些想法和探索,但是现在还没有成型,这个不剧透了。另外我觉得还有一个非常重要的东西,就是 Follower Read。很多场景读多写少,读的业务压力很多时候是要比写大很多的,Follower Read 能够帮我们线性扩展读的性能,而且在我们的模型上,因为没有时间戳 ,所以能够在一些特定情况下保证不会去牺牲一致性。\n\n## 9. Cloud-Native Architecture\n\n\n\n图 23 Cloud-Native

\n\n另外一点就是 Cloud-Native。刚刚中午有一个社区小伙伴问我,你们为什么不把多租户做在 TiDB 的系统内部?**我想说「数据库就是数据库」,它并不是一个操作系统,不是一个容器管理平台。我们更喜欢模块和结构化更清晰的一个做事方式。**而且 Kubernetes 在这块已经做的足够好了 ,我相信未来 K8s 会变成集群的新操作系统,会变成一个 Linux。比如说如果你单机时代做一个数据库,你会在你的数据库里面内置一个操作系统吗?肯定不会。所以这个模块抽象的边界,在这块我还是比较相信 K8s 的。《Large-scale cluster management at Google with Borg》这篇论文里面提到了一句话,BigTable 其实也跑在 Borg 上。\n\n\n\n图 24 TiDB 社区小伙伴的愿望列表