::43222/trace/df6bfbff` 就能获得该 SQL 所经过的源码文件和代码块信息。\n\n```\n// http://localhost:43222/trace/df6bfbff\n\n{\n \"sql\": \"show databases\",\n \"trace\": [\n {\n \"file\": \"executor/batch_checker.go\",\n \"line\": null\n },\n {\n \"file\": \"infoschema/infoschema.go\",\n \"line\": [\n [\n 113,\n 113\n ],\n [\n 261,\n 261\n ],\n //....\n }\n ],\n}\n```\nline 字段输出的每个二元组都是一个基本块的起始与结束行号(左闭右闭)。基本块的定义是绝对不会产生分支的一个代码块,也是我们统计的最小粒度。那是如何识别出 Go 代码中基本块的呢?其实工作量还挺大的,幸好 Go 的源码中有这一段,我们又刚好看到过,就把它裁剪出来,成为 [go-blockscanner](https://github.com/DQinYuan/go-blockscanner)。\n\n因为主要目标是正确性诊断,所以我们限定系统不对 TiDB 并发执行 SQL,这样就可以认为从 `server/conn.go:handleQuery` 方法被调用开始,到 SQLDebug 模块访问 trace 接口的这段时间所有被执行的基本块都是这条 SQL 的执行路径。当 SQLDebug 模块访问 HTTP 接口,将会同时删除该 SQL 相关的 trace 信息,避免内存被撑爆。\n\n### 基本块统计\n\nSQLDebug 模块在获取到每条 SQL 经过的基本块信息后,会对每个基本块建立如下的可视化模型。\n\n**首先是颜色,经过基本块的失败用例比例越高,基本块的颜色就越深。**\n\n\n\n\n**然后是亮度,经过基本块的失败用例在总的失败用例中占的比例越高,基本块的亮度越高。**\n\n\n\n已经有了颜色指标,为什么还要一个亮度指标呢?其实亮度指标是为了弥补“颜色指标 Score”的一些偏见。比如某个代码路径只被一个错误用例经过了,那么它显然会获得 Score 的最高分 1,事实上这条路径不那么有代表性,因为这么多错误用例中只有一个经过了这条路径,大概率不是错误的真正原因。所以需要额外的一个亮度指标来避免这种路径的干扰,**只有颜色深,亮度高的代码块,才是真正值得怀疑的代码块。**\n\n上面的两个模型主要是依据之前提到的 Visualization 的论文,我们还自创了一个文件排序的指标,失败用例在该文件中的密度越大(按照基本块),文件排名越靠前:\n\n\n\n前端拿到这些指标后,按照上面计算出的文件排名顺序进行展示,越靠前的文件存在问题的风险就越高。\n\n\n\n当点击展开后可以看到染色后的代码块:\n\n\n\n**我们经过一些简单的实验,文件级别的诊断相对比较准确,对于基本块的诊断相对还有些粗糙,这跟没有实现 SQLMin 有很大关系,毕竟 SQLMin 能去除不少统计时的噪声。**\n\n## 还能不能做点别的?\n\n看到这里,你可能觉得这个项目不过是针对数据库系统的自动化测试。而实际上借助代码自动调试的思路,可以给我们更多的启发。\n\n### 源码教学\n\n阅读和分析复杂系统的源码是个头疼的事情,TiDB 就曾出过 [24 篇源码阅读系列文章](https://pingcap.com/blog-cn/#TiDB-%E6%BA%90%E7%A0%81%E9%98%85%E8%AF%BB),用一篇篇文字为大家解读源码,江湖人称 “二十四章经”。那么是否可以基于源码的可视化跟踪做成一个通用工具呢?这样在程序执行的同时就可以直观地看到代码的运行过程,对快速理解源码一定会大有帮助。更进一步,配合源码在线执行有没有可能做成一个在线 web 应用呢?\n\n### 全链路测试覆盖统计\n\n语言本身提供的单测覆盖统计工具已经比较完备了,但一般测试流程中还要通过 e2e 测试、集成测试、稳定性测试等等。能否用本文的方法综合计算出各种测试的覆盖度,并且与 CI 系统和自动化测试平台整合起来。利用代码染色技术,还可以输出代码执行的热力图分析。结合 profiler 工具,是不是还可以辅助来定位代码的性能问题?\n\n\n\n### Chaos Engineering\n\n在 [PingCAP](https://pingcap.com/) 内部有诸多的 [Chaos](https://www.infoq.cn/article/EEKM947YbboGtD_zQuLw) 测试平台,用来验证分布式系统的鲁棒性,譬如像 [Jepsen](https://github.com/jepsen-io/jepsen) ,还有 PingCAP 自研的薛定谔稳定性测试系统等。混沌工程测试比较困扰的一点是,当跑出问题之后想再次复现就很难,只能通过当时的情形去猜代码可能哪里有问题。如果能在程序运行时记录代码的执行路径,根据问题发生时间点附近的日志和监控进一步缩小范围,再结合代码执行路径分析就能精确快速的定位到问题的原因。\n\n### 与分布式 Tracing 系统集成\n\nGoogle 有一篇论文是介绍其内部的 [分布式追踪系统 Dapper](https://ai.google/research/pubs/pub36356) ,同时社区也有比较出名的项目 [Open Tracing](https://opentracing.io/) 作为其开源实现,Apache 下面也有类似的项目 [Skywalking](https://skywalking.apache.org/)。一般的 Tracing 系统主要是跟踪用户请求在多个服务之间的调用关系,并通过可视化来辅助排查问题。但是 Tracing 系统的跟踪粒度一般是服务层面,如果我们把 `trace_id` 和 `span_id` 也当作标注传递给代码块进行打桩,那是不是可以在 Tracing 系统的界面上直接下钻到源码,听起来是不是特别酷?\n\n## 接下来的工作\n\n因为 Hackathon 时间有限,我们当时只完成了一个非常简单的原型,距离真正实现睡觉时程序自动查 bug 还有一段路要走,我们计划对项目持续的进行完善。\n\n接下来,首先要支持并行执行多个测试用例,这样才能在短时间得到足够多的实验样本,分析结果才能更加准确。另外,要将注入的代码对程序性能的影响降低到最小,从而应用于更加广泛的领域,比如性能压测场景,甚至在生产环境中也能够开启。\n\n看到这里可能你已经按耐不住了,附上 [项目的完整源码](https://github.com/fuzzdebugplatform/fuzz_debug_platform),Welcome to hack!","date":"2019-12-03","author":"我和我的 SQL 队","fillInMethod":"writeDirectly","customUrl":"sqldebug-automatically","file":null,"relatedBlogs":[]},{"id":"Blogs_154","title":"TiDB Hackathon 2019 — 流量和延迟减半!挑战 TiDB 跨数据中心难题","tags":["跨数据中心","Hackathon"],"category":{"name":"社区动态"},"summary":"我们针对 TiDB 跨数据中心方案做了一些优化,使得跨地域 SQL 查询延迟下降 50%,跨节点消息数减半,即网络流量减半。","body":">作者介绍:.* team(成员:庄天翼、朱贺天、屈鹏、林豪翔)参加了 [TiDB Hackathon 2019](https://pingcap.com/community-cn/hackathon2019/),他们项目「TiDB 跨数据中心方案的优化」斩获了二等奖。\n\n众所周知,在对可用性要求极高的行业领域(比如金融、通信),分布式数据库需要跨地域的在多个数据中心之间建立容灾以及多活的系统架构,同时需要保持数据完整可用。但这种方式同时也带来了一些问题:\n\n1. 跨地域的网络延迟非常高,通常在几十毫秒左右,洲际间更能达到几百毫秒。\n2. 跨地域的网络专线带宽昂贵、有限,且难于扩展。\n\n在今年 TiDB Hackathon 的比赛过程中,我们针对以上问题做了一些有趣的事情,并获得如下优化成果:\n\n1. 跨地域 SQL 查询,延迟下降 50%(图 1)。\n2. 跨节点消息数减半,即网络流量减半(图 2)。\n\n\n\n图 1 延迟对比

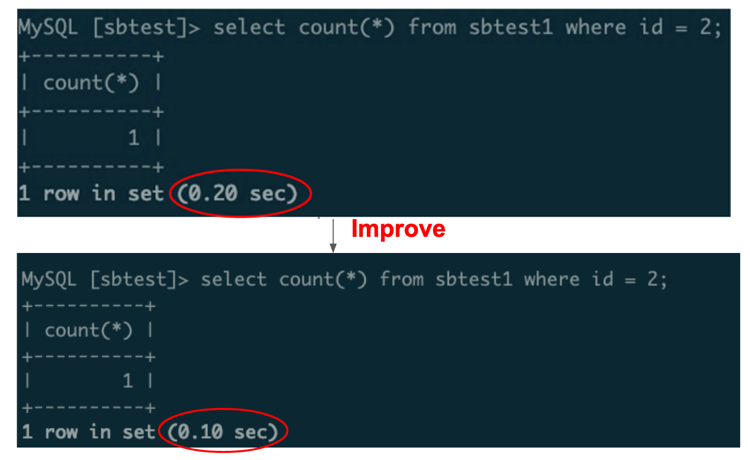

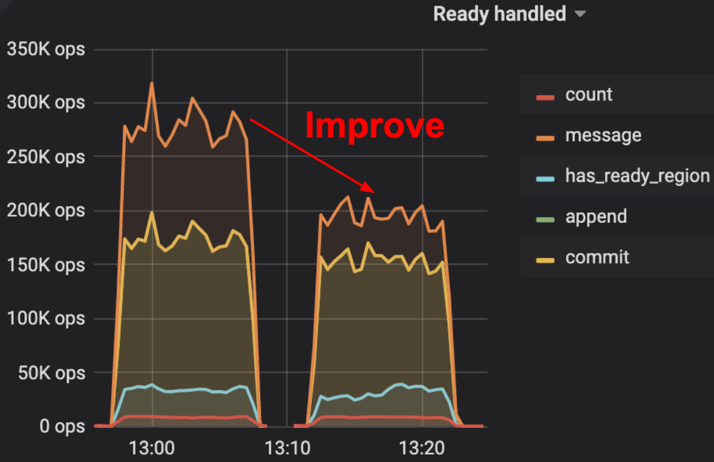

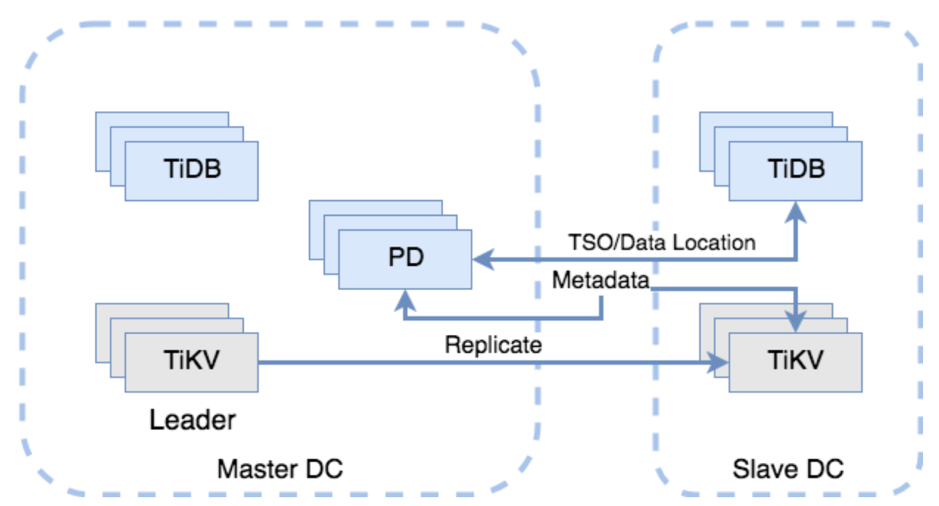

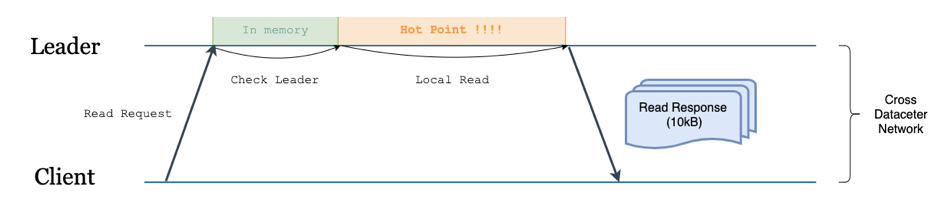

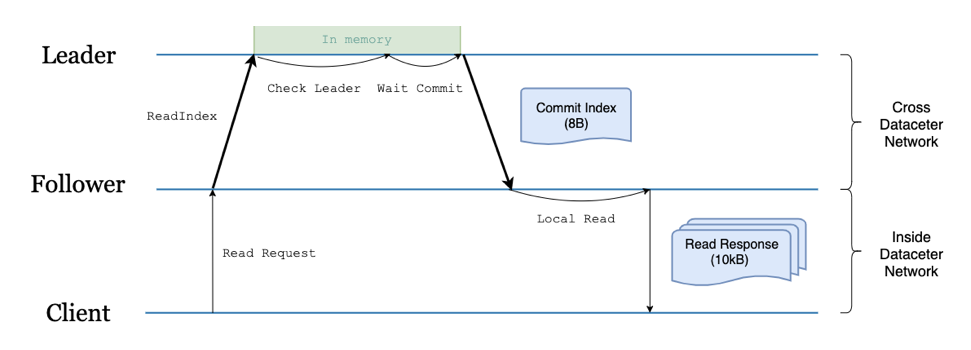

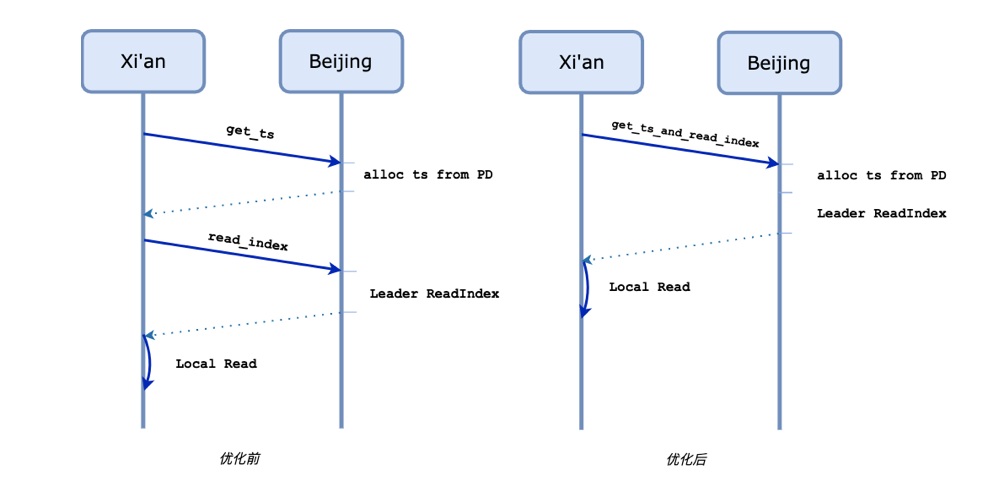

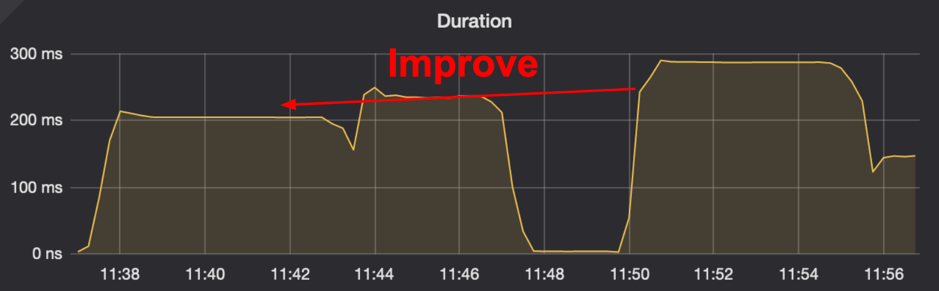

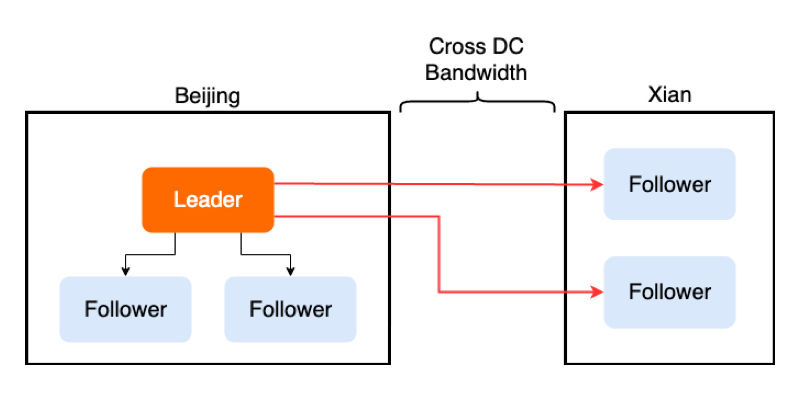

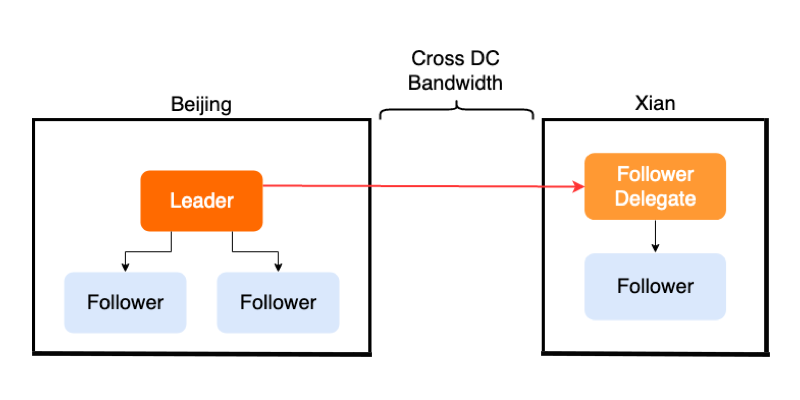

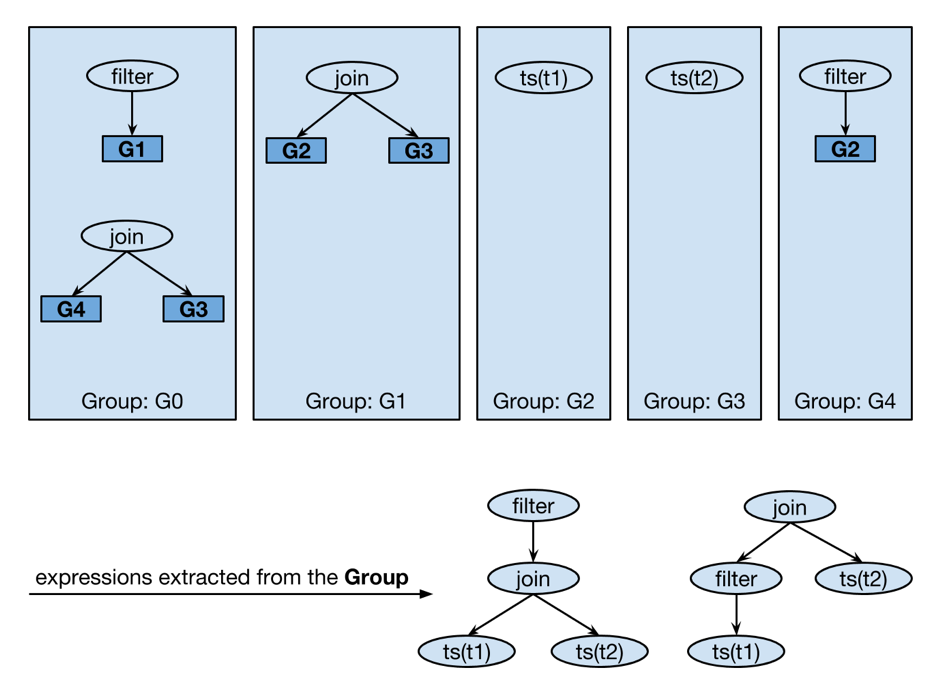

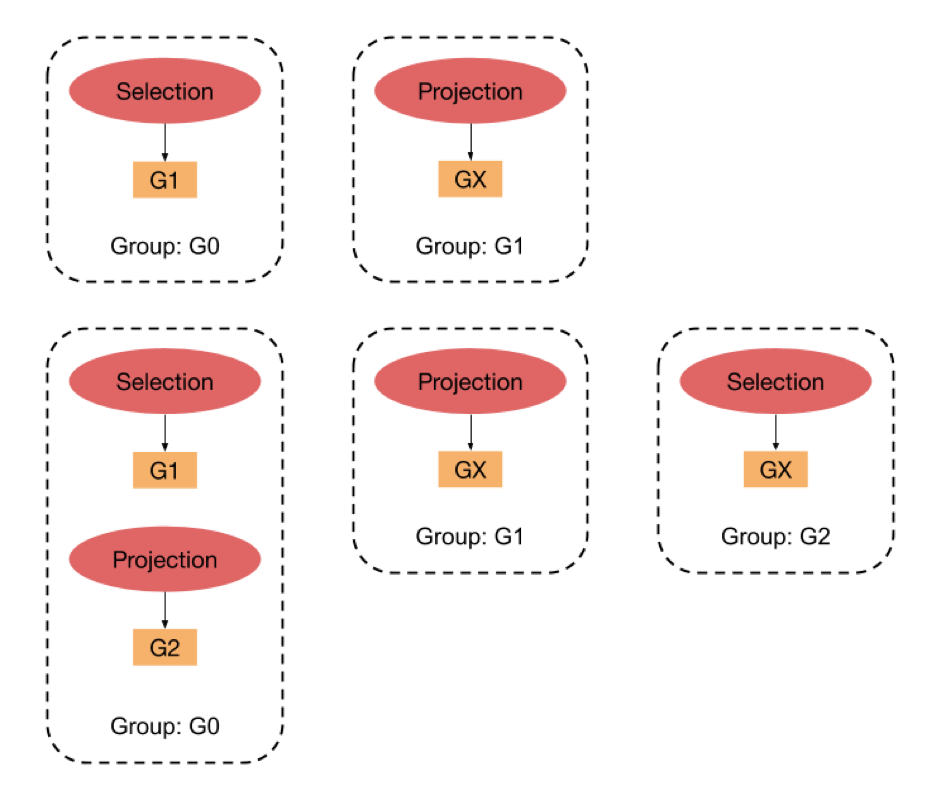

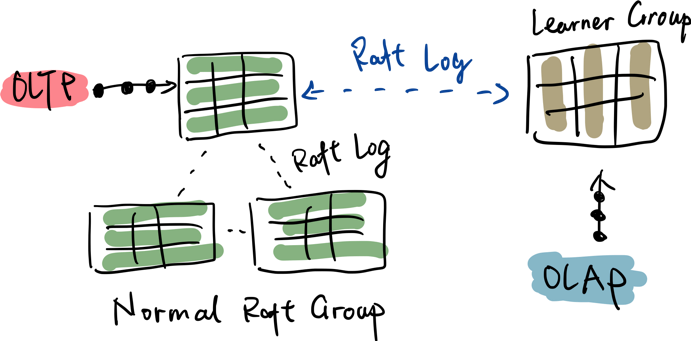

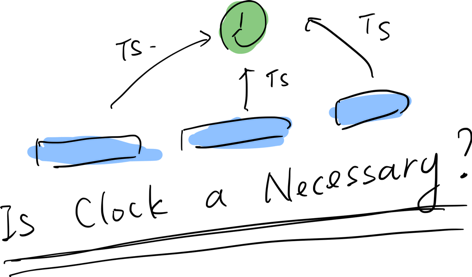

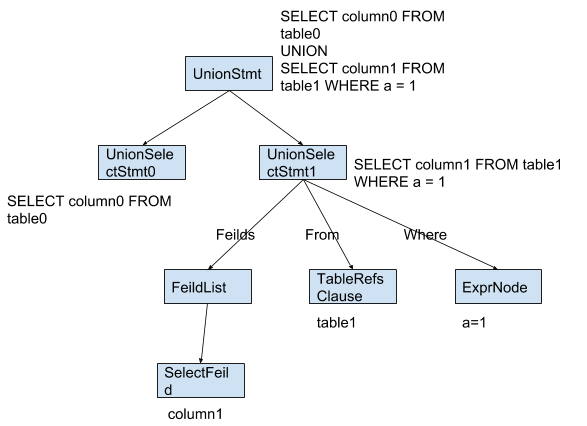

\n\n\n\n图 2 网络流量对比

\n\n>“Google Spanner 高性能事务和强一致特性(跨区域甚至跨洲),是每一个做多数据中心架构设计的工程师心中所向往的目标。虽然当前 TiDB 在多数据中心部署时的表现同 Google Spanner 还有明显的差距,但我们很高兴的看到“多数据中心读写优化”项目让 TiDB 向 Spanner 级别多数据中心能力迈出了坚实的一步。相信在社区小伙伴们的共同努力下,假以时日 TiDB 一定能够为大家带来 Google Spanner 级别的体验。”\n>\n>—— 孙晓光(知乎|技术平台负责人)\n>\n>“在官方推荐的具备同城多活能力的同城三中心五副本,以及两地三中心五副本的部署方案中,三个数据中心按照 2:2:1 的方式分配副本,网络租用成本是该架构的主要投入,我们在一次压力测试过程中,曾遇到过在极致的压力下占满网络带宽的情况。这个项目显著优化了两机房之间的带宽占用,可以为客户节约更多的成本。”\n>\n>—— 秦天爽(PingCAP|技术支持总监)\n\n接下来我们将从技术原理分析是如何做到以上优化效果的。以下内容需要读者具备 [Raft 一致性协议](https://raft.github.io/) 的一些预备知识,如果大家准备好了,就继续往下看吧~\n\n## 技术原理\n\n考虑一个两数据中心的部署方案(如图 3 所示),左半部分为主数据中心(Master DC,假设在北京)TiKV 和 PD 的多数副本都部署在这里,并且很重要的是 Leader 会被固定在这里;图 3 右半部分为从数据中心(Slave DC,假设在西安)里面有 TiKV 和 TiDB。用户只会在主数据中心进行数据写入,但会在两边都进行数据读取。\n\n\n\n图 3 主数据中心 & 从数据中心部署

\n\n### Follower Read Improvement\n\n在 TiDB 里面,当我们需要从西安这边读取数据的时候,一个典型的流程如下:\n\n1. 西安的 TiDB 向北京的 PD 发起获取 TSO 请求,得到一个 `start_ts`(事务开始阶段的 ID)。(1 RTT)\n\n2. 西安的 TiDB 为涉及到的每个 Region 向北京的 TiKV Leader 节点发起多个(并行)读请求(如图 4)。(1 RTT)\n\n>名词解释:\n>\n>* RTT(Round-Trip Time),可以简单理解为发送消息方从发送消息到得知消息到达所经过的时间。\n>* TSO(Timestamp Oracle),用于表示分布式事务开始阶段的 ID。\n\n\n\n图 4 不启用 Follower Read 的读流程

\n\n可以看到,虽然西安本地也有 TiKV 副本数据,但完全没有参与这个过程。该实现存在两个问题:\n\n* 跨地域网络宽带占用大。\n\n* 延迟高(2 RTT)。\n\n下面我们分别阐述对这两个问题的优化思路。\n\n#### 1. 跨地域网络宽带占用大\n\n其实针对这个问题,TiDB 已经在 3.1 版本引入了 [Follower Read](https://pingcap.com/blog-cn/follower-read-the-new-features-of-tidb/) 特性。开启该特性后,TiKV Leader 上的节点从必须处理整个读请求改为只用处理一次 read_index 请求(一次 read_index 通常只是位置信息的交互,不涉及数据,所以轻量很多),负载压力大幅降低,是一个很大的优化,如下图所示。\n\n\n\n图 5 开启 Follower Read 的读流程

\n\n#### 2. 延迟高\n\n在读延迟上,TiDB 仍然需要 2 个跨地域的 RTT。这两个 RTT 的延迟是由一次获取 TSO 请求和多次(并行的)`read_index` 带来的。简单观察后,我们不难发现,我们完全可以将上面两个操作并行一起处理,如下图所示。\n\n\n\n图 6 Follower Read 流程优化

\n\n通过这种优化方式,我们实现了跨数据中心读请求 2RTT -> 1RTT 的提升,并且我们在模拟的高延迟网络环境中的 benchmark 证实了这一点:\n\n\n\n图 7 benchmark

\n\n考虑到没有原子钟的情况下想要保证线性一致性,一次获取 TSO 的请求是无法避免的,因此可以认为 1RTT 已经是在目前的架构下最优的解决方案了。\n\n### 用 Follower Replication 减少带宽成本\n\n接下来谈一谈如何用 Follower Replication 这种方式,减少跨数据中心的带宽成本。\n\n众所周知 TiKV 集群中的一致性是依靠 Raft 协议来保证的。在 Raft 协议中,所需要被共识一致的数据可以用 Entry 来表示。一个 Entry 被共识,需要 Leader 在接收到请求之后,广播给其他 Follower 节点,之后通过不断的消息交互来使这个 Entry 被 commit。这里可能会遇到一个问题:有些时候 TiKV 被部署在世界各地不同的数据中心中,数据中心之间的网络传输成本和延迟比较高,然而 Leader 只有一个,可想而知会发生很多次跨数据中心的消息传输。\n\n举个例子,生产环境中可能需要 5 个副本来保证可用性,假设 3 个副本在北京分别是 A B C,2 个在西安分别是 D E,同时 Leader 为 A,那么一条 Entry 需要北京的 Leader A,广播给西安的 DE,那么这次广播至少需要两次跨数据中心的网络传输,如下图所示。\n\n\n\n图 8 正常的消息广播

\n\nFollower Replication 的目标是将这个多次的跨数据中心传输尽量减少。要实现 Follower Replication,最关键的是需要让 Leader 节点知道所有 Raft 节点与它所在的 数据中心的信息。这里我们引入了一个新概念 Group,每一个 Raft 节点都有一个对应的 Group ID,拥有相同 Group ID 的节点即在同一个数据中心中。既然有了每个 Raft 节点的 Group 信息,Leader 就可以在广播消息时在每一个 Group 中选择一个代理人节点(我们称为 Follower Delegate),将整个 Group 成员所需要的信息发给这个代理人,代理人负责将数据同步给 Group 内的其他成员,如下图所示。\n\n\n\n图 9 选择代理人之后的消息广播

\n\n通过使用 Follower Replication,Leader 减少了一半的数据发送,既大大降低了跨数据中心带宽的压力,同时也减少了 Leader 在发送网络消息上的开销。当然,实际 Follower Replication 的实现还是很复杂的,我们后续会专门写一篇详细的文章来介绍。\n\n关于这个对 Raft 实现的改进,我们已经提交了 RFC 和实现的 PR,后续也会贡献给 etcd,感兴趣的同学可以参考:\n\n* [https://github.com/tikv/rfcs/pull/33](https://github.com/tikv/rfcs/pull/33)\n\n* [https://github.com/tikv/raft-rs/pull/249/](https://github.com/tikv/raft-rs/pull/249/)\n\n* [https://github.com/etcd-io/etcd/issues/11357](https://github.com/etcd-io/etcd/issues/11357)\n\n## 总结\n\n除了我们在 Hackathon 做的两个优化,跨数据中心的场景有更多需要解决的问题和可以优化的点,我们的优化也远非最终实现,一些不难想到的优化还有:\n\n1. Follower Read Improvement 能将一个非交互式的读事务从 2RTT 降到 1RTT,但对于交互式的读事务,由于事先不知道涉及到事务的 Region,无法预读整个读请求中所有 Region `read_index`,因此只有第一次读请求和 `get_tso` 可以并行,将 n+1 RTT 优化到了 n RTT(n 为交互式事务中读语句的数量),而如果我们能将 ts 和 committed index 的对应关系找到,并且定期维护每个 Region 的 safe ts(小于该 ts 的事务一定已经 committed or aborted),那么我们就可以将交互式读事务的延迟也降低到 1RTT。\n\n2. 跨数据中心的读请求一个很常见的场景是并不需要是最新的数据,应该提供怎么样的语义来让这种场景下的读请求完全在本地 0RTT 地读取数据,真正做到对主数据中心无依赖,做到数据中心级别的 scalability。\n\n有句话是这样说的,“对于基础架构方向的软硬件工程师而言,世界上最远的距离,是你在联通,我在电信 :D”软件工程师做得越好,秃顶的硬件工程师就越少。希望我们的项目在切实落地之后,能够大幅优化 TiDB 跨地域数据中心的延迟和网络流量,让 TiDB 能够满足更多用户的需求,成为分布式数据库领域的事实标准。","date":"2019-11-29","author":".* team","fillInMethod":"writeDirectly","customUrl":"geographic-data-distribution-traffic-and-latency-halved","file":null,"relatedBlogs":[]},{"id":"Blogs_144","title":"TiKV Engine SIG 成立,硬核玩家们看过来!","tags":["TiKV","社区","存储引擎"],"category":{"name":"社区动态"},"summary":"TiKV Engine SIG 主要职责是对 TiKV 的存储引擎的未来发展进行讨论和规划,并进行相关开发和维护。期待社区伙伴们的支持和贡献~","body":"TiKV 是一个开源项目,我们一直都欢迎和感激开源社区对 TiKV 所作出的贡献。但我们之前对开源社区的合作主要是在代码审阅和散落在各种社交媒体的线下讨论,开发者并没有合适的途径去了解和影响 TiKV 的开发计划。怎么才能更好的帮助大家找到组织,更好地参与到 TiKV 的开发中来呢?我们的设想是搭建公开的平台,邀请对 TiKV 中特定领域感兴趣的开发者加入其中,与我们一起探讨和推进相应工作。Special Interest Group(SIG)就是这样的平台。\n\nTiKV Engine SIG 是继 [Coprocessor SIG](https://pingcap.com/blog-cn/tikv-coprocessor-sig/) 之后成立的第二个 TiKV SIG 社区组织,主要职责是对 TiKV 的存储引擎的未来发展进行讨论和规划,并进行相关开发和维护。\n\n目前 TiKV 仅支持默认存储引擎 RocksDB,但是通过扩展接口,希望未来 TiKV 可以支持更多的存储引擎,我们也期待这部分工作可以得到社区的支持,在社区的讨论和贡献中得到更好的完善。此外,Engine SIG 也会对已有的存储引擎进行相关的开发和完善工作。\n\nEngine SIG 的工作主要涉及的模块包括:\n\n* Engine Trait: TiKV 中存储引擎的抽象层。\n* RocksDB:包括维护 TiKV 所使用的 RocksDB 分支,以及 rust-rocksdb 封装。\n* Titan:提供 KV 分离支持的 RocksDB 存储引擎插件。\n* 未来 TiKV 对其它存储引擎的支持。\n\n## 如何加入 Engine SIG\n\n无论你是数据库开发新手,希望通过实战了解存储开发相关知识;还是 TiKV 资深用户,希望扩展 TiKV 的能力以应用到生产环境,Engine SIG 都欢迎你的加入!\n\n有兴趣的开发者可以浏览 Engine SIG 文档并加入 Engine SIG 的 Slack 频道。Engine SIG 希望能够帮助 Contributor 逐渐成长为 Reviewer,Committer 乃至 TiKV 的 Maintaner。\n\n* Engine SIG 主页:[https://github.com/tikv/community/tree/master/sig/engine](https://github.com/tikv/community/tree/master/sig/engine)\n\n* Engine SIG 章程:[https://github.com/tikv/community/blob/master/sig/engine/constitution-zh_CN.md](https://github.com/tikv/community/blob/master/sig/engine/constitution-zh_CN.md)\n\n* Engine SIG Slack:加入 tikv-wg.slack.com 并进入 [#engine-sig](https://tikv-wg.slack.com/?redir=%2Fmessages%2Fengine-sig) 频道。\n\n## 近期工作计划\n\n近期 Engine SIG 工作会围绕在对 TiKV 已有存储引擎的改进上面,但我们会尽量选取一些对以后引入其它存储引擎也有意义的工作。具体有以下几方面:\n\n* 使用 [Bindgen](https://rust-lang.github.io/rust-bindgen/) 对 [rust-rocksdb](https://github.com/tikv/rust-rocksdb) 进行重构,减少新增存储引擎接口的开发复杂度。\n* 扩展 [failpoint](https://pingcap.com/blog-cn/tikv-source-code-reading-5/) 接口,允许为不同的存储引擎开发相应的插件,使得 TiKV 测试能够对存储引擎内部进行错误注入。\n* [Titan](https://github.com/pingcap/titan) 存储引擎插件的性能和功能的改进。\n\n详细任务列表见:[https://github.com/tikv/tikv/projects/22](https://github.com/tikv/tikv/projects/22)。\n\n## 未来工作计划\n\n未来 Engine SIG 会更多关注于为 TiKV 引入新的存储引擎。这上面可以做的工作很多。比如说,我们可以考虑为 TiKV 引入针对不同硬件(纯内存、持久化内存、云盘等)的存储引擎,不同数据结构的存储引擎(B-Tree 引擎等),针对特殊场景的存储引擎(全文搜索等),或者单纯是不一样的存储引擎实现(LevelDB 等)。这些工作非常需要社区的参与。我们希望这些工作未来能够扩展 TiKV 的领域和可能。目前 TiKV 正在加紧对存储引擎抽象 Engine Trait 进行开发,使以上的设想成为可能。\n\n期待社区伙伴们的加入!欢迎在 Slack [#engine-sig](https://tikv-wg.slack.com/?redir=%2Fmessages%2Fengine-sig) 中与我们交流!如果对于流程或技术细节有任何疑问,都可在 channel 中讨论~","date":"2019-11-28","author":"Yi Wu","fillInMethod":"writeDirectly","customUrl":"tikv-engine-sig-introduction","file":null,"relatedBlogs":[]},{"id":"Blogs_149","title":"开源社区怎么玩?明星项目 TiKV 的 Maintainer 这样说……","tags":["社区","社区动态"],"category":{"name":"社区动态"},"summary":"“当你持续的认真投入到开源后,项目和社区就会产生双向的交流,不再只是你单向的投入,社区也会给予你反哺,这时就会形成正向循环,对项目发展会起到非常大的推动作用。”","body":"知乎技术平台团队负责人孙晓光有一个新的身份:开源分布式事务 Key-Value 数据库 TiKV项目的 Maintainer。Maintainer 是 TiDB/TiKV 开源社区的角色之一,是社区中较高级别的代码贡献者,项目的规划和设计者,拥有合并主干分支的权限。一般来说从开始贡献代码的 Contributor 成长为 Maintainer,最明显的变化是,对项目有更全局、深入的了解,对项目未来的发展也有独到、准确的见解。\n\n孙晓光觉得,其实从 Contributor 到 Committer 再到最后成为 Maintainer 这个过程,最大的感受是自己逐渐融入到了 TiKV 社区中,真正有了归属感。今天我们就带着 TiDB/TiKV 社区伙伴们的期待,和孙晓光聊了聊,打探了一下他成为 Maintainer 的经历,以及对 TiKV 社区未来的想法。\n\n## 初识:寻找原生的分布式存储方案\n\n***> 与 TiKV 项目初识,其实是带着明确的目标的。***\n\n孙晓光 2007 年毕业回国,当时国内刚开始做云,他进入一家做私有云的公司,从事私有云相关产品开发工作 7 年多时间,他坦言,这段工作经历让他个人积累了许多云相关底层系统的工作经验,这也是他对平台类技术比较感兴趣的核心原因。2017 年孙晓光加入知乎。\n刚到知乎时,他负责已读服务的开发,知乎的存储层采用的还是 MySQL 分库分表技术方案。“项目上线后,就我个人而言是难以接受这种方案的,于是我就开始寻找原生的分布式存储系统来替代它。借此机会我尝试了 TiKV,在测试的过程中我发现一些性能有改善的空间,于是我就边测试边上手做了一些优化工作,最后提了一个大 PR 上去。PR 提出后,PingCAP 首席架构师唐刘很快就跟我建立了联系,慢慢的我也进入到了 TiKV 社区当中。这就是我第一次接触 TiKV 的经历。”\n\n## 更加理解「开源社区」\n\n\n***> 我对开源社区的理解更加清晰了。***\n\n孙晓光以前也用过很多开源软件,但是当时并没有深刻理解开源的价值。**开源的第一目标应该是对别人有帮助、有价值,这个目标就已经拦住了无数的开源项目**。很多项目仅仅把代码开放出来,但是没有任何后续的支持与维护,在这样的情况下社区是无法发展的,自然也难以为他人创造价值。\n\n\n\n“**其实当你持续的认真投入到开源后,项目和社区就会产生双向的交流,不再只是你单向的投入,社区也会给予你反哺,这时就会形成正向循环,对项目发展会起到非常大的推动作用**。我对开源的理解正是在 TiKV 社区慢慢建立起来的,TiKV 有一个非常开放友好的社区,PingCAP 和社区伙伴们热心的帮助及鼓励让我切身感受到活跃的开源社区所具有的独特魅力。在参与共建社区的过程中,我不但学习到了如何同开源社区中众多优秀的贡献者更加高效的交流,同时也对开源的价值理念和开源在基础软件领域的重大意义有了更加深入的理解。”\n\n## 「持续贡献,长期活跃」的动力何在?\n\n***> 硬核的项目 + 开放的氛围***\n\n过去多年在云方向的工作经历让孙晓光坚定的相信,云是未来的趋势,而 TiKV 作为云原生架构中承载状态的基石组件,它的重要程度毋庸置疑。作为一个技术控,TiKV 这样一个既硬核口碑又很好的项目很自然地吸引着他。同时 TiKV 社区互帮互助、开放共赢的良好氛围也是孙晓光持续参与社区建设的重要动力。\n\n“之前也为其他开源项目做过贡献,可能是这些项目对社区建设并没有投入太多精力,大部分的 PR 合并完成就没有后续了。但是在 TiKV 社区,我感受到当我参与社区后,后续会有很多追踪的动作,这会激励我保持兴趣,持续在社区中去做贡献。同时在这个过程中,我也在社区中学习了很多知识,得到了很多帮助,这也是我长期坚持在 TiKV 社区中保持活跃的一个重要原因。”\n\n迄今为止,孙晓光已经为 TiDB/TiKV 项目贡献了 18 个 PR,[推动了 TiKV 重要功能 Follower Read 的开发和落地](https://pingcap.com/blog-cn/zhihu-the-story-of-contributing-to-tidb-community/),这个功能同时也解决了知乎业务场景中极端热点数据访问的吞吐问题。他在一年中完成了 Contributor -> Committer -> Maitainer 的角色升级,可谓是开挂式的速度,但他并没有就此止步,而是开启了一个新的挑战。\n\n## 新的挑战\n\n今天 TiKV Engine SIG(SIG = Special Interest Group)正式成立,这是 TiKV 项目成立的第二个 SIG 社区组织,孙晓光将作为第一个非 PingCAP 的 SIG TechLead,将与其他 TechLead 一起,组织大家推动 TiKV Engine 的相关开发和完善。\n\n对于 TiKV Engine SIG,孙晓光非常兴奋。\n\n“我认为 TiKV 非常适合 SIG 这个模式,因为 TiKV 是一个非常庞大且复杂的系统,进入的门槛很高,并且它还在以飞快的速度继续演进着。在这样一个庞大的系统里,想让大家参与进来其实是非常有难度的。**但 SIG 可以为大家创造一个更容易参与的小环境,且在这个小环境中是有组织有领导的,有人会帮助大家指方向,指导大家要做什么样的事情,这样一方面降低社区参与 TiKV 建设的门槛,另外一方面也可以更好的将对特定领域有经验且感兴趣的伙伴们聚集起来,高效的推进 TiKV 每一个关键方向的前进速度。**\n\n在我个人看来,存储引擎是 TiKV 中最关键的组件之一,它影响着整个系统的稳定性、功能特性以及性能表现。相信 Engine SIG 成立后,我们可以清晰的定义存储引擎同 TiKV 其它部分的契约,提供强大且易用的存储引擎抽象,借助 TiKV 完备的分布式能力,我们可以为 TiKV 拓展更多的领域和可能。”\n\nTiKV Engine SIG 是主要职责是对 TiKV 的存储引擎的未来发展进行讨论和规划,并进行相关开发和维护。目前 TiKV 仅支持默认存储引擎 RocksDB,但是通过扩展接口,希望未来 TiKV 可以支持更多的存储引擎。近期 Engine SIG 的工作会围绕在对 TiKV 已有存储引擎的改进上面。\n\n>*关于 TiKV Engine SIG 的更多信息,感兴趣的朋友们可以查看 [这篇文章](https://pingcap.com/blog-cn/tikv-engine-sig-introduction),也可以加入 Slack [#engine-sig](https://tikv-wg.slack.com/?redir=%2Fmessages%2Fengine-sig\n) 和孙晓光等社区伙伴们一起讨论。*\n\n## 期望\n\n作为 TiKV & TiDB 重度粉丝,孙晓光希望在未来能更好的促进「知乎」和 TiKV 社区的共建。一方面依托 TiKV 社区的进步为「知乎」的业务发展提供更好的支撑基础,同时希望能够基于「知乎」的业务场景为 TiKV 的发展提供足够大的施展空间。\n\n“我非常希望我们的团队也能够真正参与进来,成为社区的贡献者。相信未来 TiKV 能够保持开放共赢的风格,建设更成熟更大规模的社区。我们这些社区伙伴会一起推动 TiKV 的高速持续发展,让 TiKV 成为未来有状态系统基石的第一选择。” \n\n\n>\n>\n>TiKV 是一个开源的分布式事务 Key-Value 数据库,支持跨行 ACID 事务,同时实现了自动水平伸缩、数据强一致性、跨数据中心高可用和云原生等重要特性。作为一个基础组件,TiKV 可作为构建其它系统的基石。目前,TiKV 已用于支持分布式 HTAP 数据库—— TiDB 中,负责存储数据,并已被多个行业的领先企业应用在实际生产环境。2019 年 5 月,CNCF 的 TOC(技术监督委员会)投票决定接受 TiKV 晋级为孵化项目。\n>\n>源码地址:https://github.com/tikv/tikv\n>\n>更多信息:https://tikv.org","date":"2019-11-28","author":"PingCAP","fillInMethod":"writeDirectly","customUrl":"tikv-maintainer-sunxiaoguang","file":null,"relatedBlogs":[]},{"id":"Blogs_28","title":"十分钟成为 Contributor 系列 | 为 Cascades Planner 添加优化规则","tags":["TiDB","社区","Contributor","优化器"],"category":{"name":"社区动态"},"summary":"我们将这个系列再向着数据库的核心前进一步,挑战一下「为 TiDB 的优化器增加优化规则」,带大家初步体验一下可以对查询的执行时间产生数量级影响的优化器的魅力。","body":"到今天为止,“成为 Contributor 系列”已经推出了 “[支持 AST 还原为 SQL](https://pingcap.com/blog-cn/support-ast-restore-to-sql-text/)”,“[为 TiKV 添加 built-in 函数](https://pingcap.com/blog-cn/30mins-become-contributor-of-tikv/)”,“[向量化表达式](https://pingcap.com/blog-cn/10mins-become-contributor-of-tidb-20190916/)”等一列活动。**这一次借着 TiDB 优化器重构的契机,我们将这个系列再向着数据库的核心前进一步,挑战一下「为 TiDB 的优化器增加优化规则」,带大家初步体验一下可以对查询的执行时间产生数量级影响的优化器的魅力。**\n\n众所周知优化器是数据库的核心组件,需要在合理的时间内寻找到一个合理的执行计划,确保查询可以稳定快速地返回正确的结果。最初的优化器只有一些启发式的优化规则,随着数据量和业务的变化,业界设计出了 System R 优化器框架来处理越来越多的复杂 SQL 查询。它将查询优化分为逻辑优化和物理优化两个阶段,逻辑优化根据规则对执行计划做等价变形,物理优化则根据统计信息和代价计算将逻辑执行计划转化为能更快执行的物理计划。目前 TiDB 优化器采用的也是该优化器模型。\n\n虽然 System R 优化器框架大大提升了数据库处理复杂 SQL 的能力,但也存在一定缺陷,比如:\n\n1. 扩展性不好。每次添加优化规则都需要考虑新的规则和老的规则之间的关系,需要对优化器非常了解的同学才能准确判断出新的优化规则应该处在什么位置比较好。另外每个优化规则都需要完整的遍历整个逻辑执行计划,添加优化规则的心智负担和知识门槛非常高。\n\n2. 搜索空间有限。搜索空间一方面因为优化规则难以添加导致比较狭小,另一方面,逻辑优化要求该优化规则一定在各个场景下都有收益才行,但在数据库面临的各种场景中,总有一些优化规则在某种数据分布下有收益,在另一种数据分布下没有收益,需要根据数据的分布估算代价来判断是否启用这些优化规则,因为这个原因,进一步导致一些优化规则不能添加到这个搜索框架中,或者添加后需要人工的通过开关来开启或关闭该优化规则。\n\n为了解决上面的问题,更方便地添加优化规则,扩展优化器搜索空间,寻找更优的执行计划,我们基于 Cascades 优化器模型重新写了一个新的优化器,名字就叫 Cascades Planner。在这个优化器框架下,添加优化规则变得异常简单:\n\n1. 不用考虑优化规则之间的顺序关系,规则和规则之间完全解耦。\n\n2. 只针对特定的模式添加优化规则,不再需要遍历整个逻辑执行计划,不用熟知所有逻辑算子的功能,极大的降低了优化器的开发门槛。\n\n在这篇文章中,我们主要聚焦在一条优化规则是如何工作以及如何给新优化器添加规则上,先让大家对这个优化器有一个直观的感受——“优化器没什么难的,不过如此”。下一篇文章,我们将更加详细的介绍 TiDB Cascades Planner 的原理和框架,供感兴趣的同学深入研究,如果大家等不及的话,可以先阅读下面的参考文献,提前了解一下 Cascades 优化器模型:\n\n1. [The Cascades Framework for Query Optimization](https://15721.courses.cs.cmu.edu/spring2018/papers/15-optimizer1/graefe-ieee1995.pdf)\n\n2. [Orca: A Modular Query Optimizer Architecture for Big Data](https://15721.courses.cs.cmu.edu/spring2016/papers/p337-soliman.pdf)\n\n3. [CMU SCS 15-721 (Spring 2019) : Optimizer Implementation (Part II)](https://15721.courses.cs.cmu.edu/spring2019/slides/23-optimizer2.pdf)\n\n## Cascades 优化器简介\n\nCascades 优化器是 Goetz Graefe 在 [volcano optimizer generator](https://cs.uwaterloo.ca/~david/cs848/volcano.pdf) 的基础上优化调整之后诞生的一个搜索框架。这个框架有如下一些概念:\n\n* Expression:原论文中,Expression 用来指代包括 Plan 节点(也就是大家常说的的 SQL 算子)以及各种函数表达式(例如 MySQL 支持的 200 多个内置函数)在内的所有表达式。在 TiDB 现有框架实现中,只将 Plan 节点视作 Expression。Expression 大多会包含子节点,但每个子节点并不是一个 Expression ,而是一组等价的 Expression 集合,也就是接下来要介绍的 Group。\n\n* Group:表示等价 Expression 的集合,即同一个 Group 中的 Expression 在逻辑上等价。Expression 的每个子节点都是以一个 Group 表示的。在下文图例中,Group `G0` 中包含谓词下推前后的两个等价 Expression。\n\n* Transformation Rule:是作用于 Expression 和 Group 上的等价变化规则,用来扩大优化器搜索空间,也是本次要重点介绍的模块。下图 Group `G0` 中的第二组 `Expression` 便是第一组 `Expression` 经过了一个谓词条件(Filter)下推过连接(Join)的 Transformation Rule 之后新产生的 `Expression`。\n\n* Pattern:描述一个执行计划的片段,注意这个 “片段” 不是 “子树”。这个片段可以是执行计划算子树中任意一段。每一个 Transformation Rule 都拥有自己的 Pattern,表示该 Rule 只作用于满足这个 Pattern 的 Expression。\n\n* Implementation Rule:将一个逻辑算子转换成物理算子的规则。如一个 Join 可以被转换成 HashJoin、MergeJoin、IndexNestedLoopJoin 等。每一个转换都由一个对应的 Implementation Rule 完成。\n\n以查询 `select * from t1 join t2 on t1.a = t2.a where t1.b > 1` 为例,在经过 Cascades 优化器的谓词下推这一 Transformation Rule 后,搜索空间中的 Group 和 Expression 会是如下:\n\n\n\n目前 TiDB 中 Cascades 优化器的搜索过程大致如下:\n\n1. 首先将抽象语法树(AST)转换为初始的逻辑执行计划,也就是由 LogicalPlan 所表示的算子树。\n\n2. Cascades Planner 将这棵初始的 LogicalPlan 树等价地拆分到 `Group` 和 `GroupExpr` (Expression 在代码中对应的具体数据结构) 中,这样我们便得到了 Cascades Planner 优化器的初始输入。\n\n3. Cascades Planner 将搜索的过程分为了两个阶段,第一阶段是 Exploration ,该阶段不停地遍历整个 Group ,应用所有可行的 Transformation Rule,产生新的 Group 和 GroupExpr ,不停迭代直到没有新的 GroupExpr 诞生为止。\n\n4. 在第二个阶段 Implementation 中,Cascades Planner 通过对 GroupExpr 应用对应的 Implementation Rule,为每一个 Group 搜索满足要求的最佳(Cost 最低)物理执行计划。\n\n5. 第二阶段结束后,Cascades Planner 将生成一个最终的物理执行计划,优化过程到此结束,物理执行计划交给 TiDB 执行引擎模块继续处理。\n\n## 一条优化规则如何工作\n\n目前所有的 Transformation Rule 的实现代码都放在 `planner/cascades/transformation_rules.go` 文件中。我们以 `PushSelDownProjection` 为例,来简单介绍一条 Transformation Rule 的工作流程。\n\nTransformation Rule 是一个 interface,该接口的定义如下(省去注释部分):\n\n```\ntype Transformation interface {\n\tGetPattern() *memo.Pattern\n\tMatch(expr *memo.ExprIter) bool\n\tOnTransform(old *memo.ExprIter) (newExprs []*memo.GroupExpr, eraseOld bool, eraseAll bool, err error)\n}\n```\n\n在 Cascades 中,每个 rule 都会匹配一个局部的 Expression 子树,这里的 `GetPattern()` 就是返回这个 rule 所要匹配的 Pattern。Pattern 的具体结构如下(省去注释部分):\n\n```\ntype Pattern struct {\n\tOperand\n\tEngineTypeSet\n\tChildren []*Pattern\n}\n```\n\n这里需要提一下的是 `EngineTypeSet` 这个参数,因为有的算子比如 Selection ,既可以在 TiDB 执行,也可以在 TiKV 或者 TiFlash(一个列存引擎,目前尚未开源)Coprocessor 上执行。为了处理只在特定执行引擎上生效的规则,我们引入了这个参数。\n\nPattern 的构造可以借助 `BuildPattern()` 以及 `NewPattern()` 来完成。对于 `PushSelDownProjection` 这个规则来说,它起作用的执行计划 Pattern 是 `Projection -> Selection`。\n\n```\nfunc (r *PushSelDownProjection) GetPattern() *memo.Pattern {\n\treturn memo.BuildPattern(\n\t\tmemo.OperandSelection,\n\t\tmemo.EngineTiDBOnly,\n\t\tmemo.NewPattern(memo.OperandProjection, memo.EngineTiDBOnly),\n\t)\n}\n```\n\n`Match()` 函数是在命中 Pattern 后再做的一些更具体的判断,因为 Pattern 只包含了算子类型和算子树的结构信息。这时比如有一个 Rule 只对 inner join 生效,Pattern 只能判断到算子是 Join,要进一步判断它是否是 inner join 就需要依靠 `Match()` 函数了。对于大部分简单的 Transformation Rule,所以 `Match()` 函数只需要简单地返回 `true` 就行了。\n\n`OnTransform()` 函数是规则的主要逻辑所在,在函数内部我们会创造新的 Expression 并返回合适的 `eraseOld` 以及 `eraseAll` 的值。举例来说,谓词下推会让计算尽可能提前,减少后续计算量,因此新生成地 Expression 一定是更好的选择,这时 `eraseOld` 就可以返回 `true `。类似地,当一个 rule 返回的 Expression 一定比其他所有选择都更好时,比如某一个优化规则发现 `a > 1 and a < 1` 恒为假后,判断查询一定不会有结果产生所以生成了 `TableDual` 的新 Expression ,这时就可以让 `eraseAll` 返回 `true` 让优化器将同 Group 内的其他 Expression 全部清空。\n\n`PushSelDownProjection` 的 `OnTransform()` 的行为如下图所示,简单来说:\n\n\n\n1. 在初始时只有 `G0` 和 `G1` 两个相关的 Group。\n\n2. 这个优化规则会将 `Selection` 推到 `Projection` 下面去,产生新的 Group `G2`,同时在 `G0` 中新增了 `Projection->G2` 的 `GroupExpr`。\n\n\n## 如何添加一个 Transformation Rule\n\n添加一个 Transformation Rule 简单来说就是编写一个新的结构体,实现 `Transformation` 这个 interface 的三个接口。Cascades 架构的优势就是它做了足够的抽象,让添加 Rule 的工作不需要考虑太多繁杂的事情。如果你在添加 Rule 时觉得有些地方写起来不是那么顺手,可以立刻停下手中的键盘来 [#sig-planner](https://tidbcommunity.slack.com/messages/sig-planner) 中和我们做一些讨论。\n\n当然这里还是要列出一些注意事项方便大家在添加 Transformation Rule 时不走歪路:\n\n* `OnTransform()` 的函数头以及函数过程中添加充足的注释,说明自己的 Rule 做了一个什么样的变换,方便他人在读到这个 Rule 的代码时,能快速明白这个 Rule 做了哪些工作。\n\n* `OnTransform()` 函数中不要对原有的 Expression 做任何修改,因为原有 Expression 可能之后会继续触发其他的行为,如果做了修改,那么在下一次触发规则时,就可能产生一些意想不到的化学反应。\n\n* 要在 `defaultTransformationRuleMap` 中注册这个 Rule,这个 Map 是 TiDB 目前默认的 `RuleSet`。使用 `RuleSet` 的好处很多,比如针对 TP 和 AP 查询使用不同的 Rule 集合,使得优化器在处理 TP 查询时能快速做出不差的执行计划,在处理 AP 查询时多应用一些优化规则做出执行时间更短的执行计划等。\n\n* 单元测试必不可少。目前,Transformation Rule 的测试在 `transformation_rules_test.go` 中。测试函数的编写可以参考文件下的其他函数,主要是以跑一个完整的 SQL 进行测试。为了减轻修改测试输出的工作量,我们将测试输入输出单独记录在文件中,并可以通过命令行快捷更新输出。在添加了测试函数后,需要修改 testdata 目录下的 `transformation_rules_suite_in.json` 文件添加测试的输入,然后用 `go test github.com/pingcap/tidb/planner/cascades --record` 即可生成对应的 `xxx_out.json` 文件。记得要检查测试的输出是否符合预期,确保测试结果是自己想要的等价变换。\n\n* 目前 Cascades 优化器仍在早期阶段,偶尔会有一些框架性的改动可能会制造一些需要解决的代码冲突,还请大家理解。\n\n## 如何成为 Contributor\n\n为了方便和社区讨论 Planner 相关事情,我们在 [TiDB Community Slack](https://pingcap.com/tidbslack/) 中创建了[#sig-planner](https://tidbcommunity.slack.com/messages/sig-planner) 供大家交流讨论,之后还将成立优化器的专项兴趣小组,不设门槛,欢迎感兴趣的同学加入。大家在添加规则时遇到一些问题时,可以毫不犹豫的来 channel 里和我们吐槽~\n\n**参与流程:**\n\n1. 在 [Cascades Tracking Issue](https://github.com/pingcap/tidb/issues/13709) 中 `porting the existing rules in the old planner` 选择感兴趣的函数并告诉大家你会完成它。\n\n2. 添加一个 rule 并为其增加单元测试。\n\n3. 运行 `make dev`,保证所有 test 都能通过。\n\n4. 发起 Pull Request 并完成 merge 到主分支。\n\n如果你有任何疑问,也欢迎到 [#sig-planner](https://tidbcommunity.slack.com/messages/sig-planner) 中提问和讨论。 \n> 点击查看更多 [成为 Contributor 系列文章](https://pingcap.com/zh/blog/?tag=Contributor)","date":"2019-11-26","author":"崔一丁","fillInMethod":"writeDirectly","customUrl":"10mins-become-contributor-20191126","file":null,"relatedBlogs":[]},{"id":"Blogs_273","title":"Unified Thread Pool | TiDB Hackathon 2019 优秀项目介绍","tags":["TiKV","社区","Hackathon"],"category":{"name":"社区动态"},"summary":"Unified Thread Pool 项目实现了在 TiKV 中使用一个统一的自适应线程池处理读请求,能够显著提升性能,并可预测性地限制大查询对小请求的干扰,最终在 TiDB Hackathon 2019 中斩获一等奖。","body":">本文由逊馁队的成员夏锐航同学主笔,介绍 Unified Thread Pool 项目的设计与实现过程。该项目实现了在 TiKV 中使用一个统一的自适应线程池处理读请求,能够显著提升性能,并可预测性地限制大查询对小请求的干扰,最终在 [TiDB Hackathon 2019](https://mp.weixin.qq.com/s?__biz=MzI3NDIxNTQyOQ==&mid=2247490046&idx=1&sn=962bb8aa4619c3815fcc561ed96331d7&chksm=eb163e94dc61b7826b7e73a057f4c9823261c1a79005104dd41dbd6ef4276c01bd6e41a69d14&scene=21&token=1896003006&lang=zh_CN#wechat_redirect) 中斩获一等奖。\n\n距离 TiDB Hackathon 落幕已经过去了半个多月,回忆这次比赛、获奖的经历,依然让我感到非常兴奋。我目前是华南理工大学大三的学生,我和正在 PingCAP 实习的学长奕霖一起组队参加了这次 TiDB Hackathon,比赛的主题为 “Improve”,即提升 TiDB 及相关项目的性能、易用性等。我们项目设计的切入点是: \n\n* TiKV 现有的线程池在大小查询混合场景下的表现不太优秀。\n\n* 需要针对不同的环境、场景配置线程池数量,使用和学习成本较高。\n\n于是我和奕霖尝试为 TiKV 重新实现一个线程池来解决这个问题,以达到 Improve 整体表现的效果。除了优化读请求的线程池外,我们计划将这个线程池来代替 TiKV 中其他线程池,最后就产生了我们本次的参赛作品 Unified Thread Pool。\n\n## 项目设计\n\n在 TiKV 现行的线程池方案中有 Coprocessor、Storage 和 Scheduler 三套线程池。这些线程池原本是设计来分隔不同的任务,减少它们之间的相互影响。这种方式简单粗暴,缺点也很明显,如:\n\n* 由于多个线程池共存,每个线程池都被限制至无法使用系统的全部资源。\n\n* 每套任务中又对应二至三个不同优先级的线程池,但是从实际效果来讲这个隔离也没能很好的发挥用处。\n\n* 在目前的 TiKV 中需要对每个线程池单独配置,如 [Scheduler](https://pingcap.com/docs-cn/v3.0/reference/configuration/tikv-server/configuration-file/#scheduler-worker-pool-size)、[Storage](https://pingcap.com/docs-cn/v3.0/reference/configuration/tikv-server/configuration-file/#readpoolstorage)、[Coprocessor](https://pingcap.com/docs-cn/v3.0/reference/configuration/tikv-server/configuration-file/#readpoolcoprocessor)。\n\n我们的 Unified Thread Pool 是一个在用户态模拟多级反馈队列调度的线程池,能较好的解决上述现行线程池方案的几个缺点。两者具体的对比如下表所示:\n\n| 现行线程池方案 | 我们的改进 |\n|:--------|:--------| \n| 多个线程池共存,每个线程池都不能分配所有的资源 | 一个统一的线程池,可以分配尽量多的资源|\n| 通过分配到不同的线程池来实现优先级,但效果不佳 | 内部实现按时间的调度 |\n| 大请求对小请求的影响不可控 | 可预测的大请求对系统的影响 |\n\n表 1 与现行线程池的对比

\n\nUnified Thread Pool 的调度方案参考自多级反馈队列算法,在 Unified Thread Pool 中一共有三个队列,worker 每次以不同的数量从不同的队列里面拿任务执行来表示优先级。不同于 OS 场景下的调度是以每个任务为单位,在这里一个 TiDB query 可能因为跨越多个 Region 而产生多个 TiKV task,如图 1 所示:\n\n\n\n图 1 TiDB query 与 TiKV task 的关系

\n\n因此在这里我们需要以 TiDB 的 query 为单位进行调度。为了实现这一点我们让 TiDB 在发送 query 的时候带上一个 token 来作为标识,在线程池内我们也以 token(query)为整体来调整优先级。\n\n另一点很重要的改动是,现在 TiKV 中可能会出现一些大的 Coprocessor 请求,这些请求按 batch 执行,一个请求可能包含数百个 batches,执行一次就需要秒级的时间,使得对它们的调度无法进行。关于 Coprocessor 向量化执行的内容 PingCAP 后续也会有相关文章进行介绍。因此我们使用 Rust 最新的 async/await 协程机制,在 Coprocessor batches 之间手动埋点移交执行权,如下图所示,一个原本需要约一秒钟,包含约 500 个 batch 的任务在现在将会变为许多个时间约为一毫秒的小任务,在每个小任务之间会主动移交执行权。\n\n\n\n图 2 将请求分成多次执行

\n\n至此,Unified Thread Pool 已经基本能够通过动态调节队列的参数来实现资源对大小任务的分配,并且需要设置的参数非常简单,仅有一个表示当出现大小任务混杂的情形时小任务应占的计算资源的百分数。通过测试我们看到这个的分配的效果比较精确,如下图所示。\n\n\n\n图 3 Configurable

\n\n## 比赛过程\n\n### Hacking Time\n\n在 10 月 26 日上午拿到 UCloud 提供的机器(8C16G)后,我们开始部署 TiDB 集群便于测试。第一次部署方案是 3TiDB + 3TiKV,但是当集群运行起来之后我们发现当请求压来时瓶颈似乎在 TiDB 上,于是我们将 TiKV 集群 down 掉一台,情况虽然有所好转但还是无法将 TiKV 跑到满负荷。一番挣扎无果后我们将整个集群铲掉重新部署,第二次按照 4TiDB + 1TiKV + 1Tester 部署完之后终于让瓶颈出现在 TiKV 上。\n\n详细的测试方案是使用 Tester 机器向四台 TiDB 发送请求然后检测延时和 QPS,sysbench 测试数据 32 张表,每张 10,000,000 条数据,总计容量约 80G。我们模拟了大小两种规格的请求,小请求是使用 sysbench 的 `point_selec t` 和 `read_only`,大请求则是使用四个 clients 不断地 `SELECT COUNT(*) FROM ..` 来扫表。下图是我们在上述测试环境中对 Unified Thread Pool 与 TiKV master 版本所做的对比,可以看到在单纯的小请求情况下吞吐量提高了 20%~50%。\n\n\n\n图 4 fully utilize

\n\n### 睁眼吃喝闭眼睡\n\n众所周知 Hackathon 不变的主题就是吃吃喝喝,这一次也一样。PingCAP 为选手们提供了丰富的三餐,配上广州 office 的装潢简直像在度假。午餐有超多口味可以选,到了晚上一会议桌的虾蟹的确是太有视觉冲击力。除了正餐之外,还有不限量供应的零食咖啡快乐水,实在是太幸福了。\n\n在比赛开始之前就有一件非常好奇的事情,就是据说现场晚上有三张床垫,不知道会出现怎样难上加难的场景。结果真的到了犯困的时候才发现原来其他人是根本不睡的……\n\n晚上两点左右感觉刚跑完的测试效果还行,就找了间放了床的小会议室准备做梦。可是充气床垫的气已经漏完了,在茶水间里面翻到充气装置之后打算给它重启,但是插头插上之后气泵的声音在深夜里面真是大得不行,不知道之前工作人员是怎样悄无声息地把三个床垫给充起来的。为了防止噪音扰民,我们把床垫卷到大楼下一层(洗手间旁边)的小房间里面充气,期间还引来了两位像是保安的叔叔来看看发生了什么。接下来和奕霖两个人扛着两米的床垫走过会议室走过茶水间走过工位,走进小卧室的那一段路,实在是令人印象非常深刻。\n\n这栋楼的空调效果真是非常强劲,虽然不是第一次在贵司被冷到,但是这一回来的时候依旧没有带外套。即使睡觉之前已经把空调关掉了,还是和带了外套但没拿出来的奕霖在床上缩成了两团。\n\n## 写在 Hackathon 之后\n\n比赛最后 Demo Time 的时候看别人的项目都好优秀,看得有点想提前跑路了,还好不是我上去做 presentation,能夺魁事实上挺让我感到意外的,现在 Hackathon 虽然已经结束了,但还想继续完善这个作品。现在它虽然能提升最大吞吐量,但是在延时方面的表现还能更进一步。在比赛时我们的线程池是基于比较简单的 juliex 来设计的,后续计划参考一些比如 tokio 之类的成熟的线程池来进行优化,希望能够将它完善合进 master。大家可以在 [TiDB 性能挑战赛](https://pingcap.com/community-cn/tidb-performance-challenge/) 中继续一起鼓捣这个项目,该项目对应的 [链接](https://github.com/tikv/tikv/issues/5765)。\n\n最后感谢奕霖老师这么强还愿意带我玩,感谢 PingCAP 让我蹭吃蹭喝的辛苦付出 :D \n\n>附:[逊馁队 Demo Show 视频(0:00 - 10:35)](https://v.qq.com/x/page/s30152xwbyj.html)","date":"2019-11-14","author":"夏锐航","fillInMethod":"writeDirectly","customUrl":"unified-thread-pool","file":null,"relatedBlogs":[]},{"id":"Blogs_283","title":"TiDB-Wasm 原理与实现 | TiDB Hackathon 2019 优秀项目介绍","tags":["Hackathon","社区","WebAssembly"],"category":{"name":"社区动态"},"summary":"TiDB-Wasm 项目实现了将 TiDB 编译成 Wasm 运行在浏览器里,让用户无需安装就可以使用 TiDB,最终获得了 TiDB Hackathon 2019 的二等奖。","body":">上周我们推送了《[让数据库运行在浏览器里?TiDB + WebAssembly 告诉你答案](https://pingcap.com/blog-cn/tidb-in-the-browser-running-a-golang-database-on-wasm/)》,向大家展示了 TiDB-Wasm 的魅力:TiDB-Wasm 项目是 TiDB Hackathon 2019 中诞生的二等奖项目,实现了将 TiDB 编译成 Wasm 运行在浏览器里,让用户无需安装就可以使用 TiDB。\n>\n>本文由 Ti-Cool 队成员主笔,为大家详细介绍 TiDB-Wasm 设计与实现细节。\n\n\n\n10 月 27 日,为期两天的 Hackathon 落下帷幕,我们用一枚二等奖为此次上海之行画上了圆满的句号,不枉我们风尘仆仆跑去异地参赛(强烈期待明年杭州能作为赛场,主办方也该鼓励鼓励杭州当地的小伙伴呀 :D )。\n\n我们几个 PingCAP 的小伙伴找到了 Tony 同学一起组队,组队之后找了一个周末进行了“秘密会晤”——Hackathon kick off。想了 N 个 idea,包括使用 unikernel 技术将 TiDB 直接跑在裸机上,或者将网络协议栈做到用户态以提升 TiDB 集群性能,亦或是使用异步 io 技术提升 TiKV 的读写能力,这些都被一一否决,原因是这些 idea 不是和 Tony 的工作内容相关,就是和我们 PingCAP 小伙伴的日常工作相关,做这些相当于我们在 Hackathon 加了两天班,这一点都不酷。本着「与工作无关」的标准,我们想了一个 idea:把 TiDB 编译成 Wasm 运行在浏览器里,让用户无需安装就可以使用 TiDB。我们一致认为这很酷,于是给队伍命名为 Ti-Cool(太酷了)。\n\n## WebAssembly 简介\n\n这里插入一些 WebAssembly 的背景知识,让大家对这个技术有个大致的了解。\n\nWebAssembly 的 [官方介绍](https://webassembly.org/) 是这样的:WebAssembly(缩写为 Wasm)是一种为基于堆栈的虚拟机设计的指令格式。它被设计为 C/C++/Rust 等高级编程语言的可移植目标,可在 web 上部署客户端和服务端应用程序。\n\n从上面一段话我们可以得出几个信息:\n\n1. Wasm 是一种可执行的指令格式。\n2. C/C++/Rust 等高级语言写的程序可以编译成 Wasm。\n3. Wasm 可以在 web(浏览器)环境中运行。\n\n### 可执行指令格式\n\n看到上面的三个信息我们可能又有疑问:什么是指令格式?\n\n我们常见的 [ELF 文件](https://en.wikipedia.org/wiki/Executable_and_Linkable_Format) 就是 Unix 系统上最常用的二进制指令格式,它被 loader 解析识别,加载进内存执行。同理,Wasm 也是被某种实现了 Wasm 的 runtime 识别,加载进内存执行,目前常见的实现了 Wasm runtime 的工具有各种主流浏览器,nodejs,以及一个专门为 Wasm 设计的通用实现:Wasmer,甚至还有人给 Linux 内核提 feature 将 Wasm runtime 集成在内核中,这样用户写的程序可以很方便的跑在内核态。\n\n各种主流浏览器对 WebAssembly 的支持程度:\n\n\n\n图 1 主流浏览器对 WebAssembly 的支持程度

\n\n### 从高级语言到 Wasm \n\n有了上面的背景就不难理解高级语言是如何编译成 Wasm 的,看一下高级语言的编译流程:\n\n\n\n图 2 高级语言编译流程

\n\n我们知道高级编程语言的特性之一就是可移植性,例如 C/C++ 既可以编译成 x86 机器可运行的格式,也可以编译到 ARM 上面跑,而我们的 Wasm 运行时和 ARM,x86_32 其实是同类东西,可以认为它是一台虚拟的机器,支持执行某种字节码,这一点其实和 Java 非常像,实际上 C/C++ 也可以编译到 JVM 上运行(参考:[compiling-c-for-the-jvm](https://stackoverflow.com/questions/4221605/compiling-c-for-the-jvm))。\n\n### 各种 runtime 以及 WASI\n\n再啰嗦一下各种环境中运行 Wasm 的事,上面说了 Wasm 是设计为可以在 web 中运行的程序,其实 Wasm 最初设计是为了弥补 js 执行效率的问题,但是发展到后面发现,这玩意儿当虚拟机来移植各种程序也是很赞的,于是有了 nodejs 环境,Wasmer 环境,甚至还有内核环境。\n\n这么多环境就有一个问题了:各个环境支持的接口不一致。比如 nodejs 支持读写文件,但浏览器不支持,这挑战了 Wasm 的可移植性,于是 WASI (WebAssembly System Interface) 应运而生,它定义了一套底层接口规范,只要编译器和 Wasm 运行环境都支持这套规范,那么编译器生成的 Wasm 就可以在各种环境中无缝移植。如果用现有的概念来类比,Wasm runtime 相当于一台虚拟的机器,Wasm 就是这台机器的可执行程序,而 WASI 是运行在这台机器上的系统,它为 Wasm 提供底层接口(如文件操作,socket 等)。\n\nExample or Hello World?\n\n程序员对 Hello World 有天生的好感,为了更好的说明 Wasm 和 WASI 是啥,我们这里用一个 Wasm 的 Hello World 来介绍(例程来源:[chai2010-golang-wasm.slide#27](https://talks.godoc.org/github.com/chai2010/awesome-go-zh/chai2010/chai2010-golang-wasm.slide#27)):\n\n```lisp\n(module\n ;; type iov struct { iov_base, iov_len int32 }\n ;; func fd_write(id *iov, iovs_len int32, nwritten *int32) (written int32)\n (import \"wasi_unstable\" \"fd_write\" (func $fd_write (param i32 i32 i32 i32) (result i32)))\n\n (memory 1)(export \"memory\" (memory 0))\n\n ;; The first 8 bytes are reserved for the iov array, starting with address 8\n (data (i32.const 8) \"hello world\\n\")\n\n ;; _start is similar to main function, will be executed automatically\n (func $main (export \"_start\")\n (i32.store (i32.const 0) (i32.const 8)) ;; iov.iov_base - The string address is 8\n (i32.store (i32.const 4) (i32.const 12)) ;; iov.iov_len - String length\n\n (call $fd_write\n (i32.const 1) ;; 1 is stdout\n (i32.const 0) ;; *iovs - The first 8 bytes are reserved for the iov array\n (i32.const 1) ;; len(iovs) - Only 1 string\n (i32.const 20) ;; nwritten - Pointer, inside is the length of the data to be written\n )\n drop ;; Ignore return value\n )\n)\n```\n\n\n具体指令的解释可以参考 [这里](https://pengowray.github.io/wasm-ops/html/wasm-opcodes.html)。\n\n这里的 test.wat 是 Wasm 的文本表示,wat 之于 Wasm 的关系类似于汇编和 ELF 的关系。\n\n然后我们把 wat 编译为 Wasm 并且使用 Wasmer(一个通用的 Wasm 运行时实现)运行:\n\n\n\n图 3 Hello World

\n\n## 改造工作\n\n恐惧来自未知,有了背景知识动起手来才无所畏惧,现在可以开启 TiDB 的浏览器之旅。\n\n### 浏览器安全限制\n\n我们知道,浏览器本质是一个沙盒,是不会让内部的程序做一些危险的事情的,比如监听端口,读写文件。而 TiDB 的使用场景实际是用户启动一个客户端通过 MySQL 协议连接到 TiDB,这要求 TiDB 必须监听某个端口。\n\n**考虑片刻之后,我们认为即便克服了浏览器沙盒这个障碍,真让用户用 MySQL 客户端去连浏览器也并不是一个优雅的事情,我们希望的是用户在页面上可以有一个开箱即用的 MySQL 终端,它已经连接好了 TiDB。**\n\n于是我们第一件事是给 TiDB 集成一个终端,让它启动后直接弹出这个终端接受用户输入 SQL。所以我们需要在 TiDB 的代码中找到一个工具,它的输入是一串 SQL,输出是 SQL 的执行结果,写一个这样的东西对于我们几个没接触过 TiDB 代码的人来说还是有些难度,于是我们想到了一个捷径:TiDB 的测试代码中肯定会有输入 SQL 然后检查输出的测试。那么把这种测试搬过来改一改不就是我们想要的东西嘛?然后我们翻了翻 TiDB 的测试代码,发现了大量的这样的用法:\n\n```go\nresult = tk.MustQuery(\"select count(*) from t group by d order by c\")\nresult.Check(testkit.Rows(\"3\", \"2\", \"2\"))\n```\n\n所以我们只需要看看这个 `tk` 是个什么东西,借来用一下就行了。这是 `tk` 的主要函数:\n\n```go\n// Exec executes a sql statement.\nfunc (tk *TestKit) Exec(sql string, args ...interface{}) (sqlexec.RecordSet, error) {\n var err error\n if tk.Se == nil {\n tk.Se, err = session.CreateSession4Test(tk.store)\n tk.c.Assert(err, check.IsNil)\n id := atomic.AddUint64(&connectionID, 1)\n tk.Se.SetConnectionID(id)\n }\n ctx := context.Background()\n if len(args) == 0 {\n var rss []sqlexec.RecordSet\n rss, err = tk.Se.Execute(ctx, sql)\n if err == nil && len(rss) > 0 {\n return rss[0], nil\n }\n return nil, errors.Trace(err)\n }\n stmtID, _, _, err := tk.Se.PrepareStmt(sql)\n if err != nil {\n return nil, errors.Trace(err)\n }\n params := make([]types.Datum, len(args))\n for i := 0; i < len(params); i++ {\n params[i] = types.NewDatum(args[i])\n }\n rs, err := tk.Se.ExecutePreparedStmt(ctx, stmtID, params)\n if err != nil {\n return nil, errors.Trace(err)\n }\n err = tk.Se.DropPreparedStmt(stmtID)\n if err != nil {\n return nil, errors.Trace(err)\n }\n return rs, nil\n}\n```\n\n\n剩下的事情就非常简单了,写一个 Read-Eval-Print-Loop (REPL) 读取用户输入,将输入交给上面的 Exec,再将 Exec 的输出格式化到标准输出,然后循环继续读取用户输入。\n\n### 编译问题\n\n**集成一个终端只是迈出了第一步,我们现在需要验证一个非常关键的问题:TiDB 能不能编译到 Wasm,虽然 TiDB 是 Golang 写的,但是中间引用的第三方库没准哪个写了平台相关的代码就没法直接编译了**。\n\n我们先按照 [Golang 官方文档](https://github.com/golang/go/wiki/WebAssembly#getting-started) 编译:\n\n\n\n图 4 按照 Golang 官方文档编译(1/2)

\n\n\n果然出师不利,查看 goleveldb 的代码发现,storage 包下面的代码针对不同平台有各自的实现,唯独没有 Wasm/js 的:\n\n\n\n图 5 按照 Golang 官方文档编译(2/2)

\n\n所以在 Wasm/js 环境下编译找不到一些函数。所以这里的方案就是添加一个 `file_storage_js.go`,然后给这些函数一个 unimplemented 的实现:\n\n```go\npackage storage\n\nimport (\n\t\"os\"\n\t\"syscall\"\n)\n\nfunc newFileLock(path string, readOnly bool) (fl fileLock, err error) {\n\treturn nil, syscall.ENOTSUP\n}\n\nfunc setFileLock(f *os.File, readOnly, lock bool) error {\n\treturn syscall.ENOTSUP\n}\n\nfunc rename(oldpath, newpath string) error {\n\treturn syscall.ENOTSUP\n}\n\nfunc isErrInvalid(err error) bool {\n\treturn false\n}\n\nfunc syncDir(name string) error {\n\treturn syscall.ENOTSUP\n}\n```\n\n\n然后再次编译:\n\n\n\n图 6 再次编译的结果

\n\nemm… 编译的时候没有函数可以说这个函数没有 Wasm/js 对应的版本,没有 body 是个什么情况?好在我们有代码可以看,到 `arith_decl.go` 所在的目录看一下就知道怎么回事了:\n\n\n\n图 7 查看目录

\n\n然后 `arith_decl.go` 的内容是一些列的函数声明,但是具体的实现放到了上面的各个平台相关的汇编文件中了。\n\n看起来还是和刚刚一样的情况,我们只需要为 Wasm 实现一套这些函数就可以了。但这里有个问题是,这是一个代码不受我们控制的第三方库,并且 TiDB 不直接依赖这个库,而是依赖了一个叫 `mathutil` 的库,然后 `mathutil` 依赖这个 `bigfft`。悲催的是,这个 `mathutil` 的代码也不受我们控制,因此很直观的想到了两种方案:\n\n1. 给这两个库的作者提 PR,让他们支持 Wasm。\n\n2. 我们将这两个库 clone 过来改掉,然后把 TiDB 依赖改到我们 clone 过来的库上。\n\n方案一的问题很明显,整个周期较长,等作者接受 PR 了我们的 Hackathon 都凉凉了(而且还不一定会接受);方案二的问题也不小,这会导致我们和上游脱钩。那么有没有第三种方案呢,即在编译 Wasm 的时候不依赖这两个库,在编译正常的二进制文件的时候又用这两个库?经过搜索发现,我们很多代码都用到了 `mathutil`,但是基本上只用了几个函数:`MinUint64`,`MaxUint64`,`MinInt32`,`MaxInt32` 等等,我们想到的方案是:\n\n1. 新建一个 `mathutil` 目录,在这个目录里建立 `mathutil_linux.go` 和 `mathutil_js.go`。\n\n2. 在 `mathutil_linux.go` 中 reexport 第三方包的几个函数。\n\n3. 在 `mathutil_js.go` 中自己实现这几个函数,不依赖第三方包。\n\n4. 将所有对第三方的依赖改到 `mathutil` 目录上。\n\n这样,`mathutil` 目录对外提供了原来 `mathutil` 包的函数,同时整个项目只有 `mathutil` 目录引入了这个不兼容 Wasm 的第三方包,并且只在 `mathutil_linux.go` 中引入(`mathutil_js.go` 是自己实现的),因此编译 Wasm 的时候就不会再用到 `mathutil` 这个包。\n\n再次编译,成功了!\n\n\n\n图 8 编译成功

\n\n### 兼容性问题\n\n编译出 main.Wasm 按照 Golang 的 Wasm 文档跑一下,由于目前是直接通过 os.Stdin 读用户输入的 SQL,通过 os.Stdout 输出结果,所以理论上页面上会是空白的(我们还没有操作 dom),但是由于 TiDB 的日志会打向 os.Stdout,所以在浏览器的控制台上应该能看到 TiDB 正常启动的日志才对。然而很遗憾看到的是异常栈:\n\n\n\n图 9 异常栈

\n\n可以看到这个错是运行时没实现 os.stat 操作,这是因为目前的 Golang 没有很好的支持 WASI,它仅在 `wasm_exec.js` 中 mock 了一个 `fs`:\n\n```js\nglobal.fs = {\n writeSync(fd, buf) {\n ...\n },\n write(fd, buf, offset, length, position, callback) {\n ...\n },\n open(path, flags, mode, callback) {\n ...\n },\n ...\n}\n```\n\n而且这个 mock 的 `fs` 并没有实现 `stat`, `lstat`, `unlink`, `mkdir` 之类的调用,那么解决方案就是我们在启动之前在全局的 `fs` 对象上 mock 一下这几个函数:\n\n```js\nfunction unimplemented(callback) {\n const err = new Error(\"not implemented\");\n err.code = \"ENOSYS\";\n callback(err);\n}\nfunction unimplemented1(_1, callback) { unimplemented(callback); }\nfunction unimplemented2(_1, _2, callback) { unimplemented(callback); }\n\nfs.stat = unimplemented1;\nfs.lstat = unimplemented1;\nfs.unlink = unimplemented1;\nfs.rmdir = unimplemented1;\nfs.mkdir = unimplemented2;\ngo.run(result.instance);\n```\n\n然后再刷新页面,在控制台上出现了久违的日志:\n\n\n\n图 10 日志信息

\n\n到目前为止就已经解决了 TiDB 编译到 Wasm 的所有技术问题,剩下的工作就是找一个合适的能运行在浏览器里的 SQL 终端替换掉前面写的终端,和 TiDB 对接上就能让用户在页面上输入 SQL 并运行起来了。\n\n### 用户接口\n\n通过上面的工作,我们现在有了一个 Exec 函数,它接受 SQL 字符串,输出 SQL 执行结果,并且它可以在浏览器里运行,我们还需要一个浏览器版本 SQL 终端和这个函数交互,两种方案:\n\n1. 使用 Golang 直接操作 dom 来实现这个终端。\n\n2. 在 Golang 中把 Exec 暴露到全局,然后找一个现成的 js 版本的终端和这个全局的 Exec 对接。\n\n对于前端小白的我们来说,第二种方式成本最低,我们很快找到了 jquery.console.js 这个库,它只需要传入一个 SQL 处理的 callback 即可运行,而我们的 Exec 简直就是为这个 callback 量身打造的。\n\n因此我们第一步工作就是把 Exec 挂到浏览器的 window 上(暴露到全局给 js 调用):\n\n```go\njs.Global().Set(\"executeSQL\", js.FuncOf(func(this js.Value, args []js.Value) interface{} {\n go func() {\n\t // Simplified code\n\t sql := args[0].String()\n\t args[1].Invoke(k.Exec(sql))\n }()\n return nil\n}))\n```\n\n这样就能在浏览器的控制台运行 SQL 了:\n\n\n\n图 11 在浏览器控制台运行 SQL

\n\n然后将用 jquery.console.js 搭建一个 SQL 终端,再将 executeSQL 作为 callback 传入,大功告成:\n\n\n\n图 12 搭建 SQL 终端

\n\n现在算是有一个能运行的版本了。\n\n### 本地文件访问\n\n还有一点点小麻烦要解决,那就是 TiDB 的 load stats 和 load data 功能。load data 语法和功能详解可以参考 [TiDB 官方文档](https://pingcap.com/docs-cn/v3.0/reference/sql/statements/load-data/),其功能简单的说就是用户指定一个文件路径,然后客户端将这个文件内容传给 TiDB,TiDB 将其加载到指定的表里。我们的问题在于,浏览器中是不能读取用户电脑上的文件的,于是我们只好在用户执行这个语句的时候打开浏览器的文件上传窗口,让用户主动选择一个这样的文件传给 TiDB:\n\n```go\njs.Global().Get(\"upload\").Invoke(js.FuncOf(func(this js.Value, args []js.Value) interface{} {\n go func() {\n fileContent := args[0].String()\n _, e := doSomething(fileContent)\n c <- e\n }()\n return nil\n}), js.FuncOf(func(this js.Value, args []js.Value) interface{} {\n go func() {\n c <- errors.New(args[0].String())\n }()\n return nil\n}))\n```\n\nload stats 的实现也是同理。\n\n**此外,我们还使用同样的原理 “自作主张” 加入了一个新的指令:source,用户执行这个命令可以上传一个 SQL 文件,然后我们会执行这个文件里的语句。我们认为这个功能的主要使用场景是:用户初次接触 TiDB 时,想验证其对 MySQL 的兼容性,但是一条一条输入 SQL 效率太低了,于是可以将所有用户业务中用到的 SQL 组织到一个 SQL 文件中(使用脚本或其他自动化工具),然后在页面上执行 source 导入这个文件,验证结果。**\n\n以一个 test.sql 文件为例,展示下 source 命令的效果,test.sql 文件内容如下:\n\n```sql\nCREATE DATABASE IF NOT EXISTS samp_db;\n\nUSE samp_db;\n\nCREATE TABLE IF NOT EXISTS person (\n number INT(11),\n name VARCHAR(255),\n birthday DATE\n);\n\nCREATE INDEX person_num ON person (number);\n\nINSERT INTO person VALUES(\"1\",\"tom\",\"20170912\");\n\nUPDATE person SET birthday='20171010' WHERE name='tom';\n```\n\nsource 命令执行之后弹出文件选择框:\n\n\n\n图 13 source 命令执行(1/2)

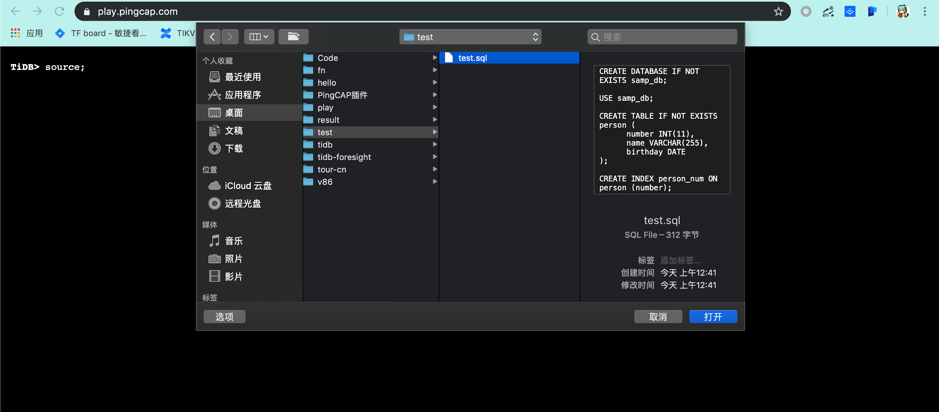

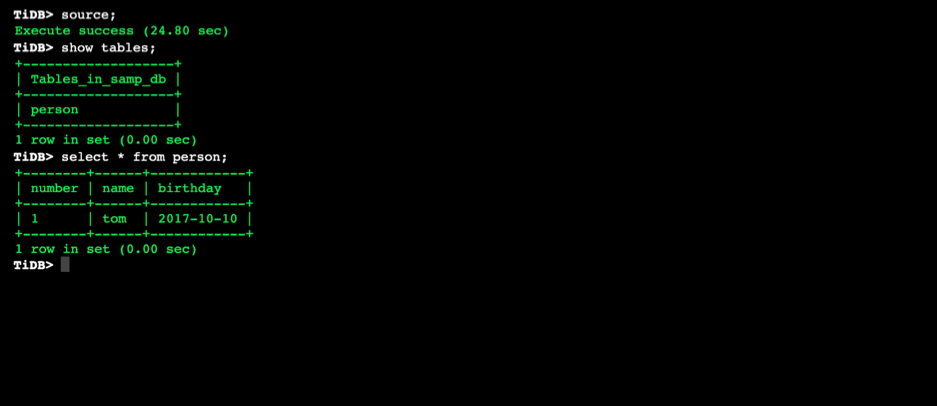

\n\n选中 SQL 文件上传后自动执行,可以对数据库进行相应的修改:\n\n\n\n图 14 source 命令执行(2/2)

\n\n## 总结与展望\n\n总的来说,这次 Hackathon 为了移植 TiDB 我们主要解决了几个问题:\n\n1. 浏览器中无法监听端口,我们给 TiDB 嵌入了一个 SQL 终端。\n\n2. goleveldb 对 Wasm 的兼容问题。\n\n3. bigfft 的 Wasm 兼容问题。\n\n4. Golang 自身对 WASI 支持不完善导致的 fs 相关函数缺失。\n\n5. TiDB 对本地文件加载转换为浏览器上传文件方式加载。\n\n6. 支持 source 命令批量执行 SQL。\n\n**目前而言我们已经将这个项目作为 TiDB Playground ([https://play.pingcap.com/](https://play.pingcap.com/)) 和 TiDB Tour ([https://tour.pingcap.com/](https://tour.pingcap.com/)) 开放给用户使用。由于它不需要用户安装配置就能让用户在阅读文档的同时进行尝试,很大程度上降低了用户学习使用 TiDB 的成本,社区有小伙伴已经基于这些自己做数据库教程了,譬如:[imiskolee/tidb-wasm-markdown](https://github.com/imiskolee/tidb-wasm-markdown)([相关介绍文章](https://mp.weixin.qq.com/s/0Vo4apK4VdBfOs0-KyWXZA))。**\n\n\n\n图 15 TiDB Playground

\n\n由于 Hackathon 时间比较紧张,其实很多想做的东西还没实现,比如:\n\n1. 使用 indexedDB 让数据持久化:需要针对 indexedDB 实现一套 Storage 的 interface。\n\n2. 使用 P2P 技术(如 webrtc)对其他浏览器提供服务:未来必定会有越来越多的应用迁移到 Wasm,而很多应用是需要数据库的,TiDB-Wasm 恰好可以扮演这样的角色。\n\n3. 给 TiDB 的 Wasm 二进制文件瘦身:目前编译出来的二进制文件有将近 80M,对浏览器不太友好,同时运行时占用内存也比较多。\n\n欢迎更多感兴趣的社区小伙伴们加入进来,一起在这个项目上愉快的玩耍([github.com/pingcap/tidb/projects/27](https://github.com/pingcap/tidb/projects/27)),也可以通过 [info@pingcap.com](mailto:info@pingcap.com) 联系我们。","date":"2019-11-12","author":"Ti-Cool","fillInMethod":"writeDirectly","customUrl":"tidb-wasm-introduction","file":null,"relatedBlogs":[]},{"id":"Blogs_163","title":"如何玩转 TiDB 性能挑战赛?本文教你 30 分钟快速上手拿积分!","tags":["TiKV","社区","性能挑战赛"],"category":{"name":"社区动态"},"summary":"本文以 TiKV 性能挑战赛 Easy 级别任务“PCP:Migrate functions from TiDB”为例,教大家如何快速又正确地完成这个任务。","body":"上周我们正式宣布了 [TiDB 性能挑战赛](https://pingcap.com/community-cn/tidb-performance-challenge/)。在赛季内,通过向 TiDB、TiKV、PD 贡献代码完成指定类别任务的方式,你可以获得相应的积分,最终你可以使用积分兑换礼品或奖金。在性能挑战赛中,你首先需要完成几道 Easy 的题目,积累一定量积分后,才能开始挑战 Medium / Hard 难度的题目。\n\n活动发布后,大家向我们反馈 TiKV 任务的资料比较少,上手难度比较高。因此本文以 TiKV 性能挑战赛 Easy 级别任务 [PCP: Migrate functions from TiDB](https://github.com/tikv/tikv/issues/5751) 为例,教大家如何快速又正确地完成这个任务,从而玩转“TiDB 性能挑战赛”。这个任务中每项完成后均可以获得 50 分,是积累分数从而挑战更高难度任务的好机会。既能改进 TiKV 为性能提升添砖加瓦、又能参与比赛得到积分,还能成为 Contributor,感兴趣的小伙伴们一起来“打怪”吧!\n\n## 背景知识\n\nTiKV Coprocessor(协处理)模块为 TiDB 提供了在存储引擎侧直接进行部分 SQL 计算的功能,支持按表达式进行过滤、聚合等,这样不仅利用起了 TiKV 机器的 CPU 资源,还能显著减少网络传输及相应的 RPC 开销,显著提升性能。大家可以阅读 [《TiKV 源码解析系列文章(十四)Coprocessor 概览》](https://pingcap.com/blog-cn/tikv-source-code-reading-14/)一文进一步了解 Coprocessor 模块。\n\n表达式计算是 Coprocessor 非常重要的一个功能,例如用户输入了这样的 SQL:\n\n```sql\nSELECT * FROM t WHERE sqrt(col_area) > 10;\n```\n\nTiKV Coprocessor 使用表达式 `sqrt(col_area) > 10` 对每一行进行求值,并根据结果对数据进行过滤,最后将过滤后的结果返回给 TiDB。为了能计算这个表达式,TiKV 必须实现与 TiDB 行为一致的 `Sqrt` 函数,当然 `>` 运算符也要提供对应的实现,这些统称为内置函数(built-in function)。\n\nTiDB 和 MySQL 有非常多的内置函数,但 TiKV 目前只实现了一部分,只有当用户输入的表达式完全被 TiKV 支持并已经进行充分测试时,对应的表达式才会被下推到 Coprocessor 执行,否则 TiDB 只能从 TiKV 捞完整数据上来,达不到加速目的。\n\n另外,TiKV 从 3.0 版本开始就包含两套 Coprocessor 执行框架,一套是老的框架,基于火山模型(推荐阅读 paper: [Volcano - An Extensible and Parallel Query Evaluation System](https://paperhub.s3.amazonaws.com/dace52a42c07f7f8348b08dc2b186061.pdf))实现,另一套是 3.0 的新框架,基于向量化模型(推荐阅读 paper:[MonetDB/X100: Hyper-Pipelining Query Execution](http://cidrdb.org/cidr2005/papers/P19.pdf))实现。火山模型中每个算子和函数都按行一个一个计算,向量化模型中则按列批量计算。由于在向量化模型中一个批次进行的处理操作是一样的,因此它可以规避条件分支,且能更好地利用流水线与缓存,从而具有更高的计算效率,差距可达 10 倍以上。\n\n既然两个模型中函数处理的数据单位是不一样的,它们自然也有不一样的函数签名及实现,因此还有一大批内置函数虽然在 TiKV 侧已经实现了,但只有火山模型的实现,而没有向量化模型的实现。这类函数虽然 TiDB 已下推计算,但 TiKV 会回退到使用火山模型而不是向量化模型,无法达成最优计算效率。\n\n综上,TiDB 内置函数在 TiKV 侧有几种实现状态:\n\n1. 完全没有实现,如 `FromDays` 函数。\n\n2. 已有火山模型的实现,没有向量化模型的实现,如 `BitLength` 函数。\n\n3. 火山模型和向量化都已实现,如 `LTReal` 函数。\n\n[PCP: Migrate functions from TiDB](https://github.com/tikv/tikv/issues/5751) 这个任务就是希望大家能帮助我们在 TiKV 侧实现更多 TiDB 所支持的内置函数,并支持向量化计算。这个 issue 中 Non-Vectorize 打钩意味着函数已有火山模型的实现,Vectorized 打钩意味着函数已有向量化模型的实现。因此你可以:\n\n* 选择一个完全没有实现的函数,如 `FromDays`,从 TiDB 侧迁移它的代码到 TiKV 并实现在火山模型(Non-Vectorize)上,提个 PR +50 积分,再迁移到向量化模型(Vectorize)上,从而再提个 PR +50 积分。\n\n* 或选择一个已有火山模型但没有向量化实现的函数,如 `BitLength` 函数,为它适配向量化模型(Vectorize)接口,提个 PR +50 积分。\n\n**实现一个完全没有在 TiKV 侧实现的内置函数一般来说具有更高难度,因此能获得更高回报!**\n\n## 如何从 TiDB 迁移内置函数在火山模型上实现\n\n这部分在 [《三十分钟成为 Contributor | 为 TiKV 添加 built-in 函数》](https://pingcap.com/blog-cn/30mins-become-contributor-of-tikv) 中有所介绍,大家可以照着这个教程来,这里就不再赘述。\n\n>注:由于 Coprocessor 框架实现的是 Fallback 机制,不允许函数只有向量化实现而没有火山模型实现。因此,若一个内置函数完全没有在 TiKV 侧实现,请先将它在火山模型上进行实现,再迁移至向量化模型。\n\n## 如何为函数适配向量化模型接口\n\n**以下本文的重点!**\n\n如果一个内置函数在 TiKV 中已经有了火山模型的实现,但没有向量化模型的实现,则可以迁移它。以 LogicalXor 内置函数为例,它之前并没有向量化的实现(当然现在 [有了](https://github.com/tikv/tikv/pull/5826))。可以遵循以下步骤:\n\n### 1. 找到火山模型的实现\n\n在 `components/tidb_query/src/expr/scalar_function.rs` 中搜索 `LogicalXor`,可以发现这个函数的实现位于 `logical_xor` 函数:\n\n```rust\nLogicalXor => logical_xor,\n```\n\n接下来搜索 `fn logical_xor` 就可以定位到函数具体内容,位于 `builtin_op.rs`(PS:不同内置函数会在不同文件中,不要照搬):\n\n```rust\npub fn logical_xor(&self, ctx: &mut EvalContext, row: &[Datum]) -> Result> {\n let arg0 = try_opt!(self.children[0].eval_int(ctx, row));\n let arg1 = try_opt!(self.children[1].eval_int(ctx, row));\n Ok(Some(((arg0 == 0) ^ (arg1 == 0)) as i64))\n}\n```\n\n### 2. 翻译为向量化实现\n\n阅读理解上面的代码,可知 `LogicalXor` 是一个二元内置函数。其中,第一个参数 `children[0]` 和第二个参数 `children[1]` 都是通过 `eval_int` 方式访问的,因此 `LogicalXor` 接受的两个参数都是 int 类型。最后,这个函数返回值是 `Result>` 代表它计算结果也是 int 类型。可以由这些信息翻译为以下向量化计算代码,实现在 `components/tidb_query/src/rpn_expr/impl_op.rs` 文件中:\n\n \n```rust\n#[rpn_fn]\n#[inline]\npub fn logical_xor(arg0: &Option, arg1: &Option) -> Result> {\n // TODO\n}\n```\n\n\n> 注:`Int` 是 `i64` 的 Type Alias。你既可以写 `Int` 也可以写 `i64`,不过更推荐 `Int` 一些。你可以从[这里](https://github.com/tikv/tikv/blob/d019ccecefc260ff760a53b7b8742fb84ffca9b5/components/tidb_query/src/codec/data_type/mod.rs#L10)找到所有的 Type Alias。`eval_xxx` 函数与类型的对应关系如下表所示。\n\n| 火山模型函数名 | 对应参数类型 | 参数类型别名 |\n|:-- |:-- |:----- | \n| `eval_int` | `Int` | `i64`|\n| `eval_real` | `Real` | `ordered_float::NotNan`|\n|`eval_decimal` | `Decimal` | \n|`eval_bytes` | `Bytes` | `Vec`|\n|`eval_time` | `DateTime` | \n|`eval_duration` | `Duration` | \n|`eval_json` | `Json` | \n\n换句话说就是:向量化版本的 `logical_xor` 是一个接受两个参数且两个参数都是 Int 类型的函数,返回 Int,是不是非常直观呢?另外我们使用 `None` 来代表 SQL 中的 `NULL` 值,因此函数参数及返回值都是 `Option` 类型。\n\n最后照搬原来的内部实现(注意处理好 `None` / `Some` 的情况),这个函数就算完成了:\n\n```rust\n#[rpn_fn]\n#[inline]\npub fn logical_xor(arg0: &Option, arg1: &Option) -> Result> {\n Ok(match (arg0, arg1) {\n (Some(arg0), Some(arg1)) => Some(((*arg0 == 0) ^ (*arg1 == 0)) as i64),\n _ => None,\n })\n}\n```\n\n你可能会问,不是说好了向量化计算是批量计算的吗,为什么向量化计算版本的代码没有接受数组,而只是接受单个值呢?原因在于 TiKV 向量化计算框架会自动基于你的这个基本实现,在编译期生成向量化计算版本,伪代码类似于这样:\n\n```rust\nfn logical_xor_vector_scalar(arg0: []Int, arg1: Int) -> []Int {\n let r = vec![];\n for i in 0..n {\n r.push( logical_xor(arg0[i], arg1) );\n }\n return r;\n}\n \nfn logical_xor_scalar_vector(arg0: Int, arg1: []Int) -> []Int {\n let r = vec![];\n for i in 0..n {\n r.push( logical_xor(arg0, arg1[i]) );\n }\n return r;\n}\n \nfn logical_xor_vector_vector(arg0: []Int, arg1: []Int) -> []Int {\n let r = vec![];\n for i in 0..n {\n r.push( logical_xor(arg0[i], arg1[i]) );\n }\n return r;\n}\n \nfn logical_xor_scalar_scalar(arg0: Int, arg1: Int) -> []Int {\n let r = vec![];\n for i in 0..n {\n r.push( logical_xor(arg0, arg1) );\n }\n return r;\n}\n```\n\n\n你只需要关注内置函数本身的逻辑实现,其他的全部自动搞定!这些所有的奥秘都隐藏在了 `#[rpn_fn]` 过程宏中。\n\n当然,上面的伪代码只是便于你进行理解。这个过程宏的实际实现并不是像上面这样粗暴地组装代码。它巧妙地利用了 Rust 的泛型机制,让编译器去生成不同个数参数情况下的最优实现。这里有点偏题就不继续展开细说了,我们后续的源码阅读文章对这个机制会有进一步分析,感兴趣的同学可以阅读代码自行学习。\n\n### 3. 增加函数入口\n\n目前只是提供了向量化版本的函数实现,但还需要告诉向量化计算框架,在遇到 LogicalXor 这个内置函数的时候,使用上向量化版本 `logical_xor` 的实现。这一步很简单,修改 `components/tidb_query/src/rpn_expr/mod.rs` 文件中的 `map_expr_node_to_rpn_func` 函数,增加一个对应关系即可:\n \n```rust\nScalarFuncSig::LogicalXor => logical_xor_fn_meta(),\n```\n\n注意,此处要为函数名加上 `_fn_meta` 后缀,从而用上 `#[rpn_fn]` 过程宏自动生成的向量化版本函数实现。不要问为什么,问就是约定 :D \n\n### 4. 撰写单元测试\n\n搜索 `ScalarFuncSig::LogicalXor` 可以找到火山模型下的该函数单元测试:\n\n \n```rust\n#[test]\nfn test_logic_op() {\n let tests = vec![\n ...\n (\n ScalarFuncSig::LogicalXor,\n Datum::I64(1),\n Datum::I64(1),\n Some(0),\n ),\n (\n ScalarFuncSig::LogicalXor,\n Datum::I64(1),\n Datum::I64(0),\n Some(1),\n ),\n (\n ScalarFuncSig::LogicalXor,\n Datum::I64(0),\n Datum::I64(0),\n Some(0),\n ),\n (\n ScalarFuncSig::LogicalXor,\n Datum::I64(2),\n Datum::I64(-1),\n Some(0),\n ),\n (ScalarFuncSig::LogicalXor, Datum::I64(0), Datum::Null, None),\n (ScalarFuncSig::LogicalXor, Datum::Null, Datum::I64(1), None),\n ];\n let mut ctx = EvalContext::default();\n for (op, lhs, rhs, exp) in tests {\n let arg1 = datum_expr(lhs);\n let arg2 = datum_expr(rhs);\n ……\n }\n}\n```\n\n\n这个测试覆盖挺完备的,因此可以直接拿样例来复用,作为向量化版本的单元测试。向量化版本单元测试中不再使用 Datum 等结构,而是可以直接用最原始的基础数据结构 `Option`,配上 `RpnFnScalarEvaluator` 进行执行,代码如下:\n\n \n```rust\n#[test]\nfn test_logical_xor() {\n let test_cases = vec![\n (Some(1), Some(1), Some(0)),\n (Some(1), Some(0), Some(1)),\n (Some(0), Some(0), Some(0)),\n (Some(2), Some(-1), Some(0)),\n (Some(0), None, None),\n (None, Some(1), None),\n ];\n for (arg0, arg1, expect_output) in test_cases {\n let output = RpnFnScalarEvaluator::new()\n .push_param(arg0)\n .push_param(arg1)\n .evaluate(ScalarFuncSig::LogicalXor)\n .unwrap();\n assert_eq!(output, expect_output);\n }\n}\n```\n\n如果原来火山模型实现的单元测试不完备,那么请在你的向量化实现中的单元测试中补充更多测试样例,尽可能覆盖所有分支条件。你也可以从 TiDB 的实现中迁移测试样例。注意,测试的目标是要检测实现是否符合预期,预期的是 TiKV 实现与 TiDB 实现能输出一样的结果,因此 TiDB 的输出是标准输出,不能由你自己来决定这个函数的标准输出。\n\n不过,有些情况下 TiDB 的输出可能与 MySQL 不一致,你可以选择与 TiDB 行为保持一致,也可以选择与 MySQL 行为保持一致,但都需要在 TiDB 中开 issue 汇报这个行为不一致情况。\n\n### 5. 运行测试\n\n至此,这个函数已经可以工作起来了,可以运行单元测试看一下:\n\n```\nmake dev\n```\n\n或者干脆只跑刚才写的这个测试:\n\n```\nEXTRA_CARGO_ARGS=\"test_logical_xor\" make dev\n```\n\n**测试通过就可以提 PR 了。注意要在 PR 的开头写上 `PCP #5751` 指明这个 PR 对应的性能挑战赛题目,不然合了是得不到积分的。另外我们鼓励每个 PR 都专注于做一件事情,所以请尽量不要在同一个 PR 内迁移或实现多个内置函数,否则只能得到一次 50 积分。**\n\n### 6. 运行下推测试\n\n众所周知,手工编写的测试样例往往会遗漏一些考虑欠缺的边缘情况,并且可能由于犯了一些错误,测试的预期输出实际与 TiDB 不一致。为了能覆盖这些边缘情况,进一步确保 TiKV 中的内置函数实现与 TiDB 的实现一致,我们有一批使用 [randgen](https://github.com/MariaDB/randgen) 自动生成的下推测试,位于 [https://github.com/tikv/copr-test](https://github.com/tikv/copr-test)。不管你是在 TiKV 中引入一个新的函数实现,还是迁移一个现有实现,都需要确保能跑过这个测试。流程如下:\n\n1. 需要确保你新实现的函数在 [copr-test](https://github.com/tikv/copr-test) 项目的 [push-down-test/functions.txt](https://github.com/tikv/copr-test/blob/master/push-down-test/functions.txt) 文件中,如果没有的话需要往 [copr-test](https://github.com/tikv/copr-test) 项目提 PR 将函数加入测试列表中。你需要将 SQL 里的函数名追加在文件中,或者可以参考 [all_functions_reference.txt](https://github.com/tikv/copr-test/blob/master/push-down-test/all_functions_reference.txt) 文件,这个文件里列出了所有可以写的函数名,从中挑出你的那个函数名,加入 [push-down-test/functions.txt](https://github.com/tikv/copr-test/blob/master/push-down-test/functions.txt)。\n\n2. 假设 [copr-test](https://github.com/tikv/copr-test) 中提的 PR 是 #10,则在你之前提的 TiKV PR 中回复 `@sre-bot /run-integration-copr-test copr-test=pr/10` 运行下推测试。如果你的函数之前已经在 [push-down-test/functions.txt](https://github.com/tikv/copr-test/blob/master/push-down-test/functions.txt) 列表中了,可以直接回复 `@sre-bot /run-integration-copr-test` 运行下推测试。\n\n当然,我们更推荐你能直接往 [copr-test](https://github.com/tikv/copr-test) 中添加人工编写的测试,更准确地覆盖边缘情况,具体方式参见 [copr-test](https://github.com/tikv/copr-test) 的 README。\n\n### 7. 在 TiDB 中增添签名映射\n\n如果上一步 copr-test 的测试挂了,一般来说有两种情况,一种情况是内置函数的实现有问题,被 copr-test 测了出来,另一种情况是你新实现的内置函数在 TiDB 侧还未建立函数签名与下推枚举签名 `ScalarFuncSig` 之间的映射关系。后者会在测试中产生 “unspecified PbCode” 错误,非常容易辨别。如果出现了这种情况,大家可以参考 [https://github.com/pingcap/tidb/pull/12864](https://github.com/pingcap/tidb/pull/12864) 的做法,为 TiDB 提 PR 增添相应内置函数的 PbCode 映射。添加完毕之后,可以在 TiKV PR 中回复 `@sre-bot /run-integration-copr-test copr-test=pr/X tidb=pr/Y`(其中 `X` 是你提的 copr-test PR 号,`Y` 是你提的 TiDB PR 号)进行联合测试。\n\n## 完成!\n\n至此,你新实现的内置函数有了单元测试,也有了与 TiDB 的集成下推测试,是一个合格的 PR 了,可以接受我们的 review。在 merge 后,你就能拿到相应的积分,积分可以在赛季结束后兑换 [TiDB 限量周边礼品](https://pingcap.com/community-cn/tidb-performance-challenge/)!\n\n最后欢迎大家加入 [TiDB Community Slack Workspace](https://join.slack.com/t/tidbcommunity/shared_invite/enQtNzc0MzI4ODExMDc4LWYwYmIzMjZkYzJiNDUxMmZlN2FiMGJkZjAyMzQ5NGU0NGY0NzI3NTYwMjAyNGQ1N2I2ZjAxNzc1OGUwYWM0NzE) 和 [tikv-wg Slack Workspace](http://tikv.org/chat),参赛过程中遇到任何问题都可以直接通过 **#performance-challenge-program** channel 与我们取得联系。","date":"2019-11-11","author":"Wish","fillInMethod":"writeDirectly","customUrl":"how-to-join-in-the-tidb-performance-challenge-program","file":null,"relatedBlogs":[]},{"id":"Blogs_186","title":"让数据库运行在浏览器里?TiDB + WebAssembly 告诉你答案","tags":["WebAssembly","SQL","Go","MySQL","TiDB"],"category":{"name":"社区动态"},"summary":"今天的 TiDB 可以直接运行在浏览器本地。打开浏览器,你可以直接创建数据库,对数据进行增删改查。关掉浏览器,一切都消失了,干净绿色环保。","body":"一直以来都有个梦想:\n\n希望有一个数据库能够弹性扩展(分布式)到成百上千节点的规模,易于学习和理解,可以运行在私有云、公有云、Multi-Cloud、Kubernetes,也能够跑在嵌入式设备(比如树莓派)上,更酷的是也能够直接运行在浏览器里,而且不需要任何浏览器扩展(Extension),变成「口袋数据库」,就像那部电影《蚁人》。\n\n**今天,这一切都变成了现实:[TiDB](https://github.com/pingcap/tidb) 可以直接运行在浏览器本地。打开浏览器,你可以直接创建数据库,对数据进行增删改查。关掉浏览器,一切都消失了,干净绿色环保——**\n\n首先在笔记本浏览器打开 [play.pingcap.com](https://play.pingcap.com)(这里用的是 MacOS 上面的 Chrome,不确定其它浏览器是否正常),可能需要几秒来加载页面,然后就能看到熟悉的 Shell 了。现在来试试几个 SQL 语句吧!由于 TiDB 基本兼容 MySQL 协议和语法,因此我们可以用熟悉的 MySQL 风格操作,如下图所示:\n\n\n\n图 1 在浏览器上运行 TiDB

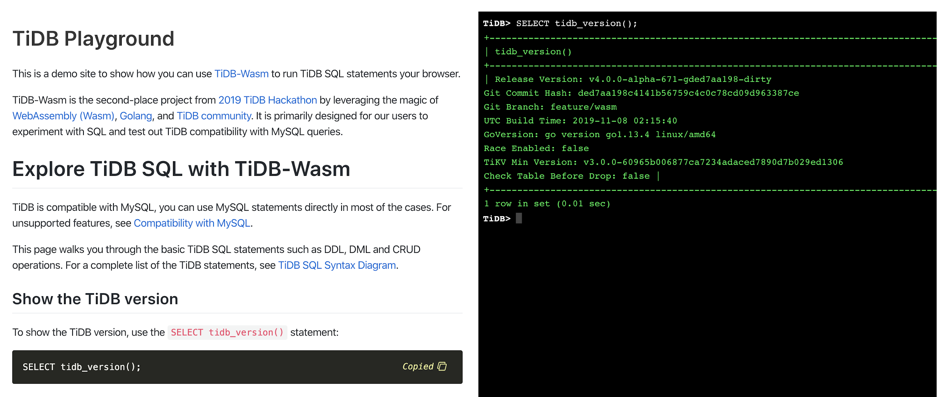

\n\n**是不是很酷?无痛体验 SQL 的时代到了。**\n\n**更酷的是,这一切都运行在浏览器本地,删库再也不用跑路了 😈**\n\n有了这些,那么是时候给在线学习 SQL 教程的网站加点功能了,比如在文字教程时,同步运行 SQL 语句。这里有个简单的 [演示](https://tour.pingcap.com/):\n\n\n\n图 2 SQL 教程网站演示

\n\n**那么在浏览器里面运行数据库还有哪些好处呢?**\n\n还记得你安装配置数据库的痛苦吗?从此以后,每个人随时随地都可以拥有一个数据库,再也没有痛苦的安装过程,再也不用痛苦的配置参数,随时享受写 SQL 的快感。也许我们不再需要 indexdb 了,SQL 是更高级的 API,TiDB 使得「一次编写、到处运行」变成了现实。\n\n当然,你一定很好奇这一切是怎么实现的:\n\n+ 首先要感谢 Go team 让 Go 语言支持了 WebAssembly(Wasm),这是近期最让我兴奋的特性之一,它让在浏览器里运行 Go 语言编写的应用程序成为了现实;\n\n+ 然后感谢 PingCAP 的开源分布式数据库 TiDB。我们把 TiDB 编译成 Wasm,在浏览器里直接运行生成的 Wasm 文件,这就使得在浏览器里运行一个数据库成为了现实。如果没有记错,TiDB 好像是 Go 语言编写的第一个可以在浏览器里面运行的 SQL 数据库;\n\n+ 特别感谢参加 [TiDB Hackathon 2019](https://github.com/pingcap/presentations/blob/master/hackathon-2019/hackathon-2019-projects.md) 的选手和大家各种有趣的想法,尤其感谢 Ti-cool 团队,在他们的努力下这一切变成了现实,该项目获得了 Hackathon 二等奖,现场评委团老师们也感到眼前一亮,对它的快速落地充满了期待!\n\n>“TiDB-Wasm 极大降低了用户体验 TiDB 能力和初步验证 SQL 兼容性的门槛,使用体验就像 golang playground 一样流畅,Wasm 的出现也为 TiDB 文档中心的建设提出了新的思路,也许不久的将来,TiDB 用户可以像 golang 一样,在阅读文档的同时,就能够在页面上尝试实际操作的体验。我们也期待 Wasm 能够持续发展,实现 TiKV 的沙箱化运行,提供更贴近真实运行场景的 playground,甚至在自动化运维管理方向上贡献更新奇思路。”\n>\n>——李凯(美团 | 数据库团队负责人)\n>\n>“刚看到这个项目的时候真的眼前一亮,这是一个非常酷的创意,而且真的对 DBA 运维管理 TiDB 有非常大的帮助,个人强烈希望这个项目能尽快落地支持!\n>\n>目前我们公司使用 TiDB 时,有很大一部分是由现在业务改造接入,但是面临的一个很重要的问题是 应用原来都是基于 MySQL 开发,虽然 TiDB 在 SQL 语法兼容上做了很多的工作,但是仍然未能 100% 覆盖,所以业务切换前我们都必须要进行 SQL 语法兼容性测试及数据准确性校验。由于 TiDB 的部署都是在线上服务器,基于数据安全,我们的生产和办公网环境是隔离的,要实现上面的需求,目前我们有如下几种方式:a) 研发同学自己写脚本连接查看;b)DBA 登录集群协助验证;c)开发专用查询平台支持。目前这这几种方式都不够安全且效率低下。随着我们维护的 TiDB 集群越来越多,DBA 的对这种低效工作不堪其烦,急需相关工具支持,而 TiDB-Wasm 无疑会解决这种问题,所以希望官方能够重视这个项目,并尽快落地实现。”\n>\n>——于伯伟(58集团 | 数据库高级经理)\n>\n>\n>“Wasm 是一个神奇的技术,也许诞生初期的目的只是为了解决 js 运行速度以及其他语言如何操作 html 的问题,但现在大家在用这种技术广泛尝试各种可能。TiDB-Wasm 就是一个很好的尝试,不仅大幅度降低了新人使用 TiDB 的难度、也给文档展示提供了神奇的操作环境、还能大幅度降低应用开发者本机调试环境的构建难度。相信这个思路能给其他服务端的软件一个很好的启发。”\n>\n>——李道兵(京东云 | 高级总监)\n>\n>“很多用户希望初步了解 TiDB 但是苦于找不到简单即用的线下环境,这导致他们还未入门就已经放弃。TiDB-Wasm 有望彻底解决这个问题。基于 TiDB-Wasm,用户可以方便的开启 session 来探索 TiDB 的特性和功能,调试 TiDB 的行为,以及对比 TiDB 与 MySQL 等数据库在 SQL 语法、加锁行为、事务隔离等级等细节上的差异,从而帮助用户更深入的理解 TiDB。对官方而言,甚至可以把路由、计算、存储层的扩容缩容、迁移等最佳实践集成到该平台并可视化该过程,从而给用户更真实、直观的感受。这将是一款令人激动的产品,它将促进 TiDB 社区更加繁荣,也将让所有 TiDB 用户受益!”\n>\n>——赵应钢(美团点评 | 分布式数据库平台开发和运维负责人,研究员)\n>\n>“TiDB-Wasm 这个项目成功地将 TiDB 移植到了 Wasm,证明了 TiDB 编译到 Wasm 的可行性,同时也反映了 WebAssembly 已走向成熟,相信后面会有更多项目移植到浏览器里运行。目前项目还处于 demo 阶段,后续如果将项目继续落地,在上面添加更多功能,比如使用 indexedDB 让数据持久化,比如使用 webrtc 之类的技术让不同浏览器中的 TiDB 可以进行 P2P 通讯,实现分布式浏览器数据库,我非常期待这些实现。”\n>\n>——侯圣文(贝壳找房 | 数据技术总监)\n>\n>“TiDB-Wasm 让我看到了 TiDB 的更多可能性。Wasm 本身是一个很有野心和想象力的技术,极大的扩展了前端的能力,可能大家都玩过类似 go playgound, rust playground 这类 web 的可交互体验平台,TiDB-Wasm 更进一步让用户甚至在离线环境下就能直接体验,可谓最极致的易用。从实用角度上来看,除了能成为一个浏览器中的 REPL 供配合文档快速体验和实验之外,TiDB-Wasm 甚至未来还可以作为 js 的 localStorage API 的很好的补充,为 js 生态提供一个 SQLite 之外的高性能本地数据库……当然,在体验上仍然有很多可以优化的地方,例如给 binary 瘦身,加入集群模式支持等。总体来说这是一个很好玩的项目。”\n>\n>——黄东旭(PingCAP | 联合创始人兼 CTO)\n>\n>“这个项目可以说集新颖性和实用性于一身,用一种很巧妙的方式,将数据库这样硬核的基础架构和炫酷的前端领域搭上关系,接下来二者就可以碰撞出各种火花。最直接的用法是大大降低用户体验 TiDB 的成本,只需要一个浏览器页面和等待下载 Binary 的时间,完全不需要安装部署,就可以体验 TiDB 基本的功能,无论是嵌入到文档中快速运行实例还是作为 Playgroud 网站让用户自由发挥,都非常合适。再扩展想一下,TiDB 可以看作 MySQL 的替代品,那么很多 MySQL 的教学网站也可以用这个 Wasm 来提升教学体验。当然,Demo 中演示的 SQL 教学只是最基本的玩法,有了这个东西,我们可以说:恭喜前端圈有了一个 JS 版本的 MySQL。相信前端的同学能把它玩出花来。一句话总结:这绝对是一个叫好又叫座的项目。”\n>\n>——申砾(PingCAP | Engineering VP)\n\n**接下来我们可以试试更多有趣的想法:**\n\n+ 让更多的在线 SQL 教程都可以直接运行。\n+ 让 TiDB 运行在 Go Playground 上,或许需要 Go team 的帮助。\n+ 支持持久化数据库,我们已经有了云计算、边缘计算,为什么不能有浏览器计算呢?\n+ ……\n\n还有好多想法我们将在接下来的文章里介绍。如果你有新的、有趣的想法,欢迎 [联系我们](mailto:info@pingcap.com)。\n\n**下一篇文章将由 Ti-cool 团队成员介绍整个项目的实现原理和后续改进工作,敬请期待!如果你已经等不及了,可以在这里直接看 [源码实现](https://github.com/pingcap/tidb/pull/13069),祝大家玩得开心!**","date":"2019-11-05","author":"Max","fillInMethod":"writeDirectly","customUrl":"tidb-in-the-browser-running-a-golang-database-on-wasm","file":null,"relatedBlogs":[]},{"id":"Blogs_44","title":"TiKV 项目首个 SIG 成立,一起走上 Contributor 进阶之路吧!","tags":["社区","社区动态"],"category":{"name":"社区动态"},"summary":"今天是 1024 程序员节,我们正式成立 TiKV 项目的首个 SIG —— Coprocessor SIG,希望对 TiKV 项目感兴趣的小伙伴们都能加入进来,探索硬核的前沿技术,交流切磋,一起走上 Contributor 的进阶之路!","body":"社区是一个开源项目的灵魂,随着 TiDB/TiKV [新的社区架构升级](https://pingcap.com/blog-cn/tidb-community-upgrade/), TiKV 社区也计划逐步成立更多个 Special Interest Group(SIG )吸引更多社区力量,一起来改进和完善 TiKV 项目。SIG 将围绕着特定的模块进行开发和维护工作,并对该模块代码的质量负责。\n\n今天是 1024 程序员节,我们正式成立 TiKV 项目的首个 SIG —— Coprocessor SIG,希望对 [TiKV 项目](https://github.com/tikv/tikv) 感兴趣的小伙伴们都能加入进来,探索硬核的前沿技术,交流切磋,一起走上 Contributor 的进阶之路!\n\n## Coprocessor 模块是什么?\n\n为了提升数据库的整体性能,TiDB 会将部分计算下推到 TiKV 执行,即 TiKV 的 Coprocessor 模块。本次成立的 Coprocessor SIG 就聚焦在 TiKV 项目 Coprocessor 模块。本 SIG 的主要职责是对 Coprocessor 模块进行未来发展的讨论、规划、开发和维护。\n\n## 如何加入 Coprocessor SIG?\n\n**社区的 Reviewer 或更高级的贡献者(Committer,Maintainer)将提名 Active Contributor 加入 Coprocessor SIG。Active Contributor 是对于 TiKV Coprocessor 模块或者 TiKV 项目有浓厚兴趣的贡献者,在过去 1 年为 TiKV 项目贡献超过 8 个 PR。**\n\n加入 SIG 后,Coprocessor SIG Tech Lead 将指导成员完成目标任务。在此过程中,成员可以从 Active Contributor 逐步晋升为 Reviewer、Committer 角色,解锁更多角色权利&义务。\n\n+ Reviewer:从 Active Contributor 中诞生,当 Active Contributor 对 Coprocessor 模块拥有比较深度的贡献,并且得到 2 个或 2 个以上 Committer 的提名时,将被邀请成为该模块的 Reviewer,主要权利&义务:\n - 参与 Coprocessor PR Review 与质量控制;\n - 对 Coprocessor 模块 PR 具有有效的 Approve / Request Change 权限;\n - 参与项目设计决策。\n+ Committer:资深的社区开发者,从 Reviewer 中诞生。当 Reviewer 对 Coprocessor 模块拥有非常深度的贡献,或者在保持 Coprocessor 模块 Reviewer 角色的同时,也在别的模块深度贡献成为了 Reviewer,这时他就在深度或者广度上具备了成为 Committer 的条件,只要再得到 2 个或 2 个以上 Maintainer 的提名时,即可成为 Committer,主要权利及义务:\n - 拥有 Reviewer 具有的权利与义务;\n - 整体把控项目的代码质量;\n - 指导 Contributor 与 Reviewer。\n\n## 工作内容有哪些?\n\n1. 完善测试\n\n\t* 为了进一步提高 Coprocessor 的集成测试覆盖率,TiKV 社区开源了 copr-test 集成测试框架(github.com/tikv/copr-test),便于社区为 Coprocessor 添加更多集成测试;\n\t\n\t* 从 TiDB port 的函数需要同时 port 单元测试,如果 TiDB 的单元测试没有覆盖所有的分支,需要补全单元测试;\n\t\n\t* Expression 的集成测试需要构造使用这个 Expression 的算子进行测试。\n\n2. 提升代码质量\n\n\t* Framework: 计算框架改进,包括表达式计算框架、算子执行框架等;\n\t\n\t* Executor: 改进现有算子、与 TiDB 协作研发新算子;\n\t\n\t* Function: 维护现有的 UDF / AggrFn 实现或从 TiDB port 新的 UDF / AggrFn 实现;\n\t\n\t* 代码位置:[https://github.com/tikv/tikv/tree/master/components/tidb_query](https://github.com/tikv/tikv/tree/master/components/tidb_query)\n\n3. 设计与演进 Proposal\n\n4. Review 相关项目代码\n\n## 如何协同工作?\n\n1. 为了协同效率,我们要求 SIG 成员遵守一致的代码风格、提交规范、PR Description 等规定。具体请参考 [文档](https://github.com/tikv/tikv/blob/master/CONTRIBUTING.md)。\n\n\n2. 任务分配方式\n\n\t* SIG Tech Lead 在 github.com/tikv/community 维护公开的成员列表与任务列表链接;\n\t\n\t* 新加入的 SIG 成员可有 2 周时间了解各个任务详情并认领一个任务,或参与一个现有任务的开发或推动。若未能在该时间内认领任务则会被移除 SIG;\n\t\n\t* SIG 成员需维持每个月参与开发任务,或参与关于现有功能或未来规划的设计与讨论。若连续一个季度不参与开发与讨论,视为不活跃状态,将会被移除 SIG。作为 acknowledgment,仍会处于成员列表的「Former Member」中。\n\n3. 定期同步进度,定期周会\n\n\t* 每 2 周以文档形式同步一次当前各个项目的开发进度;\n\t\n\t* 每 2 周召开一次全组进度会议,时间依据参会人员可用时间另行协商。目前没有项目正在开发的成员可选择性参加以便了解各个项目进度。若参与开发的成员不能参加,需提前请假且提前将自己的月度进度更新至文档;\n\t\n\t* 每次会议由一名成员进行会议记录,在会议结束 24 小时内完成会议记录并公开。会议记录由小组成员轮流执行;\n\t\n\t* Slack:[https://tikv-wg.slack.com](https://tikv-wg.slack.com/join/shared_invite/enQtNTUyODE4ODU2MzI0LWVlMWMzMDkyNWE5ZjY1ODAzMWUwZGVhNGNhYTc3MzJhYWE0Y2FjYjliYzY1OWJlYTc4OWVjZWM1NDkwN2QxNDE)(Channel #copr-sig-china)\n\t\n4. 通过更多线上、线下成员的活动进行交流合作。\n\n## Coprocessor SIG 运营制度\n\n1. 考核 & 晋升制度\n\n\ta. Coprocessor SIG Tech Lead 以月为单位对小组成员进行考核,决定成员是否可由 Active Contributor 晋升为 Reviewer:\n\t\n + 熟悉代码库;\n + 获得至少 2 位 TiKV Committer 的提名;\n + PR 贡献满足以下任意一点:\n - Merge Coprocessor PR 总数超过 10 个;\n - Merge Coprocessor PR 总行数超过 1000 行;\n - 已完成一项难度为 Medium 或以上的任务;\n - 提出设计想法并得到采纳成为可执行任务超过 3 个。\n\t\n\tb. Coprocessor SIG Tech Lead 和 TiKV Maintainer 以季度为单位对小组成员进行考核,决定成员是否可由 Reviewer 晋升为 Committer:\n\t\n\t+ 表现出良好的技术判断力;\n\t+ 在 TiKV / PingCAP 至少两个子项目中是 Reviewer;\n\t+ 获得至少 2 位 TiKV Maintainer 的提名;\n\t+ 至少完成两项难度为 Medium 的任务,或一项难度为 High 的任务;\n\t+ PR 贡献满足以下至少两点:\n\t - 半年内 Merge Coprocessor PR 总行数超过 1500 行;\n\t - 有效 Review Coprocessor PR 总数超过 10 个;\n\t - 有效 Review Coprocessor PR 总行数超过 1000 行。\n\n2. 退出制度\n\n\ta. SIG 成员在以下情况中会被移除 SIG,但保留相应的 Active Contributor / Reviewer / Committer 身份:\n\t\n\t + 作为新成员未在指定时间内认领任务;\n\t + 连续一个季度处于不活跃状态。\n\t\n\tb. Reviewer 满足以下条件之一会被取消 Reviewer 身份且收回权限(后续重新考核后可恢复):\n\t\n\t + 超过一个季度没有 review 任何 Coprocessor 相关的 PR;\n\t + 有 2 位以上 Committer 认为 Reviewer 能力不足或活跃度不足。\n\n3. Tech Lead 额外承担的职责\n\n + SIG 成员提出的问题需要在 2 个工作日给出回复;\n + 及时 Review 代码;\n + 定时发布任务(如果 SIG 成员退出后,未完成的任务需要重新分配)。\n\n## 小结\n\n通过上文相信大家对于 Coprocessor SIG 的工作内容、范围、方式以及运营制度有了初步的了解。如果你是一个开源爱好者,想要参与到一个工业级的开源项目中来,或者想了解社区的运行机制,想了解你的代码是如何从一个想法最终发布到生产环境中运行,那么加入 Coprocessor SIG 就是一个绝佳的机会!\n\n**如果你仍对 SIG 有些疑问或者想要了解更多学习资料,欢迎加入 [tikv-wg.slack.com](https://tikv-wg.slack.com/join/shared_invite/enQtNTUyODE4ODU2MzI0LWVlMWMzMDkyNWE5ZjY1ODAzMWUwZGVhNGNhYTc3MzJhYWE0Y2FjYjliYzY1OWJlYTc4OWVjZWM1NDkwN2QxNDE) 哦~**","date":"2019-10-24","author":"Long Heng","fillInMethod":"writeDirectly","customUrl":"tikv-coprocessor-sig","file":null,"relatedBlogs":[]},{"id":"Blogs_62","title":"新架构、新角色:TiDB Community Upgrade!","tags":["社区","社区动态"],"category":{"name":"社区动态"},"summary":"TiDB 社区已经逐渐成熟,但是随着社区的发展壮大,我们逐渐感受到了现在社区架构上的一些不足。经过一系列的思考和总结,我们决定升级和调整目前社区组织架构,引入更多的社区角色和社区组织,以便更好的激发社区活力,维护积极健康的社区环境。","body":"经过几年的发展,TiDB 社区已经逐渐成熟,但是随着社区的发展壮大,我们逐渐感受到了现在社区架构上的一些不足。经过一系列的思考和总结,我们决定升级和调整目前社区组织架构,引入更多的社区角色和社区组织,以便更好的激发社区活力,维护积极健康的社区环境。\n\n## 老社区架构\n\n下图是之前官网上的社区架构图:\n\n\n\n图 1 老社区架构

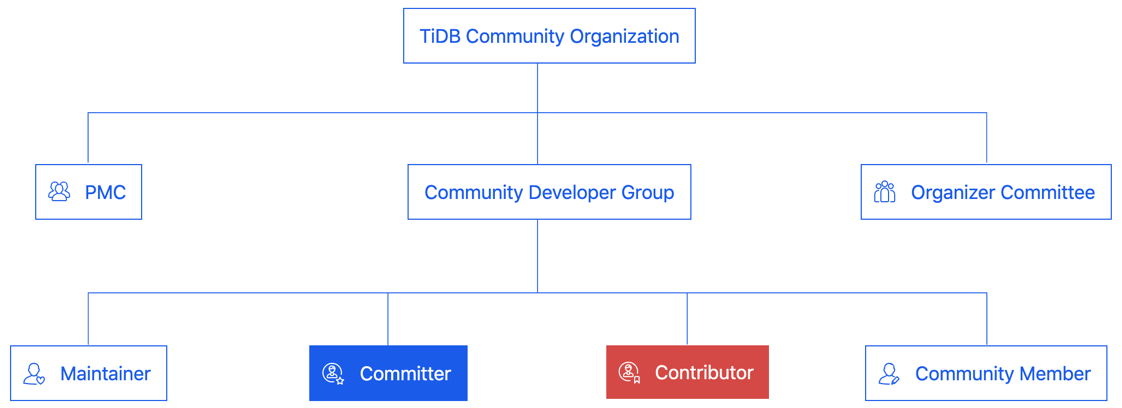

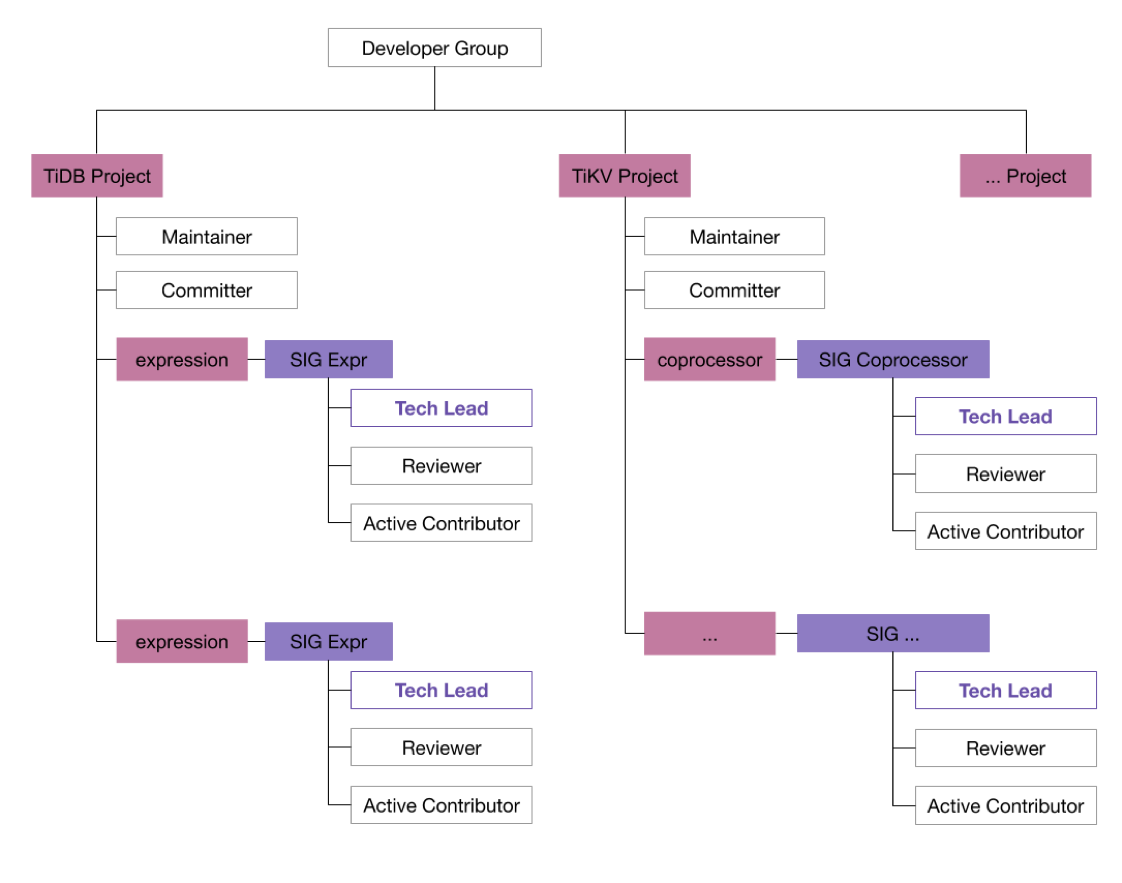

\n\n老社区架构主要面向 TiDB 开发者社区(Developer Group),主要角色有 Maintainer、Committer、Contributor 等,其中:\n\n* Committer:由 Maintainer 或 PMC 推荐,是对 TiDB 有突出贡献的 Contributor。需要独立完成至少一个 feature 或修复重大 bug。\n\n* Maintainer:项目的规划和设计者,拥有合并主干分支的权限,从 Committer 中产生。他们必须对子项目的健康表现出良好的判断力和责任感。维护者必须直接或通过委派这些职责来设置技术方向并为子项目做出或批准设计决策。\n\n可以看到老社区架构屏蔽了日益壮大的、对产品打磨升级至关重要的 TiDB 用户群体,并且老架构中对于开发者社区角色的职责、角色之间关系的表述都比较简单,所以我们在新社区架构中做了一些加法,将 TiDB 用户社区纳入进来的同时,对 TiDB 开发者社区的每个角色定义、权责又做了明确的界定,同时也增加了一些新角色、新组织,下面让我们来详细地看一看。\n\n## 新社区架构\n\n### 变化 1:将 TiDB 用户社区纳入整体社区架构\n\n随着 TiDB 产品的成熟,TiDB 用户群体愈发壮大,用户在使用过程中遇到的问题反馈及实践经验,对于 TiDB 产品的完善及应用推广有着不可忽视的重要作用。因此我们此次正式将 TiDB 用户社区(TiDB User Group,简称 TUG)纳入新的社区架构中来,希望用户与开发者有更好的交流互动,一起推动 TiDB 社区的健康发展。\n\n\n\n图 2 新社区架构之 User Group

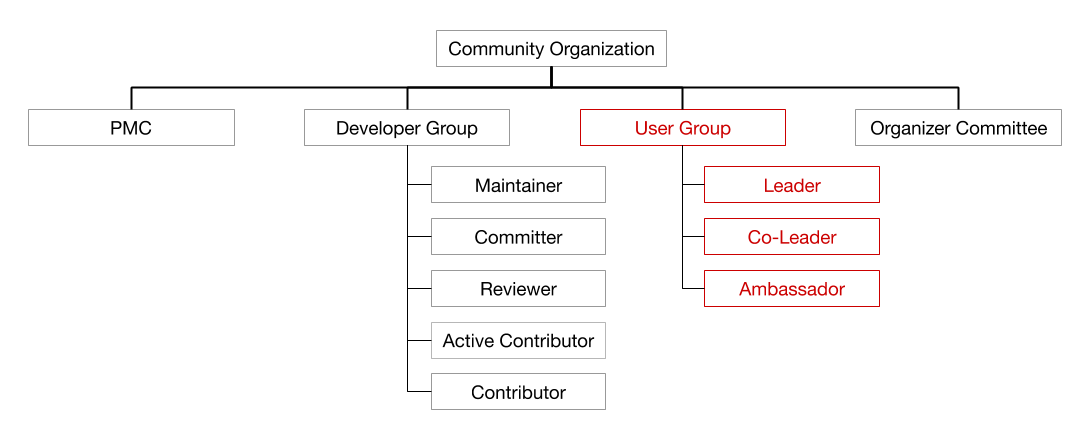

\n\nTiDB User Group(TUG)是由 TiDB 用户发起的独立、非盈利的第三方组织,用户实行自我管理,旨在加强 TiDB 用户之间的交流和学习。TUG 的形式包括但不限于线上问答和技术文章分享、线下技术沙龙、走进名企、官方互动活动等等。TUG 成员可以通过线上、线下的活动,学习前沿技术知识,发表技术见解,共同建设 TiDB 项目。更多信息可以登陆 TUG 问答论坛 [asktug.com](https://asktug.com) 查看。\n\n### 变化 2:Active Contributor 和 Reviewer\n\n\n\n图 3 新社区架构之 Active Contributor、Reviewer

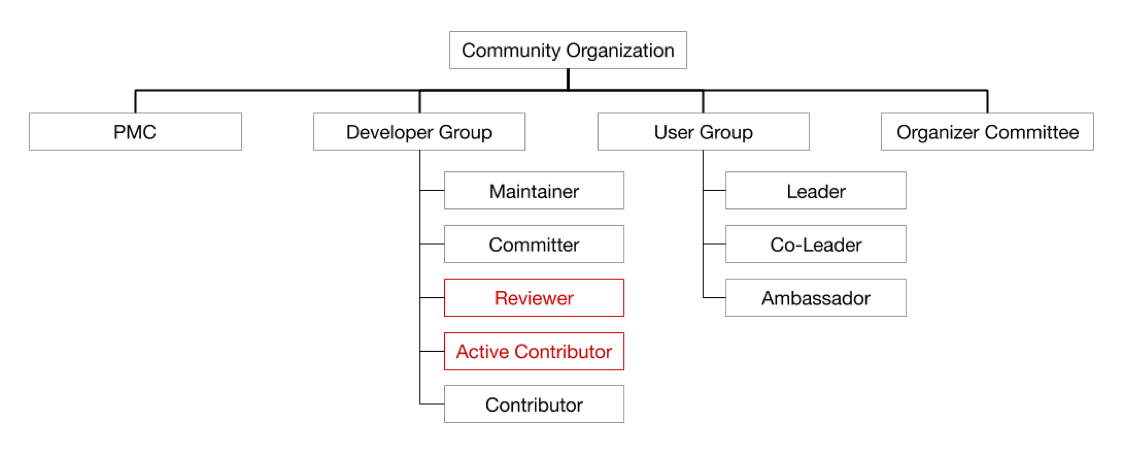

\n\n上图反映了这次社区架构升级的第 2 个变化:在开发者社区中,新增了 Reviewer 和 Active Contributor 的角色。\n\nActive Contributor 是一年贡献超过 8 个 PR 的 Contributor。Reviewer 从 Active Contributor 中诞生,具有 Review PR 的义务,并且对 TiDB 或者 TiKV 某个子模块的 PR 的点赞(LGTM)有效。关于这些角色,我们将在后文介绍 Special Interest Group 时更详细地介绍。\n\n### 变化 3:Special Interest Group\n\n让我们把开发者社区架构图放大再看看:\n\n\n\n图 4 新社区架构之 Special Interest Group

\n\n上图展示了以垂直的视角来细看开发者社区的整体架构,反映了这次社区架构升级的第 3 个变化:引入了 “专项兴趣小组”(Special Interest Group,简称 SIG)。\n\n专项兴趣小组主要负责 TiDB/TiKV 某个模块的开发和维护工作,对该模块代码的质量负责。我们将邀请满足条件的 Active Contributor 加入专项兴趣小组,开发者们将在专项兴趣小组中获得来自 Tech Lead 们的持续指导,一边锻炼技术能力,一边优化和完善该模块。社区开发者们可通过专项兴趣小组逐渐从初始的 Active Contributor 成长为受到社区认可的 Reviewer、Committer 和 Maintainer。一般而言每个专项兴趣小组都会周期性的组织会议,讨论最近进展和遇到的问题,所有的会议讨论都公开在社区上,方便感兴趣的同学一起参与和讨论。\n\n具体可参考目前我们正在运营的表达式专项兴趣小组:[Expression Special Interest Group](https://github.com/pingcap/community/tree/master/special-interest-groups/sig-exec)(注:该 SIG 在 2020 年升级为 Execution Special Interest Group,即 Exec SIG)。\n\n另外这张图也反映了社区角色和专项兴趣小组的关系,我们来仔细看看 SIG 中的社区角色:\n\n1. Active Contributor\n + 即一年贡献超过 8 个 PR 的 Contributor。\n + 如果要加入某个 SIG,某个 Contributor 需要在 1 年内为该 SIG 所负责的模块贡献超过 8 个以上的 PR,这样即可获得邀请,加入该 SIG 进行针对性的学习和贡献。\n\n2. Reviewer\n + 隶属于某个 SIG,具有 Review PR 的义务。\n + Reviewer 从 Active Contributor 中诞生,当 Active Contributor 对该模块拥有比较深度的贡献,并且得到 2 个或 2 个以上 Committer 的提名时,将被邀请成为该模块的 Reviewer。\n + Reviewer 对该模块代码的点赞(LGTM)有效(注:TiDB 要求每个 PR 至少拥有 2 个 LGTM 后才能够合并到开发分支)。\n\n3. Tech Lead\n + 即 SIG 的组织者,负责 SIG 的日常运营,包括组织会议,解答疑问等。\n + Tech Lead 需要为 SIG 的管理和成长负责,责任重大。目前暂时由 PingCAP 内部同事担任,将来可由社区开发者一起担任,和 PingCAP 同事一起为 SIG 的进步而努力。\n\n再来看看另外两个角色:\n\n1. Committer\n + 资深的社区开发者,从 Reviewer 中诞生。\n + 当 Reviewer 对该模块拥有非常深度的贡献,或者在保持当前模块 Reviewer 角色的同时,也在别的模块深度贡献成为了 Reviewer,这时他就在深度或者广度上具备了成为 Committer 的条件,只要再得到 2 个或 2 个以上 Maintainer 的提名时,即可成为 Committer。\n\n2. Maintainer\n + 重度参与 TiDB 社区的开发者,从 Committer 中诞生,对代码 repo 拥有写权限。\n\n>以上社区角色的详细的定义和权责内容可以在 [这里](https://pingcap.com/community-cn/developer-group/) 查看。\n\n### 变化 4:Working Group\n\n\n\n\n图 5 新社区架构之 Working Group